- 机器学习

- Amazon SageMaker AI

- Amazon SageMaker 训练

Amazon SageMaker 模型训练

训练和微调机器学习模型以及生成式人工智能模型

什么是 SageMaker 模型训练?

经济高效训练的优势

-

SageMaker AI 提供广泛的 GPU 和 CPU 以及诸如 AWS Trainium 和 AWS Inferentia 之类的 AWS 加速器,以实现大规模模型训练。您可以自动向上或向下扩展基础设施,从一个 GPU 扩展到数千个 GPU。

-

通过 SageMaker AI,您可以在 AWS 集群实例之间自动拆分模型和训练数据集,从而帮助您高效地扩展训练工作负载。其可帮助您优化 AWS 网络基础设施和集群拓扑的训练作业。您还可以使用经过优化的配方,以便从先进的性能中获益,在几分钟内快速开始训练并微调公开可用的生成式人工智能模型。该服务还优化了储存检查点的频率,以便通过配方来简化模型检查点,从而确保训练期间的开销最小。

-

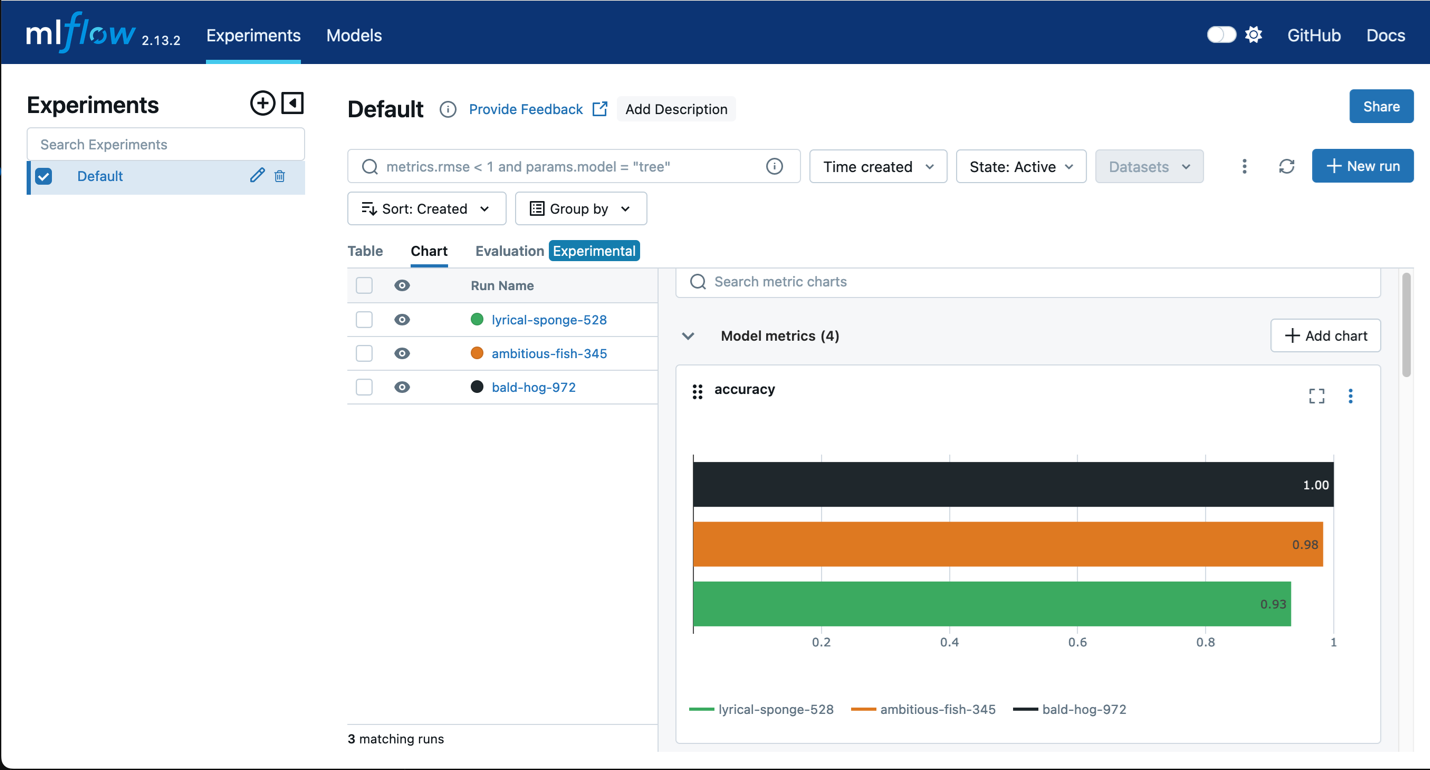

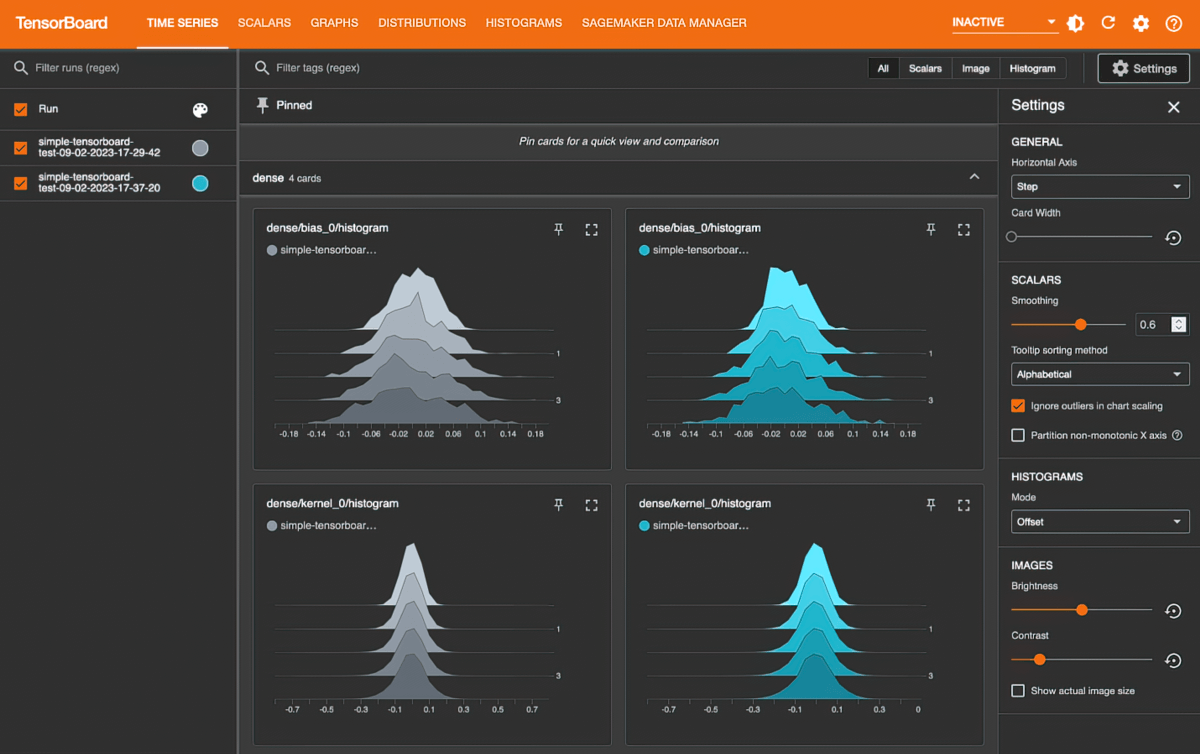

SageMaker AI 可以通过调整数千种算法参数组合来自动调整您的模型,从而得出最准确的预测。使用调试和分析工具快速纠正性能问题并优化训练性能。

-

SageMaker AI 支持高效的机器学习实验,帮助您更轻松地跟踪机器学习模型迭代。通过可视化模型架构来识别和修复整合问题,提高模型训练性能。

大规模训练模型

完全托管式训练作业

SageMaker 训练作业为大型分布式基础模型训练提供了完全托管式用户体验,消除了基础设施管理方面无差别的繁重工作。SageMaker 训练作业会自动启动一个有弹性的分布式训练集群,监控基础设施并自动从故障中恢复,以确保顺畅的训练体验。训练完成后,SageMaker 将关闭集群,您需要按净训练时间付费。此外,借助 SageMaker 训练作业,您可以灵活地选择最适合个别工作负载的正确实例类型(例如,在 P5 集群上预训练大语言模型(LLM)或者在 p4d 实例上微调开源 LLM),以便进一步节省训练预算。此外,SagerMaker 训练作业还为具有不同技术专业知识水平和不同工作负载类型的机器学习团队提供一致的用户体验。

SageMaker HyperPod

Amazon SageMaker HyperPod 是一种专用基础设施,可以高效地管理计算集群来扩展基础模型(FM)开发。它支持先进的模型训练技术、基础设施控制、性能优化和增强的模型可观测性。SageMaker HyperPod 预先配置了 SageMaker 分布式训练库,使您能够在 AWS 集群实例之间自动拆分模型和训练数据集,以帮助有效利用集群的计算和网络基础设施。它通过自动检测、诊断和恢复硬件故障来实现更具弹性的环境,使您能够连续数月不间断地训练基础模型,从而将训练时间缩短多达 40%。

高性能分布式训练

SageMaker AI 通过在 AWS 加速器中自动拆分模型和训练数据集,可以更快地执行分布式训练。它可帮助您优化 AWS 网络基础设施和集群拓扑的训练作业。该服务还优化了储存检查点的频率,以便通过配方来简化模型检查点,从而确保训练期间的开销最小。

高效地自定义生成式人工智能和机器学习模型

Amazon SageMaker AI 支持利用自定义数据集来自定义 Amazon 专有基础模型和公开发布的基础模型,无需从头开始对它们进行训练。各种技能组合的数据科学家与开发人员均可通过优化配方快速启动公开及专有生成式人工智能模型的训练和微调。每个配方都经过 AWS 测试,无需进行数周繁琐的模型配置测试即可实现前沿性能。借助这些配方,您可以微调 Llama、Mixtral、Mistral 等热门公开模型系列。此外,您还可以在 Amazon SageMaker AI 上针对业务特定使用案例,在模型训练的各个阶段使用一整套技术来自定义 Amazon Nova 基础模型,包括 Nova Micro、Nova Lite 和 Nova Pro。这些功能可作为即用型 SageMaker 方案提供,允许客户在整个模型生命周期中调整 Nova 模型,包括监督微调、对齐和预训练。

资源

找到今天要查找的内容了吗?

请提供您的意见,以便我们改进网页内容的质量