- AWS›

- AWS und NVIDIA

AWS und NVIDIA

GPU-Leistung von der Cloud bis zum Edge

Neuerungen

Erfahren Sie, wie AWS und NVIDIA Unternehmen dabei unterstützen, KI-Ziele branchenübergreifend in messbare Geschäftsergebnisse umzusetzen.

Warum AWS und NVIDIA?

AWS und NVIDIA arbeiten seit 2010 zusammen, um Kunden kontinuierlich skalierbare, kostengünstige und flexible GPU-beschleunigte Lösungen bereitzustellen. Diese Innovationen reichen von der Cloud bis zum Edge und umfassen Infrastruktur, Software und Services, um eine umfassende Lösung anzubieten, die die Zeit bis zur Lösung beim Aufbau und Einsatz von KI in der Produktion verkürzt. Da GPU-beschleunigte Lösungen in mehreren AWS-Regionen verfügbar sind, können Kunden auf die Rechenleistung zugreifen, die sie benötigen, um eine geringe Latenz, hohe Leistung und hohe Zuverlässigkeit zu erzielen.

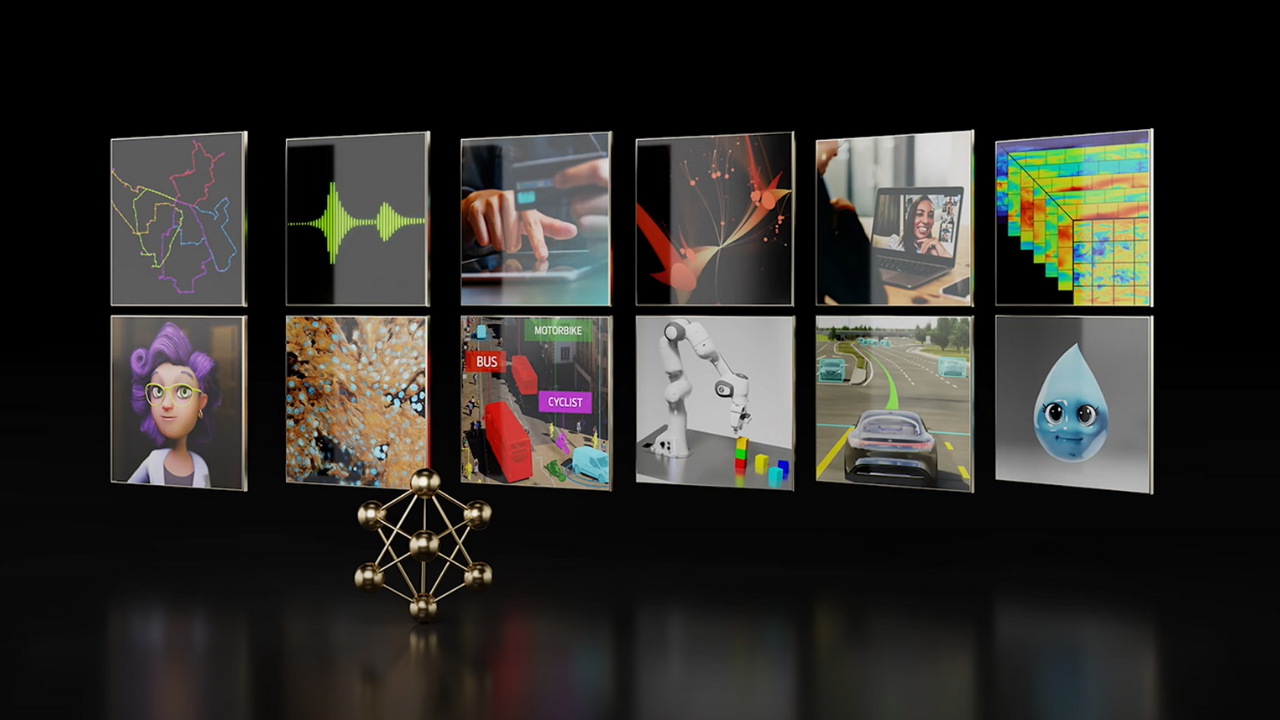

Generative KI und Machine Learning

GPU-Instanzen und Software für die komplexesten KI/ML-Modelle

Organisationen aller Größen nutzen generative KI für Chatbots, Dokumentenanalyse, Code-Generierung, Video- und Bildgenerierung, Spracherkennung, Arzneimittelforschung und die Generierung synthetischer Daten, um Innovationen zu beschleunigen, den Kundenservice zu verbessern und sich einen Wettbewerbsvorteil zu verschaffen. Um den vollen Wert dieser Lösungen zu realisieren, müssen Organisationen KI- und Machine-Learning-Modelle (ML) mithilfe ihrer eigenen geschützten Daten anpassen. Die Erstellung von Modellen von Grund auf ist jedoch teuer und zeitaufwendig. Amazon EC2 Instances, die von NVIDIA-GPUs angetrieben werden, beschleunigen das Training und Inferenz für immer komplexere LLMs und rechenintensive generative KI-Anwendungen. NVIDIA NIM und NeMo Microservices, Teil von NVIDIA AI Enterprise im AWS Marketplace, ermöglichen es Organisationen, das Potenzial von generativer KI und LLMs zu skalieren.

High Performance Computing

Lösen Sie große Computing-Herausforderungen und verschaffen Sie sich neue Erkenntnisse

High Performance Computing (HPC) ermöglicht Wissenschaftlern und Technikern die schnelle Lösung komplexer, rechenintensiver Probleme. HPC-Anwendungen erfordern häufig eine Kombination aus Netzwerkleistung, schnellem Speicher, großer Speicherkapazität und Rechenleistung. AWS ermöglicht Kunden die Beschleunigung der Forschung und die Verkürzung der Ergebniszeit durch Ausführung von GPU-betriebenen HPC in der Cloud und Skalierung auf eine größere Anzahl paralleler Aufgaben als in den meisten On-Premises-Umgebungen sinnvoll wäre. Amazon EC2 Instances, die von NVIDIA-GPUs angetrieben werden, sind eine ideale Plattform für technische Simulationen, Finanzberechnungen, seismische Analysen, Molekularmodellierung, Genomik, Rendering und andere hochleistungsfähige Workloads.

Erfahren Sie mehr über Amazon EC2 P5 Instances, unterstützt von GPUs von NVIDIA H100 Tensor Core

Internet der Dinge

Nahtlose Erweiterung von AWS auf Edge-Geräte, damit diese lokal agieren können

IoT-Geräte mit Machine Learning stehen vor einer Reihe von Herausforderungen. Begrenzte Rechenressourcen am Edge können die Komplexität und Größe von ML-Modellen einschränken, während gleichzeitig der Bedarf an ausgefeilteren Algorithmen gedeckt werden muss. Die Gewährleistung einer Echtzeitverarbeitung, geringer Latenzzeiten und Netzwerksicherheit ist von größter Bedeutung, da Edge-Geräte häufig anfälliger für Manipulationen und böswillige Angriffe sind. AWS IoT Greengrass erweitert AWS nahtlos auf Edge-Geräte, wie etwa NVIDIA Jetson, sodass diese lokal auf die von ihnen generierten Daten reagieren können, während sie weiterhin die Cloud für Verwaltung, Analyse und dauerhafte Speicherung nutzen.

Industrielles Metaverse

Optimieren Sie die Produktion, indem Sie auf einfache Weise Simulationen realer Systeme erstellen

Viele Branchen profitieren von der Simulation realer Objekte, die genaue und räumlich wahrnehmbare, immersive Darstellungen physischer Entitäten sein können. Das industrielle Metaverse, das digitale Zwillinge und andere Simulationen umfasst, hilft Forschern und Ingenieuren, besser zusammenzuarbeiten und ihre Produkte zu testen, beispielsweise durch virtuelles Prototyping oder Fernüberwachung in Fabriken. NVIDIA Omniverse ist eine Computing-Plattform, die Einzelpersonen und Teams die Entwicklung von 3D-Workflows und -Anwendungen auf Basis der Universal Scene Description (OpenUSD) ermöglicht.

Virtuelle Workstations

Passen Sie Ihre Belegschaft an und treten Sie mit kreativen Fachkräften auf der ganzen Welt in Kontakt

Mit der zunehmenden Verbreitung von Remote-Arbeit und der steigenden Nachfrage nach HPC wächst auch der Bedarf an virtuellem Zugriff auf leistungsstarke Workstations, da die Branchen zunehmend dezentralisiert arbeiten. Die GPU-Technologie von NVIDIA stellt sicher, dass grafikintensive Aufgaben wie 3D-Modellierung, Videobearbeitung und KI-Entwicklung nahtlos in der Cloud ausgeführt werden können und den Benutzern die Leistung und visuelle Qualität bieten, die sie traditionell von On-Premises-Workstations erwarten würden. Virtuelle Workstations, die auf Amazon EC2 Instances laufen und von NVIDIA GPUs angetrieben werden, verbessern die Flexibilität und Skalierbarkeit und ermöglichen eine agilere Arbeitsumgebung für geografisch verteilte Teams.

Branche

KI treibt den Wandel in jeder Branche weltweit voran. Von Spracherkennung und Empfehlungssystemen bis hin zu medizinischer Bildgebung und verbessertem Lieferkettenmanagement – KI bietet Unternehmen die Rechenleistung, Tools und Algorithmen, die ihre Teams für ihre Arbeit benötigen.

Gesundheitswesen und Biowissenschaften

HPC und KI verändern die Medizin von heute. Von verbesserten Verfahren der medizinischen Bildgebung über beschleunigte Genomanalysen bis hin zur Entdeckung und Entwicklung neuer Medikamente kann die HCLS-Branche personalisiertere Behandlungen, Kliniken der nächsten Generation und eine verbesserte Qualität der Versorgung bieten.

Beispielkunde: Paige

Finanzdienstleistungen

In einer sich schnell verändernden Finanzlandschaft können Banken KI nutzen, um große Datenmengen zu verarbeiten, die Verschlüsselung zu verbessern, die Sicherheit zu erhöhen, Betrug aufzudecken und ihren Kunden einen persönlicheren Service zu bieten.

Beispielkunde: Nerdwallet

Telekommunikation

Telekommunikationsunternehmen wollen Datenanalytik, KI und Automatisierung maximieren, um den Kundenservice zu verbessern und die Kundenbindung zu erhöhen. Erstellen Sie KI-basierte Lösungen, bauen Sie eine softwaredefinierte Infrastruktur für 5G auf und bringen Sie vernetzte Intelligenz in intelligente Geräte im Edge.

Beispielkunde: NTT Docomo

Öffentlicher Sektor

KI-gestützte Anwendungen verbessern die Katastrophenhilfe und die Bemühungen um Klimaresilienz und beschleunigen gleichzeitig zeitaufwändige Verwaltungsaufgaben wie Entwerfung, Bearbeitung und Zusammenfassung von Dokumenten, die Aktualisierung von Datenbanken, die Aufzeichnung von Ausgaben für die Prüfung und Einhaltung von Vorschriften sowie die Bearbeitung von Kundenanfragen.

Medien und Unterhaltung

Neue Technologien verändern die Medien- und Unterhaltungsbranche. KI-beschleunigte Produktionspipelines liefern schneller qualitativ hochwertigere Inhalte, Datenanalytik bietet tiefere Einblicke, Vertrieb und Monetarisierung werden optimiert und softwaredefinierte Infrastrukturen verbessern das Live-Entertainment.

Beispielkunde: Hive VFX

Projekt Ceiba und DGX Cloud

Project Ceiba ist eine Zusammenarbeit zwischen AWS und NVIDIA, um den weltweit größten Supercomputer in der Cloud für NVIDIAs KI-Forschung und -Entwicklung zu bauen, der exklusiv in AWS gehostet wird.

AWS- und NVIDIA-Services

Erkunden Sie NVIDIA AI Enterprise im AWS Marketplace

Erstellen, optimieren und implementieren Sie ML-Lösungen schneller mit der neuesten GPU-optimierten Software von NVIDIA.