Amazon Redshift

Mit SQL für Ihr Data Lakehouse ein unübertroffenes Preis-Leistungs-Verhältnis in großem Maßstab erzielen

Warum Amazon Redshift?

Amazon Redshift ermöglicht moderne Datenanalytik in großem Maßstab und bietet ein bis zu dreimal besseres Preis-Leistungs-Verhältnis und einen siebenmal besseren Durchsatz als andere Cloud-Data-Warehouses. Mit Redshift Serverless können Sie Ihre Analyse-Workloads mühelos skalieren, ohne die Data-Warehouse-Infrastruktur verwalten zu müssen. Null-ETL-Integrationen ermöglichen Analysen nahezu in Echtzeit, indem sie Daten aus Streaming-Services, operativen Datenbanken und Unternehmensanwendungen von Drittanbietern einfach miteinander verbinden, ohne dass komplexe Datenpipelines erforderlich sind. Amazon Q in Redshift steigert die Produktivität und vereinfacht die SQL-Erstellung durch natürliche Sprache. Erzielen Sie genauere Ergebnisse mit Ihren Anwendungen für generative KI, indem Sie Redshift als strukturierte Wissensdatenbank in Amazon Bedrock verwenden. Redshift lässt sich nahtlos in die nächste Generation von Amazon SageMaker integrieren, sodass Sie die leistungsstarken SQL-Analytikfunktionen für einheitliche Daten im gesamten Lakehouse in Amazon SageMaker nutzen können.

Unterstützung der nächsten Generation von Amazon SageMaker

Vorteile

-

Profitieren Sie von einem bis zu 3-mal besseren Preis-Leistungs-Verhältnis und einem 7-mal besseren Durchsatz als bei anderen Cloud Data Warehouses, wenn Sie Ihre Datenanalytik-Workloads in Redshift skalieren. Senken Sie die Kosten und erfüllen Sie geschäftskritische SLAs, indem Sie Workloads mit skalierbaren Multi-Data-Warehouse-Architekturen in Ihrem gesamten Unternehmen isolieren. Mit umfassenden Sicherheits-Features wie Netzwerkisolierung und fein abgestimmten Zugriffskontrollen wie Berechtigungen auf Zeilen- und Spaltenebene können Sie Ihre Daten ohne zusätzliche Kosten schützen.

Nutzen Sie die leistungsstarken SQL-Analytikfunktionen von Redshift für alle Ihre einheitlichen Daten durch die nahtlose Integration in Amazon SageMaker. Fragen Sie Ihre Daten in offenen Formaten ab, die auf Amazon S3 mit hoher Leistung gespeichert sind, sodass Sie keine Daten zwischen Ihren Data Lakes und Data Warehouse verschieben oder duplizieren müssen. Integrieren Sie Ihre Redshift-Daten mühelos als Teil des Lakehouse in SageMaker und machen Sie sie so für eine Vielzahl von AWS- und Apache Iceberg-kompatiblen Analytik-Engines und Machine-Learning-Tools zugänglich.

-

Führen Sie Innovationen schneller durch, indem Sie Petabytes an Daten für Analytik zur Verfügung stellen, ohne komplexe Pipelines aufbauen und verwalten zu müssen, wodurch der Zugriff auf Analytik-Anwendungen nahezu in Echtzeit möglich ist. Nutzen Sie Null-ETL-Integrationen, um Transaktionsdaten nahtlos aus Datenbanken wie Amazon Aurora, RDS und DynamoDB ohne Leistungseinbußen in Redshift zu übertragen. Erfassen Sie große Mengen an Echtzeitdaten aus Amazon Kinesis und Amazon MSK mit nativen Streaming-Services-Integrationen. Mit all Ihren Daten an einem Ort können Sie Analytik nahezu in Echtzeit ermöglichen und direkt prädiktive Machine-Learning-Modelle in Redshift erstellen, um aussagekräftige Geschäftserkenntnisse zu erhalten.

-

Beginnen Sie in wenigen Sekunden mit der Analyse Ihrer Daten mit Amazon Redshift Serverless. Redshift Serverless lernt von Ihren Workloads und skaliert automatisch die Rechenleistung, um Ihren sich ändernden Analytikanforderungen gerecht zu werden, sodass Sie sich auf die Gewinnung von Erkenntnissen konzentrieren können, ohne die Infrastruktur verwalten zu müssen. Stellen Sie einfach eine Verbindung zu Ihren Datenquellen her und beginnen Sie mit der Analyse Ihrer Daten, ohne dass eine Infrastruktur eingerichtet oder gewartet werden muss.

-

Erstellen Sie personalisierte Anwendungen mit Petabyte Ihrer Unternehmensdaten durch die nahtlose Integration von Redshift in Amazon Bedrock. Steigern Sie die Produktivität, indem Sie es Datenbenutzern mit Amazon Q Generative SQL im Redshift Query Editor ermöglichen, SQL-Abfragen in natürlicher Sprache schneller und einfacher zu schreiben. Rufen Sie große Sprachmodelle von Amazon Bedrock und SageMaker für fortgeschrittene Aufgaben zur natürlichen Sprachverarbeitung wie Textzusammenfassung, Entitätsextraktion und Stimmungsanalyse auf, um mithilfe von SQL tiefere Einblicke in Ihre Daten zu gewinnen.

Gartner 2025 | Critical Capabilities for Cloud Database Management Systems

AWS gehört zu den 2 Anbietern mit der höchsten Bewertung für alle Analytik-Anwendungsfälle.

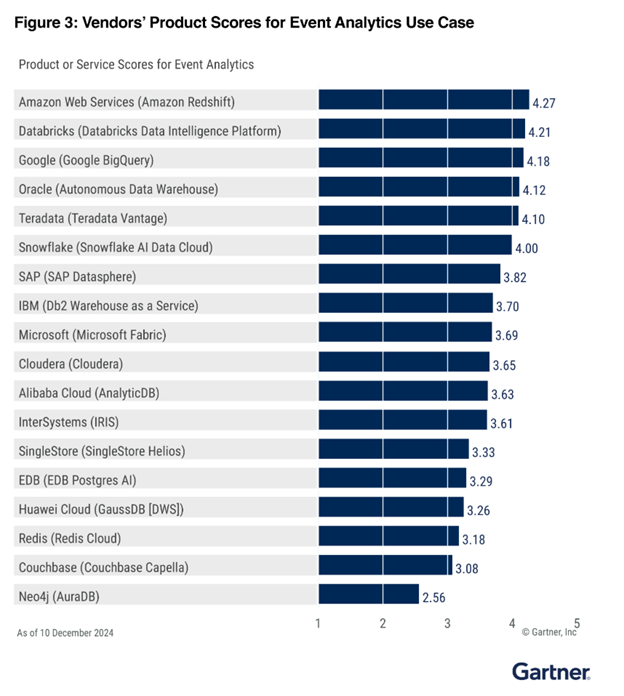

1. Platz in Ereignis-Analytik

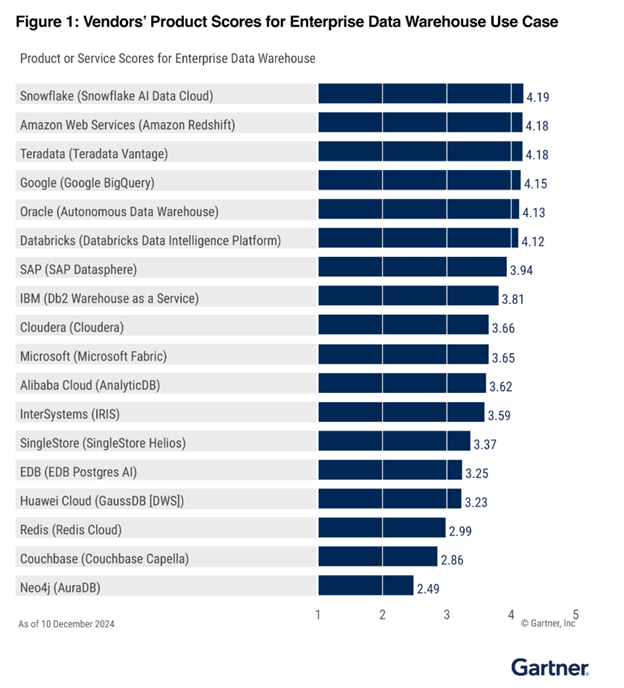

2. Platz in Enterprise Data Warehouse

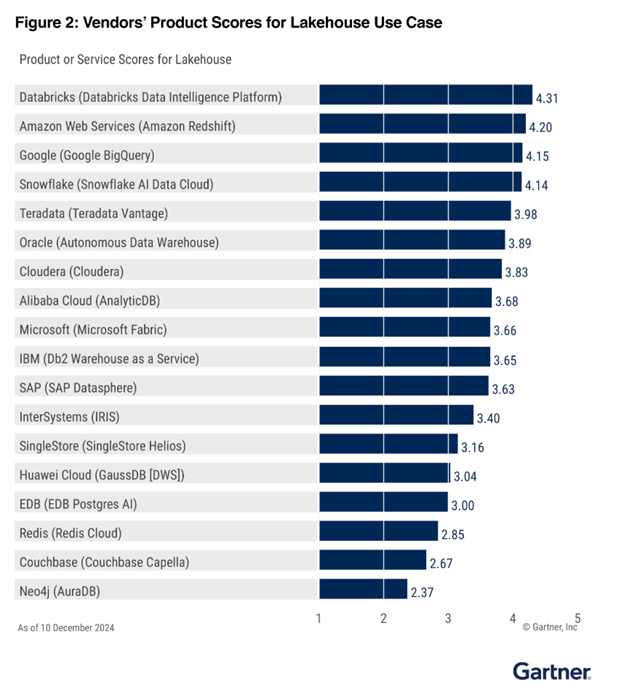

2. Platz in Lakehouse

Haftungsausschluss

GARTNER ist eine eingetragene Handelsmarke und Servicemarke von Gartner, Inc. und/oder seinen Tochtergesellschaften in den USA und international und wird hier mit Genehmigung verwendet. Alle Rechte vorbehalten.

Weder empfiehlt Gartner Anbieter, Produkte oder Services, die in seinen Forschungspublikationen dargestellt werden, noch rät Gartner Technologienutzern zur Auswahl nur der Anbieter mit den höchsten Bewertungen oder anderen Bezeichnungen. Forschungspublikationen von Gartner bestehen aus den Meinungen von Gartners Forschungsorganisation und sollten nicht als Darstellung von Tatsachen interpretiert werden. Gartner lehnt jede ausdrückliche oder stillschweigende Gewährleistung im Hinblick auf diese Untersuchung ab, einschließlich jeglicher Gewährleistung der Marktgängigkeit oder Eignung für einen bestimmten Zweck. Diese Grafik wurde von Gartner, Inc. als Teil eines größeren Forschungsberichts veröffentlicht und muss im Kontext mit dem gesamten Dokument bewertet werden. Das Dokument von Gartner ist auf Anfrage von AWS erhältlich.

Anwendungsfälle

Nimmt Hunderte von Megabyte an Daten pro Sekunde auf, sodass Sie Daten nahezu in Echtzeit abfragen und Analytikanwendungen mit niedriger Latenz für Betrugserkennung, Live-Bestenlisten und IoT erstellen können.

Erstellen Sie mithilfe von Amazon Redshift und BI-Tools wie Amazon QuickSight, Tableau, Microsoft PowerBI usw. informationsgestützte Berichte und Dashboards.

Verwenden Sie SQL, um ML-Modelle für viele Anwendungsfälle zu erstellen, zu trainieren und bereitzustellen, einschließlich prädiktiver Analysen, Klassifikation, Regression und mehr, um erweiterte Analysen großer Datenmengen zu unterstützen.

Erstellen Sie Anwendungen auf der Grundlage all Ihrer Daten in Datenbanken, Data Warehouses und Data Lakes. Teilen Sie nahtlos und sicher Daten und arbeiten Sie zusammen daran, um mehr Wert für Ihre Kunden zu schaffen, Ihre Daten als Service zu monetarisieren und neue Einnahmequellen zu erschließen.

Egal, ob es sich um Marktdaten, Social-Media-Analysen, Wetterdaten oder andere Daten handelt – Sie können Daten von Drittanbietern in AWS Data Exchange abonnieren und mit Ihren Daten in Amazon Redshift kombinieren, ohne sich um Lizenzierungs- und Onboarding-Prozesse kümmern zu müssen und die Daten in das Warehouse zu verschieben.

Amazon Redshift Serverless

In Sekundenschnelle Analysen durchführen und skalieren, ohne ein Data Warehouse bereitstellen und verwalten zu müssen

Erste Schritte mit Amazon Redshift

Haben Sie die gewünschten Informationen gefunden?

Ihr Feedback hilft uns, die Qualität der Inhalte auf unseren Seiten zu verbessern.