AWS Glue

Découvrez, préparez et intégrez toutes vos données à n’importe quelle échelle

Pourquoi choisir AWS Glue ?

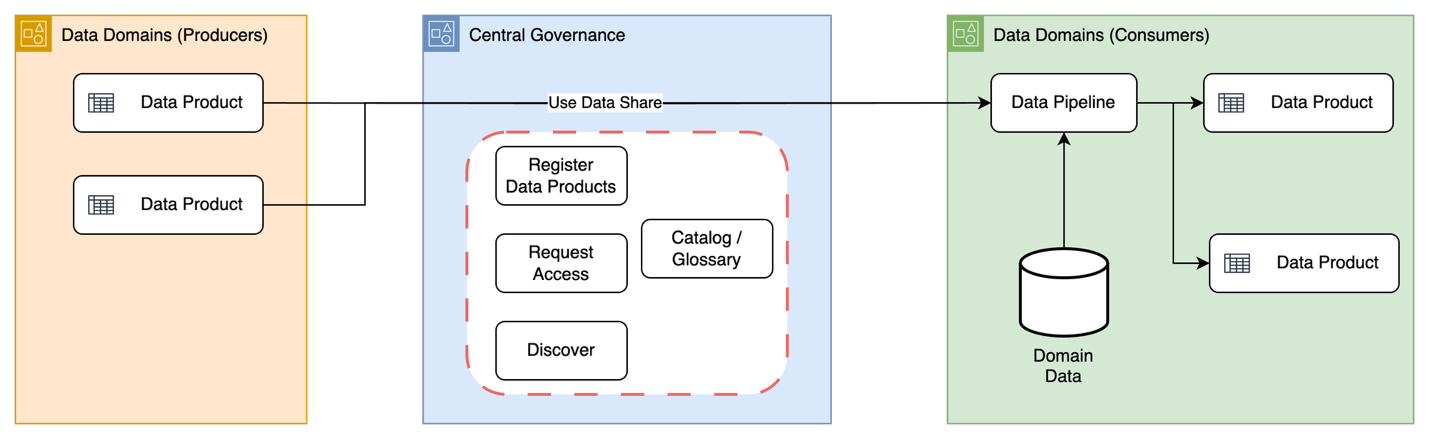

Préparer vos données pour obtenir des résultats de qualité est la première étape d’un projet analytique ou d’IA. AWS Glue est un service sans serveur qui facilite et accélère l’intégration des données, et en réduit les coûts. Vous pouvez découvrir plus de 100 sources de données diverses et vous y connecter, gérer vos données dans un catalogue de données centralisé, et créer, exécuter et surveiller visuellement des pipelines de données pour charger des données dans vos lacs de données, entrepôts de données et lake houses. Grâce aux fonctionnalités d’IA générative intégrées, vous pouvez moderniser les tâches Apache Spark et les développer plus rapidement grâce à une assistance intelligente pour la création d’ETL et le dépannage de Spark.

Intégrez vos données à AWS Glue dans la nouvelle génération d’Amazon SageMaker

Avec AWS Glue dans la nouvelle génération d’Amazon SageMaker, vous pouvez gérer et créer vos charges de travail en un seul endroit grâce à une intégration de données rentable, sans serveur et à l’échelle.

Avantages

-

AWS Glue offre toutes les fonctionnalités nécessaires à l’intégration des données, afin de vous permettre d’obtenir des informations et de mettre à profit vos données rapidement. AWS Glue fournit une boîte à outils entièrement gérée et sans serveur pour concevoir et automatiser des pipelines de données modernes, avec ETL intégré, découverte de schémas et intégration interservices.

AWS Glue met automatiquement à l’échelle vos tâches de traitement de données les plus exigeantes en ressources de gigaoctets à pétaoctets sans aucune infrastructure à gérer, et vous ne payez que les ressources utilisées.

-

AWS Glue élimine la gestion de l’infrastructure en fournissant des pipelines de données sans serveur dotés de fonctionnalités intégrées de planification et de surveillance, permettant aux équipes de se concentrer sur la création de flux de données plutôt que sur la maintenance des serveurs.

-

Bénéficiez d’une aide basée sur l’IA tout au long de votre parcours d’intégration des données, de la génération automatique de code ETL à la modernisation de vos tâches Spark. AWS Glue fournit une génération de code intelligente, des mises à niveau de Spark assistées par l’IA et une résolution intégrée des problèmes liés à Spark.

-

Intégrez vos données, où qu’elles se trouvent, grâce à une connectivité rapide et facile aux sources de données avec la nouvelle génération d’Amazon SageMaker. Créez un projet de traitement de données en combinant AWS Glue, Amazon Athena, Amazon EMR et MWAA, le tout dans Amazon SageMaker, et bénéficiez d’une expérience de gestion et de surveillance partagée. Les fonctionnalités de traitement des données d’AWS Glue sont disponibles dans les blocs-notes Amazon SageMaker et l’ETL visuel d’Amazon SageMaker.

Cas d’utilisation

Simplifier la gestion du pipeline ETL

Supprimez la gestion de l’infrastructure grâce à l’allocation automatique et à la gestion des composants master, et regroupez tous vos besoins en matière d’intégration de données en un seul service.

Explorer, expérimenter et traiter les données de manière interactive

Grâce aux sessions interactives AWS Glue, les ingénieurs de données peuvent explorer et préparer les données de manière interactive en utilisant l’environnement de développement intégré (IDE) ou le bloc-notes de leur choix.

Identifier efficacement les données

Identifiez rapidement les données sur AWS, sur site et dans d’autres clouds, puis rendez-les instantanément disponibles pour les interroger et les transformer.

Prendre en charge divers cadres de traitement et charges de travail

Prenez plus facilement en charge divers cadres de traitement des données, tels qu’ETL et ELT, et diverses charges de travail, y compris batch, micro-batch et streaming.

Nouveautés

Avez-vous trouvé les informations que vous recherchiez ?

Faites-nous part de vos commentaires afin que nous puissions améliorer le contenu de nos pages