AWS Glue

Scopri, prepara e integra tutti i dati su qualsiasi scala

Perché AWS Glue?

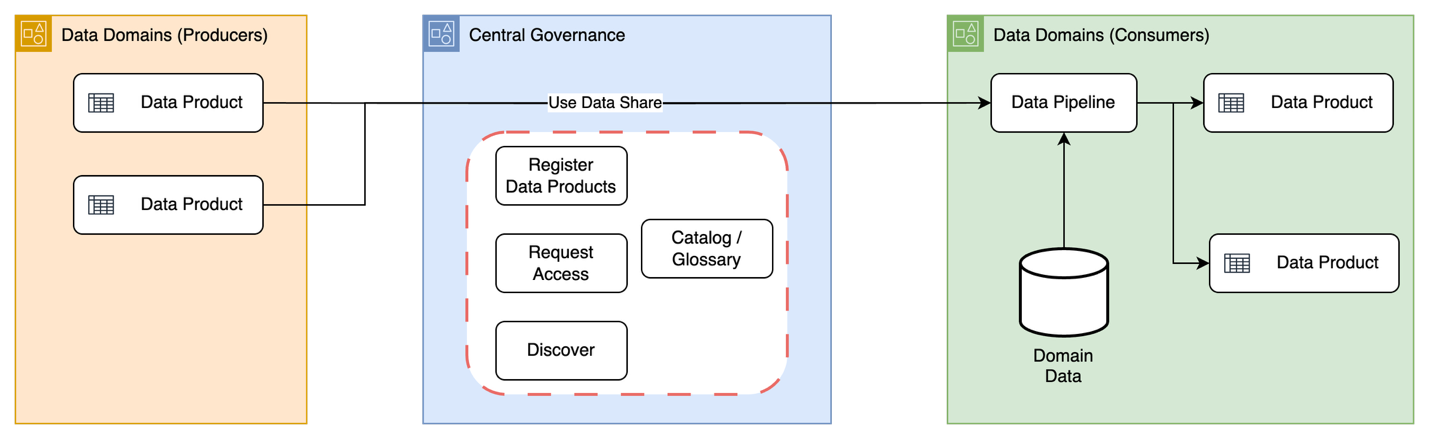

La preparazione dei dati per ottenere risultati di qualità è il primo passaggio di un progetto di analisi o IA. AWS Glue è un servizio serverless che facilita, velocizza e rende più economica l’integrazione dei dati. Puoi scoprire e connetterti con più di 100 diverse origini dati, gestire i dati in un catalogo centralizzato e creare, eseguire e monitorare visivamente le pipeline di dati per caricare dati nei data lake, data warehouse e lakehouse. Con le funzionalità di IA generativa integrate, puoi modernizzare i processi di Apache Spark e svilupparli più velocemente con un’assistenza intelligente per la creazione di ETL e la risoluzione dei problemi di Spark.

Integra i dati con AWS Glue nella nuova generazione di Amazon SageMaker

Con AWS Glue nella nuova generazione di Amazon SageMaker, puoi gestire e creare i carichi di lavoro in un unico posto con un’integrazione dei dati conveniente, scalabile e serverless.

Vantaggi

-

AWS Glue fornisce tutte le funzionalità necessarie per l’integrazione dei dati, così puoi ottenere informazioni e mettere a frutto i dati rapidamente. AWS Glue fornisce un kit di strumenti serverless completamente gestito per progettare e automatizzare pipeline di dati moderne, con ETL integrato, rilevamento di schemi e integrazione tra i servizi.

AWS Glue scala automaticamente anche i processi di elaborazione dei dati più impegnativi da gigabyte a petabyte senza alcuna infrastruttura da gestire, inoltre paghi solo per le risorse che utilizzi.

-

AWS Glue elimina la gestione dell’infrastruttura fornendo pipeline di dati serverless con funzionalità di pianificazione e monitoraggio integrate, consentendo ai team di concentrarsi sulla creazione di flussi di lavoro di dati, anziché sulla manutenzione dei server.

-

Ottieni assistenza basata sull’IA durante tutto il percorso di integrazione dei dati, dalla generazione automatica di codice ETL alla modernizzazione dei processi Spark. AWS Glue offre generazione intelligente di codice, aggiornamenti Spark assistiti dall’IA e risoluzione dei problemi di Spark integrata.

-

Integra i dati, ovunque si trovino, con una connettività semplice e veloce alle origini dati nella nuova generazione di Amazon SageMaker. Crea un progetto di elaborazione dati con una combinazione di AWS Glue, Amazon Athena, Amazon EMR e MWAA, il tutto all’interno di Amazon SageMaker, e approfitta di un’esperienza di gestione e monitoraggio condivisa. Le funzionalità di elaborazione dati di AWS Glue sono disponibili nei notebook Amazon SageMaker e nell’ETL visivo di Amazon SageMaker.

Casi d’uso

Semplifica la gestione della pipeline ETL

Rimuovi la gestione dell’infrastruttura con il provisioning automatico e la gestione dei lavoratori e consolida tutte le esigenze di integrazione dei dati in un unico servizio.

Esplora, sperimenta ed elabora i dati in modo interattivo

Utilizzando le sessioni interattive di AWS Glue, i data engineer possono esplorare e preparare i dati in modo interattivo utilizzando l’ambiente di sviluppo integrato (IDE) o il notebook di loro scelta.

Scopri i dati in modo efficiente

Identifica rapidamente i dati su AWS, on-premises e altri cloud, quindi rendili immediatamente disponibili per l’interrogazione e la trasformazione.

Supporta vari framework di elaborazione e carichi di lavoro

Supporta più facilmente vari framework di elaborazione dati, come ETL ed ELT, e vari carichi di lavoro, inclusi batch, micro-batch e streaming.

Novità

Hai trovato quello che cercavi?

Facci sapere la tua opinione in modo da migliorare la qualità dei contenuti delle nostre pagine