与 AWS 的数据集成

无论数据位于何处,您都可以连接所有数据并对其进行处理

概览

最具影响力的数据驱动型见解基于对业务和客户的全面了解。只有将跨越多个部门、服务、本地工具和第三方应用程序的所有数据来源中的数据都连接起来,才能实现这一目标。

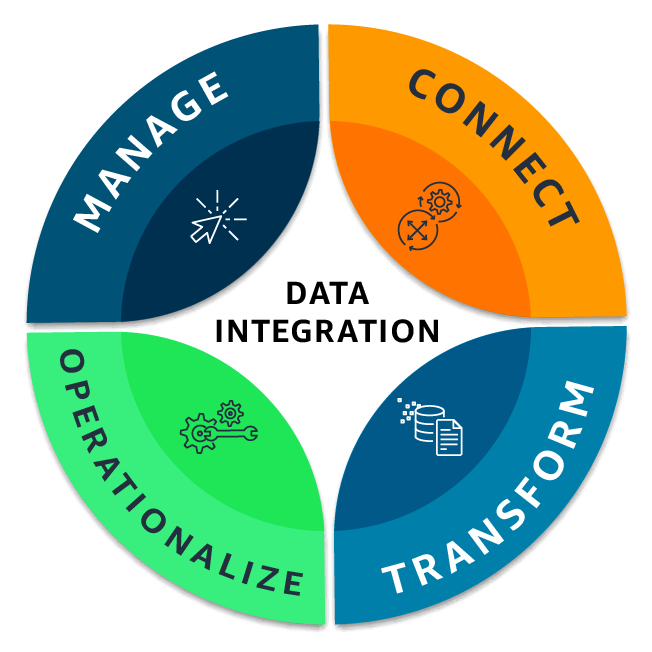

无论数据位于何处,通过与 AWS 的数据集成,您就可以轻松连接所有数据,并对其进行操作。借助 AWS 的数据集成功能,您可以汇集多个来源的数据;可以转换数据,将数据投入运营,以及管理数据,从而在数据湖和数据仓库中提供高质量数据。

使用 AWS 进行数据集成的优势

-

您的数据格式多样,来源广泛,包括第三方托管式应用程序、本地数据存储和运营数据存储。AWS 服务可连接数百个数据来源,包括第三方软件即服务(SaaS)、本地和其他云。将数据连接或移动到数据湖、数据仓库和数据库后,即可在整个组织中安全地使用这些数据。

-

AWS Glue 是众多 AWS 数据集成服务之一,它在一个地方整合了主要的数据集成功能,包括数据发现、提取、转换、加载(ETL)、清理、变换以及集中编目。无服务器 AWS Glue 可根据需要,自动预配和管理工作节点。

-

AWS 提供的工具可满足数据工程师、ETL 开发人员和业务分析师的需求,帮助各种技术水平的用户以交互方式探索和使用他们的数据。您可以在 AWS Glue Studio 中使用拖放式界面直观地转换数据,使用数据准备工具 AWS Glue DataBrew 对数据进行清理和标准化处理,以及使用首选的集成式开发环境(IDE)或笔记本测试数据。

-

很多时候,组织必须支持各种数据处理框架,如 ETL、反向 ETL 以及提取、加载和转换(ELT),还有批处理、微批处理和流式处理等不同的工作负载。AWS 为所有框架和工作负载提供灵活的支持,并利用开源标准实现可移植性。

利用 AWS 解决数据集成难题

AWS 可帮助您访问和集成任何存储位置的数据,使您的数据集成团队可以专注于高价值活动,最大限度地发挥数据的价值。

AWS Glue 可帮助轻松地发现、准备和集成任意规模的所有数据。AWS Database Migration Service 可帮助您快速、安全地将数据库和分析工作负载迁移到 AWS,在此过程中,它会尽可能地减少停机时间,并杜绝数据丢失。Amazon Managed Workflows for Apache Airflow(MWAA)为 Apache Airflow 提供了安全且高度可用的托管工作流程编排。AWS Data Exchange 可连接来自 300 多家数据提供商和 3500 多款数据产品的第三方数据。

AWS Glue 可让您更轻松地准备和集成数据,以应对复杂用例的需求(例如,转换数据,对数据进行标准化处理,在从原始数据存储中摄取数据之前先检查数据质量,或减少表列、表行或数据大小)。

对于需要定期重复执行 ETL 的常见用例,您可以使用 AWS 的零 ETL 功能,消除构建和管理 ETL 管道的需要。借助 AWS 的零 ETL 功能,您可以从 Amazon Managed Streaming for Apache Kafka 直接向 Amazon Redshift 传入流数据,并使用 Amazon Redshift 近乎实时地分析 Amazon Aurora 数据等等。

在企业中,各类用户需要使用各不相同的技术功能与数据进行交互,如果没有合适的工具,交互可能无法实现。

从开发人员到业务用户,AWS 为各种类型的用户提供针对其特定技能的接口和作业编写工具。AWS Glue Studio 可自动生成 ETL 代码,并允许 ETL 开发人员和业务分析师使用无代码界面转换数据。AWS Glue 还允许开发人员和工程师使用自己喜欢的 IDE、笔记本和处理引擎。Amazon Managed Workflows for Apache Airflow 使科学家和工程师能够编排端到端的数据管道。

AWS 可为各种工作负载提供支持,不受任何限制。

您无需成为 Apache Spark 专家,AWS Glue Studio 可帮助您编写高度可扩展的 ETL 作业,并将结构化和非结构化数据加载到数据仓库和数据湖中。Amazon Managed Streaming for Apache Kafka(MSK)和 Amazon Kinesis 可轻松地实时摄取和处理流数据。其他常见的工作负载还包括批量数据转换、数据库复制、SaaS 数据摄取、团队间数据共享以及第三方数据订阅。

相关 AWS 服务和功能

AWS Glu e — 发现、准备和集成任何规模的所有数据

用于数据集成的 AWS Q -基于 AI 的生成式 AWS Glue 功能,使您能够使用自然语言构建数据集成任务。

适用于 Apache Airflow 的亚马逊管理工作流程 — Apache Airflow 的安全且高度可用的托管工作流程编排

Amazon AppFlow — 自动执行软件即服务 (SaaS) 和 AWS 服务之间的数据流动

亚马逊 Aurora 与 Amazon Redshift 的零 ETL 集成 — 对 Aurora 中数千兆字节的交易数据进行近乎实时的分析和机器学习

Amazon Aurora PostgreSQL 与 Amazon Redshift 的零 ETL 集成

Amazon DynamoDB 与 Amazon Redshift 的零 ETL 集成

Amazon RDS for MySQL 与 Amazon Redshift 的零 ETL 集成

Amazon DynamoDB 与 Amazon OpenSearch Service 的零 ETL 集成

AWS 数据库迁移服务 — 快速、安全地将您的数据库和分析工作流程迁移到 AWS,将停机时间降至最低,数据丢失为零

Amazon Athena — 轻松灵活地分析 PB 级数据

亚马逊 Redshift — 云数据仓库的最佳性价比

AWS Lake Formation — 在几天内构建、管理和保护数据湖

AWS 数据交换 — 在云中轻松查找、订阅和使用第三方数据

AWS Glue 目录 — 在 AWS 云中存储、注释和共享元数据

Amazon DataZone — 通过内置监管功能跨组织边界解锁数据