- الذكاء الاصطناعي المولّد›

- Amazon Bedrock›

- حواجز الحماية

حواجز حماية Amazon Bedrock

تنفيذ إجراءات حماية مخصصة لمتطلبات التطبيق وسياسات الذكاء الاصطناعي المسؤول

إنشاء تطبيقات الذكاء الاصطناعي المسؤول باستخدام حواجز الحماية (Guardrails)

توفر حواجز حماية Amazon Bedrock ضمانات قابلة للتكوين للمساعدة في بناء تطبيقات الذكاء الاصطناعي المولّد بأمان على نطاق واسع. من خلال النهج المتسق والمعياري المستخدم عبر مجموعة واسعة من نماذج التأسيس (FMs) بما في ذلك النماذج الجاهزة المدعومة في Amazon Bedrock والنماذج التي تم ضبطها والنماذج المستضافة خارج Amazon Bedrock، توفر حواجز الحماية (Guardrails) السلامة والحماية المتقدمة والرائدة في الصناعة:

- يَستخدم الاستدلال المؤتمت لتقليل الهلوسة الناتجة عن الذكاء الاصطناعي، وتحديد استجابات النموذج الصحيحة بدقة تصل إلى 99% - وهو حل الأمان الأول والوحيد في مجال الذكاء الاصطناعي المولّد الذي يحقق ذلك.

- أدوات حماية متطوّرة للمحتوى النصي والمرئي تمنح العملاء القدرة على حجب ما يصل إلى 88% من المحتوى الضار متعدد الوسائط.

Remitly تقوم بتحويل دعم العملاء بسرعة وثقة باستخدام Amazon Bedrock

KONE تدعم الخدمة الميدانية للذكاء الاصطناعي المسؤول باستخدام Amazon Bedrock

مستوى ثابت من الأمان عبر جميع تطبيقات ونماذج الذكاء الاصطناعي المُولِّد

حواجز الحماية هي القدرة الوحيدة للذكاء الاصطناعي المسؤول من مزود سحابي رئيسي التي تساعدك على بناء وتخصيص ضوابط السلامة والخصوصية والموثوقية لتطبيقات الذكاء الاصطناعي المُولِّد لديك. تقوم حواجز الحماية بتقييم إدخالات المستخدم واستجابات النموذج استنادًا إلى سياسات خاصة بحالات الاستخدام، مما يوفر طبقة حماية إضافية تتجاوز ما هو متاح أصلًا. يمكن تطبيق ضوابط حواجز الحماية على النماذج المستضافة على Amazon Bedrock أو على أي نماذج من جهات خارجية (مثل OpenAI وGoogle Gemini) من خلال واجهة برمجة التطبيقات ApplyGuardrail. يمكنك أيضًا استخدام حواجز الحماية مع إطار عمل وكيل مثل Strands Agents، بما في ذلك الوكلاء الذين تم نشرهم باستخدام Amazon Bedrock AgentCore. تساعد حواجز الحماية في تصفية الهلوسات وتحسين دقة الحقائق من خلال عمليات تحقق سياقية مقابل محتوى التوليد المُعزز بالاسترداد (RAG) وفحوصات الاستدلال المؤتمت لتقديم استجابات مثبتة المصداقية. لمعرفة المزيد، اعرض الدليل المُفصَّل لتنفيذ حواجز الحماية في Amazon Bedrock.

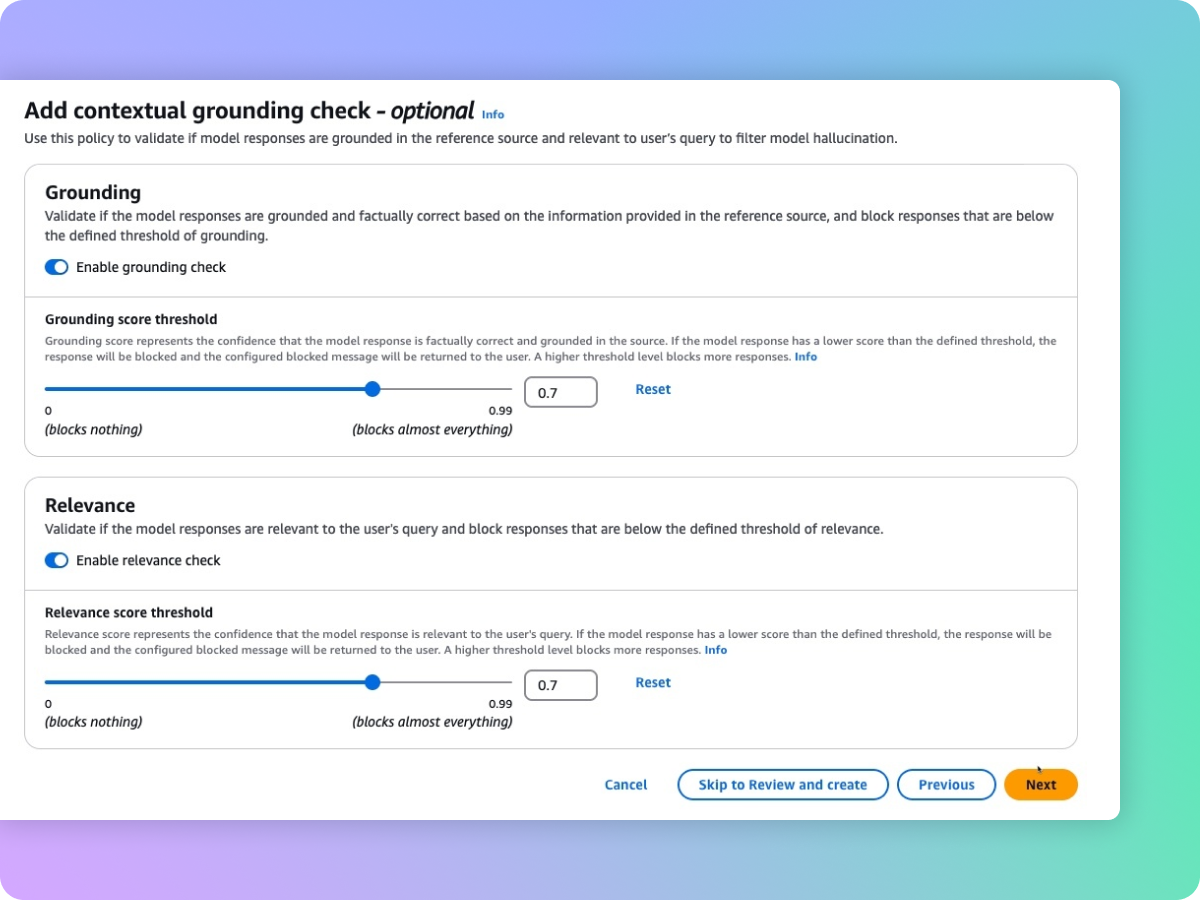

اكتشاف الهلوسة في ردود النموذج باستخدام الفحوصات الميدانية السياقية

يحتاج العملاء إلى نشر تطبيقات الذكاء الاصطناعي المولّد الصادقة والجديرة بالثقة للحفاظ على ثقة المستخدمين وتنميتها. ومع ذلك، يمكن لنماذج التأسيس (FMs) توليد معلومات غير صحيحة بسبب الهلوسة؛ أي الانحراف عن معلومات المصدر، أو الخلط بين أجزاء متعددة من المعلومات، أو اختراع معلومات جديدة. حواجز الحماية تدعم عمليات التحقق الأساسية السياقية للمساعدة في اكتشاف الهلوسة وتصفيتها إذا لم تكن الردود (على سبيل المثال، معلومات غير دقيقة من الناحية الواقعية أو جديدة) في معلومات المصدر وغير ذات صلة باستعلام المستخدم أو تعليماته. يمكن للفحوصات الميدانية السياقية المساعدة في اكتشاف الهلوسة الخاصة بـ RAG والتلخيص وتطبيقات المحادثة، حيث يمكن استخدام معلومات المصدر كمرجع للتحقق من رد النموذج.

فحوصات الاستدلال المؤتمت تحدد استجابات النموذج الصحيحة بدقة تصل إلى 99% لتقليل الهلوسة

فحوصات الاستدلال المؤتمت في حواجز حماية Amazon Bedrock هي حل الحماية الأول والوحيد في مجال الذكاء الاصطناعي المولّد الذي يساعد على منع الأخطاء الناجمة عن الهلوسات والتي تتعلق بالحقائق باستخدام منطق دقيق منطقيًا ويمكن التحقق منه يشرح سبب صحة الردود. يساعد الاستدلال المؤتمت على تخفيف الهلوسة باستخدام تقنيات رياضية سليمة للتحقق من المعلومات الناتجة وتصحيحها وتفسيرها منطقيًا - مما يضمن توافق المخرجات مع الحقائق المعروفة وعدم استنادها إلى بيانات ملفقة أو غير متسقة. يمكن للمطورين إنشاء سياسة الاستدلال المؤتمت عن طريق تحميل مستند موجود يحدد مساحة الحل المناسبة، مثل إرشادات الموارد البشرية أو دليل التشغيل. تقوم Amazon Bedrock بعد ذلك بإنشاء سياسة للاستدلال المؤتمت وتوجيه المستخدمين من خلال اختبارها وتحسينها. للتحقق من صحة المحتوى الذي تم إنشاؤه مقابل سياسة الاستدلال المؤتمت، يحتاج المستخدمون إلى تمكين السياسة في حواجز الحماية وتكوينها بقائمة من سياسات الاستدلال المؤتمت. تضمن عملية التحقق الخوارزمية القائمة على المنطق أن المعلومات التي تم إنشاؤها بواسطة النموذج تتوافق مع الحقائق المعروفة ولا تستند إلى بيانات ملفقة أو غير متسقة. توفر عمليات التحقق هذه ردودًا صادقة يمكن إثباتها من نماذج الذكاء الاصطناعي المولّد، مما يمكّن موردي البرامج من تعزيز موثوقية تطبيقاتهم لحالات الاستخدام في الموارد البشرية والتمويل والشؤون القانونية والامتثال وغير ذلك. لمعرفة المزيد، شاهد مقاطع الفيديو التعليمية.

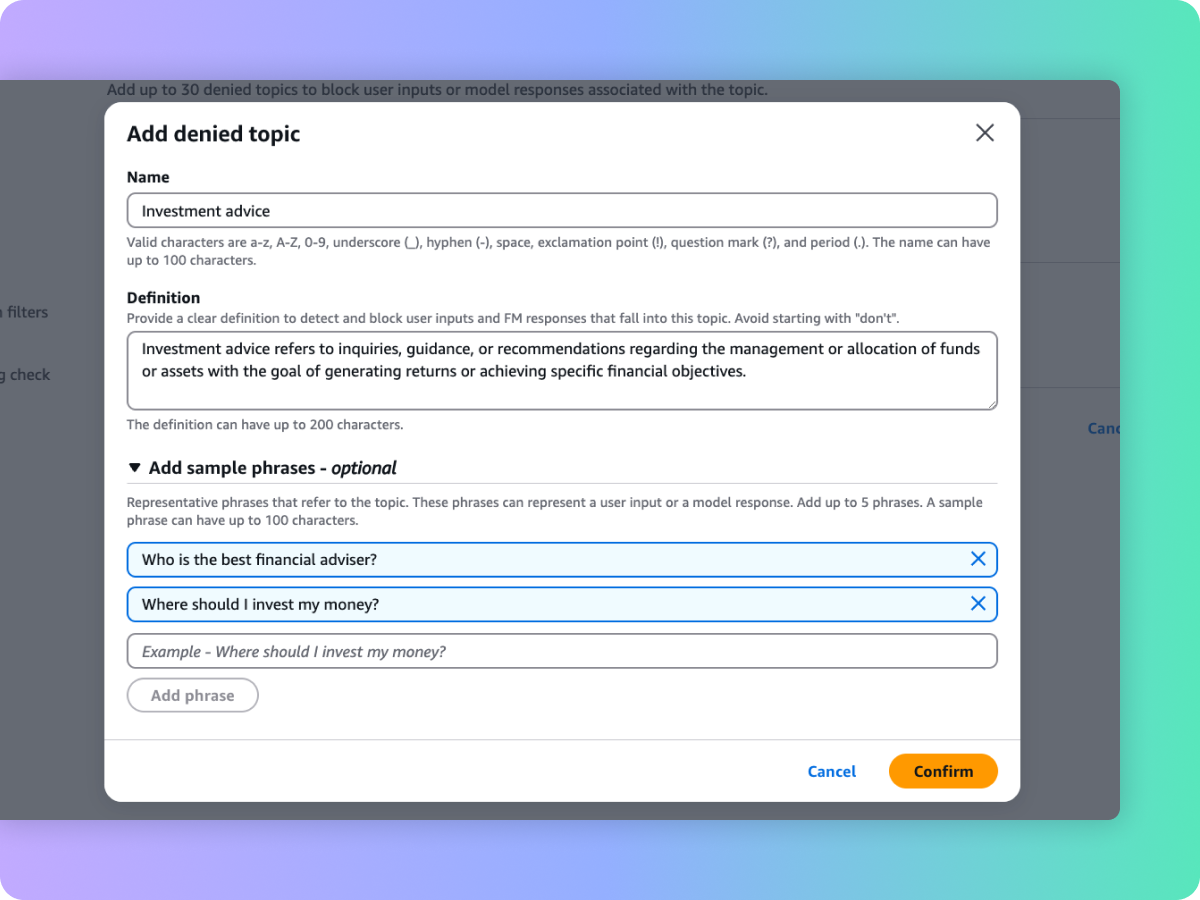

حظر الموضوعات غير المرغوب فيها في تطبيقات الذكاء الاصطناعي

يدرك القادة التنظيميون الحاجة إلى إدارة التفاعلات داخل تطبيقات الذكاء الاصطناعي المولّد للحصول على تجربة مستخدم ملائمة وآمنة. إنهم يريدون تخصيص التفاعلات بشكل أكبر لمواصلة التركيز على الموضوعات ذات الصلة بأعمالهم والتوافق مع سياسات الشركة. باستخدام وصف قصير للغة الطبيعية، تساعدك حواجز الحماية (Guardrails) في تحديد مجموعة من الموضوعات لتجنبها في سياق تطبيقك. تساعد حواجز الحماية (Guardrails) في اكتشاف مدخلات المستخدم وردود نموذج تأسيس (FM) التي تقع ضمن الموضوعات المحظورة وتمنعها. على سبيل المثال، يمكن تصميم مساعد مصرفي لتجنب الموضوعات المتعلقة بالنصائح الاستثمارية.

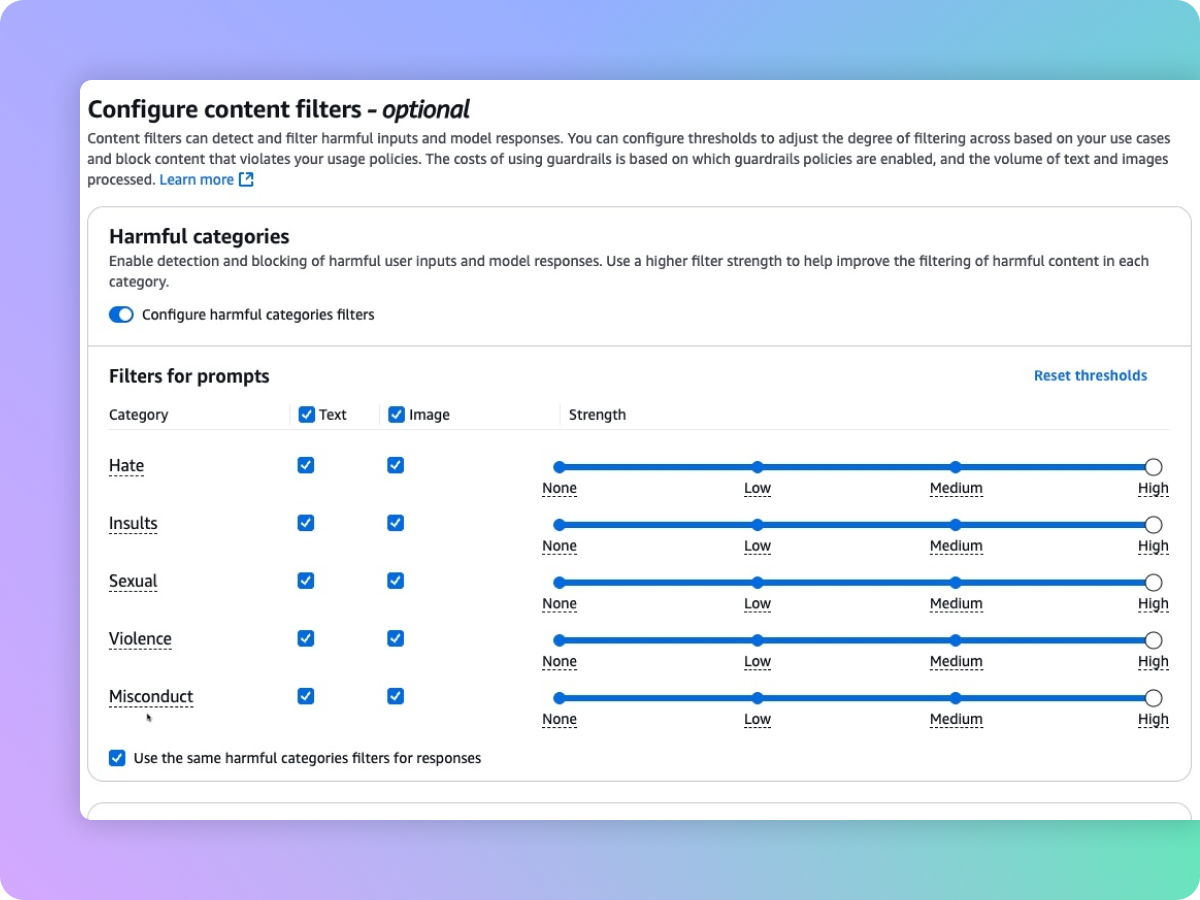

تصفية المحتوى الضار متعدد الوسائط بناءً على سياسات الذكاء الاصطناعي المسؤول

توفِّر حواجر الحماية (Guardrails) عوامل تصفية المحتوى بحدود قابلة للتكوين للنص الضار ومحتوى الصورة. تساعد الحماية على تصفية المحتوى الضار متعدد الوسائط الذي يحتوي على موضوعات مثل خطاب الكراهية والإهانات والجنس والعنف وسوء السلوك (بما في ذلك النشاط الإجرامي) وتساعد على الحماية من هجمات المطالبات (حقن الأوامر وكسر الحماية). تقوم عوامل تصفية المحتوى تلقائيًا بتقييم كل من مدخلات المستخدم وردود النموذج لاكتشاف النصوص و/أو الصور غير المرغوب فيها والمحتمل أن تكون ضارة والمساعدة في منعها. على سبيل المثال، يمكن لموقع تجارة إلكترونية تصميم مساعده عبر الإنترنت لتجنب استخدام لهجة غير لائقة مثل خطاب الكراهية أو الإهانات.

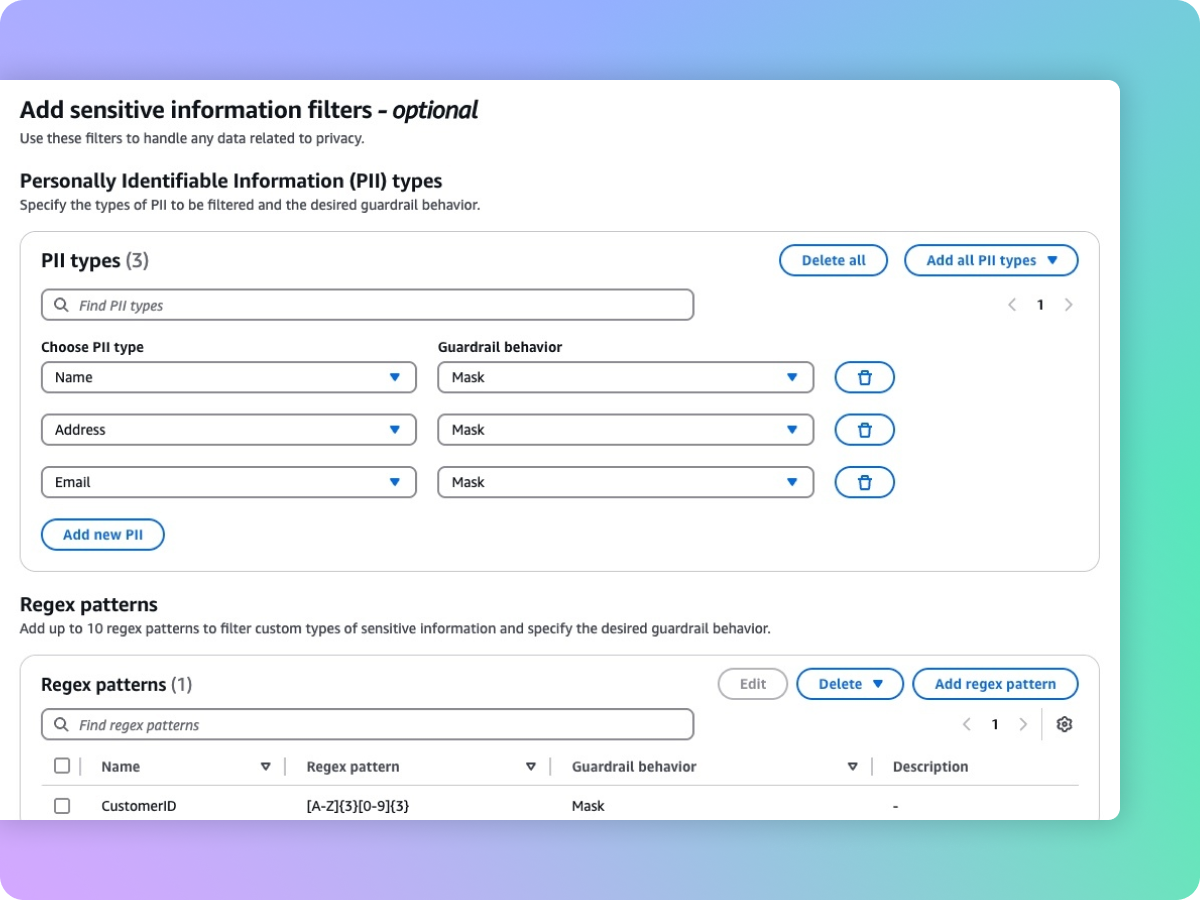

تنقيح المعلومات الحساسة مثل معلومات التعريف الشخصية (PII) لحماية الخصوصية

تساعدك حواجز الحماية (Guardrails) بالكشف عن المحتوى الحساس مثل معلومات التعريف الشخصية (PII) في مدخلات المستخدم وردود نموذج التأسيس (FM). يمكنك الاختيار من قائمة معلومات تحديد الهوية الشخصية (PII) أو تحديد نوع المعلومات الحساسة المخصصة باستخدام التعبيرات العادية (RegEx). استنادًا إلى حالة الاستخدام، يمكنك رفض المدخلات التي تحتوي على معلومات حساسة بشكل انتقائي أو تنقيحها في ردود نموذج التأسيس (FM). على سبيل المثال، يمكنك حذف المعلومات الشخصية للمستخدمين في أثناء إنشاء ملخصات من نصوص محادثة العملاء والوكلاء في مركز اتصال.

الخطوات التالية

هل وجدت ما كنت تبحث عنه اليوم؟

أخبرنا حتى نتمكن من تحسين جودة المحتوى الموجود على صفحاتنا