亚马逊AWS官方博客

构建专业化 AI 而不牺牲通用智能:Nova Forge 数据混合实战

摘要:本文通过一个真实企业场景中的客户之声(VOC)分类任务,评估了 Amazon Nova Forge 在领域任务微调中的表现。实验结果表明,借助数据混合(data mixing)策略,Nova Forge 能够在显著提升领域任务性能的同时,有效避免灾难性遗忘,保持模型的通用能力。该方法为企业在构建定制化 AI 模型时,在领域能力与通用能力之间取得平衡提供了一种实用方案。

目录

一、引言

大语言模型(LLM)在通用任务上表现出色,但在需要理解专有数据、内部流程和行业特定术语的专业化工作中往往力不从心。监督微调(Supervised Fine-Tuning,SFT)可以使 LLM 适应这些特定的企业任务场景。SFT 可以通过两种不同的方法实现:

- 参数高效微调(Parameter-Efficient Fine-Tuning,PEFT),仅更新模型参数的一个子集,训练速度更快、计算成本更低,同时能保持合理的性能提升;

- 全参数微调(Full-rank SFT),更新所有模型参数而非部分参数,相比 PEFT 能融入更多领域知识。

然而,全参数微调经常面临一个挑战:灾难性遗忘。当模型学习领域特定模式时,会丢失通用能力,包括指令遵循、推理和广泛的知识储备。组织不得不在领域专业能力和通用智能之间做出取舍,这限制了模型在企业级场景中的适用范围。

Amazon Nova Forge 正是为解决这一问题而生。Nova Forge是一项新服务,您可以使用它基于 Nova 构建自己的前沿模型。Nova Forge 客户可以从早期模型检查点开始开发,将专有数据与 Amazon Nova 精选的训练数据进行混合,并在 AWS 上安全地托管自定义模型。

在本文中,我们分享了 AWS 中国应用科学团队使用一项具有挑战性的客户之声(Voice Of Customer, VOC)分类任务对 Nova Forge 进行全面评估的结果,并与开源模型进行了基准对比。我们使用超过 16,000 条客户评论样本,涵盖包含 1,420 个叶子类别的复杂四级标签层次结构,展示了 Nova Forge 数据混合方法带来的两大优势:

二、挑战:真实场景中的客户反馈分类

设想一个大型电商公司的典型场景。客户体验团队每天收到数千条客户评论,涵盖产品质量、物流体验、支付问题、网站易用性和客服交互等各方面的详细反馈。为了高效运营,他们需要一个 LLM 能够自动将每条评论高精度地分类到可执行的类别中。每次分类必须足够精细,以便将问题路由到正确的团队——物流、财务、开发或客服,并触发相应的工作流程。这需要领域专业化能力。

然而,这个 LLM 并非孤立运作。在您的组织中,各团队还需要该模型能够:

- 生成面向客户的回复,这需要通用的沟通技能

- 执行数据分析,这需要数学和逻辑推理能力

- 编写遵循特定格式规范的文档

这些都需要广泛的通用能力——指令遵循、推理、跨领域知识和对话流畅性。

三、评估方法

测试概述

为验证 Nova Forge 能否同时提供领域专业化能力和通用能力,我们设计了一个双维度评估框架,从两个维度衡量模型性能。

领域特定性能方面,我们使用了一个从真实客户评论中提取的客户之声(VOC)数据集。数据集包含 14,511 个训练样本和 861 个测试样本,反映了生产级别的企业数据规模。数据集采用四级分类体系,其中第四级代表叶子类别(最终分类目标)。每个类别都包含其范围的描述性说明。示例类别如下:

|

一级类别 |

二级类别 |

三级类别 |

四级类别(叶子标签) |

|

安装与配置 |

初始设置引导 |

安装流程 |

安装过程简单:用户认为设备安装步骤清晰、配置流程简单易上手。 |

|

硬件使用体验 |

夜视性能 |

低光图像质量 |

夜视画面清晰:在弱光或夜间环境下,夜视模式仍能提供清晰的画面。 |

|

硬件使用体验 |

云台功能 |

旋转能力 |

支持360°旋转:摄像头可以实现完整的360度旋转,提供全景视角覆盖。 |

|

售后政策与费用 |

退换货政策 |

退货流程执行 |

因功能问题产品退货:用户因产品功能问题发起并完成退货流程。 |

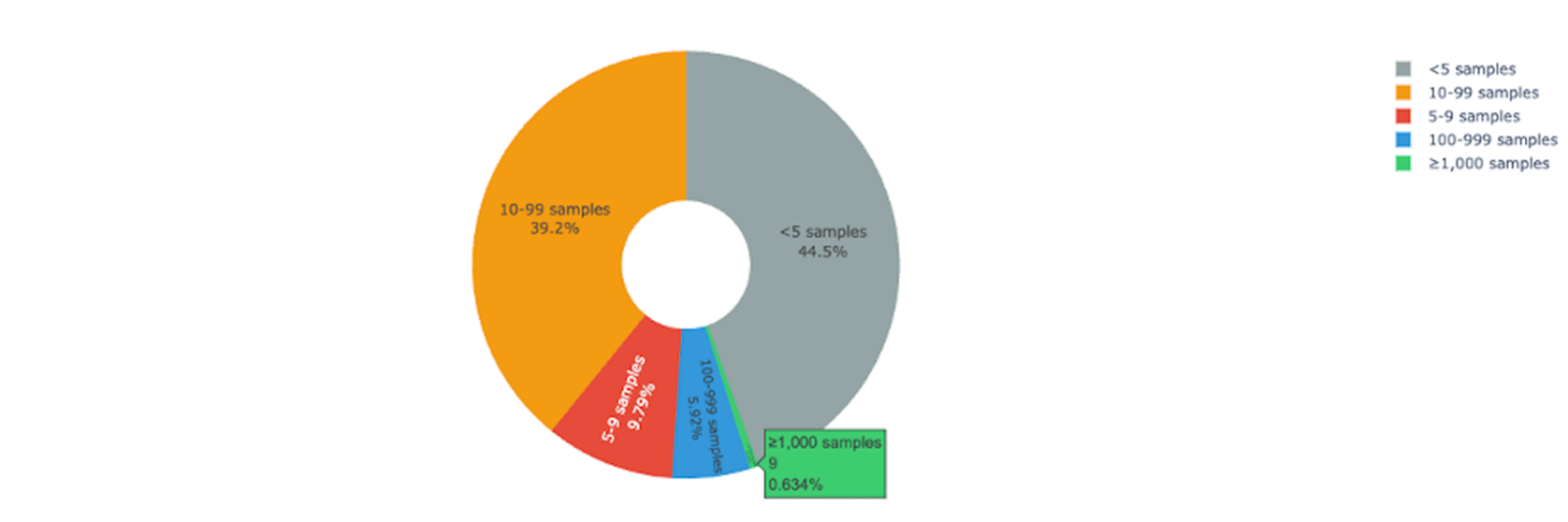

该数据集具有典型的长尾分布特征,不同类别之间的样本数量差异较大,这在真实的客户反馈数据中非常常见。下图展示了类别分布情况:

图1 |

因此,该数据集对分类准确性提出了重大挑战。

通用能力评估方面,我们使用 MMLU基准测试的公开测试集(所有子集)。测试涵盖人文学科、社会科学、自然科学及其他重要学科领域。在本文中,MMLU 作为通用能力保持的代理指标。我们用它来衡量监督微调在提升领域性能的同时是否会导致基础模型能力退化,并评估 Nova 数据混合在缓解灾难性遗忘方面的效果。

|

项目 |

说明 |

|

|

1 |

总样本数 |

15,372 条客户评论 |

|

2 |

标签层级 |

四级分类体系,共 1,420 个类别 |

|

3 |

训练集 |

14,511 条样本 |

|

4 |

测试集 |

861 条样本 |

|

5 |

MMLU 基准测试(test split) |

14,000 条样本 |

领域内任务评估:客户之声分类

为了了解 Nova Forge 在真实企业场景中的表现,我们首先评估模型在监督微调前后的 VOC 分类任务准确性。通过这种方式,我们可以量化领域适配带来的增益,同时为后续的鲁棒性分析建立基线。

基础模型评估

我们从基础模型评估开始,评估模型在未经任何任务特定微调的情况下在 VOC 分类任务上的开箱即用性能。此设置用于确定每个模型在严格输出格式约束下处理高粒度分类的固有能力。以下是用于 VOC 分类任务的提示词:

Role Definition

You are a rigorous customer experience classification system. Your sole responsibility is to map user feedback to the existing label taxonomy at Level 1 through Level 4 (L1–L4). You must strictly follow the predefined taxonomy structure and must not create, modify, or infer any new labels.

Operating Principles

1.Strict taxonomy alignment

All classifications must be fully grounded in the provided label taxonomy and strictly adhere to its hierarchical structure.

2.Feedback decomposition using MECE principles

A single piece of user feedback may contain one or multiple issues. You must carefully analyze all issues described and decompose the feedback into multiple non-overlapping segments, following the MECE (Mutually Exclusive, Collectively Exhaustive) principle:

Semantic singularity: Each segment describes only one issue, function, service, or touchpoint (for example, pricing, performance, or UI).

Independence: Segments must not overlap in meaning.

Complete coverage: All information in the original feedback must be preserved without omission.

3.No taxonomy expansion

You must not invent, infer, or modify any labels or taxonomy levels.

Label Taxonomy

The following section provides the label taxonomy: {tag category}. Use this taxonomy to perform L1–L4 classification for the original VOC feedback. No taxonomy expansion is allowed.

Task Instructions

You will be given a piece of user feedback: {user comment}. Users may come from different regions and use different languages. You must accurately understand the user’s language and intent before assigning labels.

Refer to the provided examples for the expected labeling format.

Output Format

Return the classification results in JSON format only. For each feedback segment, output the original text along with the corresponding L1–L4 labels and sentiment. Do not generate or rewrite content.

[

{

“content”: “”,

“L1”: “”,

“L2”: “”,

“L3”: “”,

“L4”: “”,

“emotion”: “”

}

]

在基础模型评估中,我们选择了:

- Amazon Nova 2 Lite:在 Amazon Bedrock上评估

- Qwen3-30B-A3B:在 Amazon Elastic Compute Cloud (Amazon EC2)上使用 vLLM部署的开源模型

|

模型 |

Precision |

Recall |

F1-Score |

|

|

1 |

Nova 2 Lite |

0.4596 |

0.3627 |

0.387 |

|

2 |

Qwen3-30B-A3B |

0.4567 |

0.3864 |

0.394 |

F1 分数显示,Nova 2 Lite 和 Qwen3-30B-A3B 在这项领域特定任务上表现相当,两个模型的 F1 分数均接近 0.39。这些结果也凸显了该任务的内在难度:即使是强大的基础模型,在没有领域特定数据的情况下也难以应对细粒度标签分类。

监督微调

接下来,我们使用客户 VOC 数据进行全参数监督微调。所有模型使用相同的数据集和相近的训练配置进行微调,以确保公平比较。

训练基础设施:

- Nova 2 Lite:在 Amazon SageMaker HyperPod 集群上使用四个 p5.48xlarge 实例进行微调(详见Nova customization SageMaker hyperpod topic in the Amazon SageMaker AI Developer Guide)

- Qwen3-30B-A3B:在 Amazon EC2 上使用 p6-b200.48xlarge 实例进行微调

领域内任务性能对比

|

模型 |

训练集 |

Precision |

Recall |

F1-Score |

|

|

1 |

Nova 2 Lite |

无(基线) |

0.4596 |

0.3627 |

0.387 |

|

2 |

Nova 2 Lite |

仅客户数据 |

0.6048 |

0.5266 |

0.5537 |

|

3 |

Qwen3-30B |

仅客户数据 |

0.5933 |

0.5333 |

0.5552 |

仅使用客户数据微调后,Nova 2 Lite 取得了显著的性能提升,F1 从 0.387 提高到 0.5537——绝对增益达 17 个百分点。这一结果使 Nova 模型跻身该任务的顶尖水平,性能与微调后的 Qwen3-30B 开源模型相当。这些结果证实了 Nova 全参数微调在复杂企业分类工作负载中的有效性。

通用能力评估:MMLU 基准测试

针对 VOC 分类微调的模型往往不仅用于单一任务,还会集成到更广泛的企业工作流中,因此保持通用能力至关重要。MMLU 等行业标准基准测试提供了一种有效机制,用于评估通用能力并检测微调模型中的灾难性遗忘。

对于微调后的 Nova 模型,Amazon SageMaker HyperPod 提供了开箱即用的评估方案,只需最少配置即可简化 MMLU 评估流程。

|

模型 |

训练数据 |

VOC F1-Score |

MMLU 准确率 |

|

|

1 |

Nova 2 Lite |

无(基线) |

0.38 |

0.75 |

|

2 |

Nova 2 Lite |

仅客户数据 |

0.55 |

0.47 |

|

3 |

Nova 2 Lite |

75% 客户数据 + 25% Nova 数据 |

0.5 |

0.74 |

|

4 |

Qwen3-30B |

仅客户数据 |

0.55 |

0.0038 |

实验结果显示,当 Nova 2 Lite 仅使用客户数据进行微调时, MMLU 准确率从 0.75 大幅下降至 0.47,表明通用能力出现明显损失。Qwen 模型的退化更为严重,微调后几乎完全丧失了指令遵循能力。以下是 Qwen 模型退化后的输出示例:

这一现象与 VOC任务的提示词设计也有关,其中类别知识通过监督微调内化到模型中——这是大规模分类系统中的常见做法。

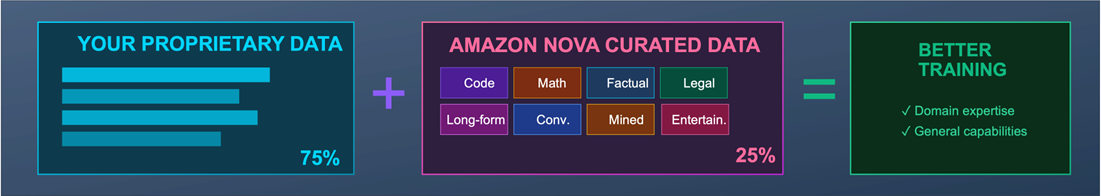

值得注意的是,当在微调过程中应用 Nova 数据混合时,Nova 2 Lite 保持了接近基线的通用性能。MMLU 准确率保持在 0.74,仅比原始基线低 0.01,同时 VOC F1 仍提升了 12 个百分点(0.38 → 0.50)。这验证了 Nova 数据混合是一种实用且有效的缓解灾难性遗忘的机制,同时还能保持领域性能。

关键发现与实践建议

本次评估表明,当基础模型具备良好的能力基础时,在 Amazon Nova Forge 上进行全参数监督微调可以为复杂的企业分类任务带来显著的性能提升。同时,结果也证实了灾难性遗忘在生产环境的微调工作流中是一个真实存在的问题。仅使用客户数据进行微调可能会削弱指令遵循和推理等通用能力,限制模型在更广泛业务场景中的可用性。

Nova Forge 的数据混合能力提供了一种有效的缓解策略。通过在微调过程中将客户数据与 Nova 精选数据集进行混合,可以在保持接近基线的通用能力的同时,继续获得强大的领域特定性能。

基于这些发现,我们建议在使用 Nova Forge 时遵循以下实践:

- 使用监督微调来最大化复杂或高度定制化任务的领域内性能。

- 当模型需要在生产环境中支持多种通用工作流时,应用 Nova 数据混合,以降低灾难性遗忘的风险。

这些实践相结合,有助于在模型定制化和生产鲁棒性之间取得平衡,使微调模型在企业环境中的部署更加可靠。

图2 |

四、总结

在本文中,我们展示了组织如何借助 Nova Forge 的数据混合能力构建专业化 AI 模型而不牺牲通用智能。根据您的使用场景和业务目标,Nova Forge 还可以带来其他优势,包括访问模型开发各阶段的检查点,以及在您的环境中使用奖励函数进行强化学习。要开始您的实验,请参阅 Nova Forge Developer Guide获取详细文档。

➡️ 下一步行动:

相关产品:

- Amazon Nova — 提供前沿智能和最高性价比的基础模型

- Amazon Q — 采用生成式人工智能技术的工作助理

- Amazon SageMaker — 适用于所有数据、分析和 AI 的中心

- Amazon EC2 — 安全且可调整大小的计算容量,支持几乎所有工作负载

- Amazon Bedrock — 用于构建生成式人工智能应用程序和代理的端到端平台

相关文章:

- Amazon Bedrock 上的模型擂台赛:DeepSeek、Nova、Claude,谁是最强文本审核大模型?

- Amazon Nova Multimodal Embeddings:最先进的代理 RAG 和语义搜索嵌入模型

- 使用 Amazon SageMaker 微调和部署 ChatGLM 模型

- 基于Strands Agents SDK和Amazon Bedrock AgentCore构建商品详情图广告词审查Agent

*前述特定亚马逊云科技生成式人工智能相关的服务目前在亚马逊云科技海外区域可用。亚马逊云科技中国区域相关云服务由西云数据和光环新网运营,具体信息以中国区域官网为准。

本篇作者

AWS 架构师中心:云端创新的引领者探索 AWS 架构师中心,获取经实战验证的最佳实践与架构指南,助您高效构建安全、可靠的云上应用 |

|