Amazon Web Services ブログ

AI ワークロードのパフォーマンスとコストの一致に役立つ新しい Amazon Bedrock サービスティア

2025 年 11 月 18 日、アプリケーションに必要なパフォーマンスレベルを維持しながら、AI ワークロードのコストをより細かく制御できる新しいサービスティアが Amazon Bedrock に導入されました。

私は、AI アプリケーションを構築しているお客様と仕事をしており、異なるワークロードには異なるパフォーマンスとコストトレードオフが必要になることを現場で直接見てきました。AI ワークロードを実行する組織の多くは、パフォーマンス要件とコスト最適化のバランスを取るという課題に直面します。アプリケーションには、リアルタイムでのやり取りのために高速な応答時間を必要とするものもあれば、データをより段階的に処理できるものもあります。これらの課題を念頭に、ワークロード要件とコスト最適化の一致における柔軟性を高める追加の料金オプションが本日発表されました。

Amazon Bedrock では、ワークロード向けに Priority、Standard、Flex の 3 つのサービスティアが提供されるようになりました。各ティアは、特定のワークロード要件に一致するように設計されています。アプリケーションには、ユースケースに基づくさまざまな応答時間要件があります。最速の応答時間が求められる金融取引システムなどのアプリケーションもあれば、コンテンツ生成といったビジネスプロセスをサポートするために高速な応答時間が必要になるアプリケーションや、データをより段階的に処理できるコンテンツ要約などのアプリケーションもあります。

Priority ティアは、他のティアよりも先にリクエストを処理するため、コンピューティングリソースがチャットベースの顧客対応アシスタントや、リアルタイムの言語翻訳サービスといったミッションクリティカルなアプリケーションに優先的に割り当てられますが、料金は他のティアより割高になります。Standard ティアは、日常的な AI タスクのための一貫的なパフォーマンスを通常料金で提供し、コンテンツ生成、テキスト分析、定形化されたドキュメント処理に最適です。より長いレイテンシーに対応できるワークロードの場合は、低料金の Flex ティアがコスト効率に優れたオプションを提供します。このティアは、モデル評価、コンテンツ要約、マルチステップ分析ワークフロー、エージェンティックワークフローに最適です。

今後は、各ワークロードを最も適切なティアに一致させることで支出を最適化できるようになります。例えば、迅速な対応が必要なチャットベースのカスタマーサービスアシスタントを実行している場合は、Priority ティアを使用して最速の処理時間を達成できます。より長い処理時間に対応できるコンテンツ要約タスクの場合は、信頼性の高いパフォーマンスを維持しながらコストを削減するために Flex ティアを使用できます。Priority ティアをサポートするモデルでは、お客様がそのほとんどで Standard ティアよりも最大 25% 優れた OTPS (1 秒あたりの出力トークン数) レイテンシーを実現できます。

各サービスティアでサポートされるモデルの最新リストについては、Amazon Bedrock ドキュメントをご覧ください。

ワークロードに適したティアの選択

以下は、ワークロードに適したティアの選択に役立つメンタルモデルです。

| カテゴリー | 推奨されるサービスティア | 説明 |

|---|---|---|

| ミッションクリティカル | Priority | 他のティアよりも先にリクエストが処理されます。ユーザー向けアプリ (カスタマーサービスのチャットアシスタント、リアルタイムの言語翻訳、インタラクティブな AI アシスタントなど) のための低レイテンシー応答 |

| ビジネス (標準) | Standard | 重要なワークロード (コンテンツ生成、テキスト分析、定型化されたドキュメント処理など) のための応答性に優れたパフォーマンス |

| ビジネス (ノンクリティカル) | Flex | 緊急性の低いワークロード (モデル評価、コンテンツ要約、複数ステップのエージェンティックワークフローなど) のための優れたコスト効率性 |

アプリケーション所有者とともに現在の使用パターンを確認することから始めます。次に、即時応答が必要なワークロードと、データをより段階的に処理できるワークロードを特定します。その後、異なるティアを使用してトラフィックのごく一部のルーティングを開始し、パフォーマンス面とコスト面のメリットをテストできます。

AWS 料金見積りツールは、予想されるワークロードを各ティアに入力することで、異なるサービスティアのコスト見積もりに役立ちます。特定の使用パターンに基づいて予算を見積もることができます。

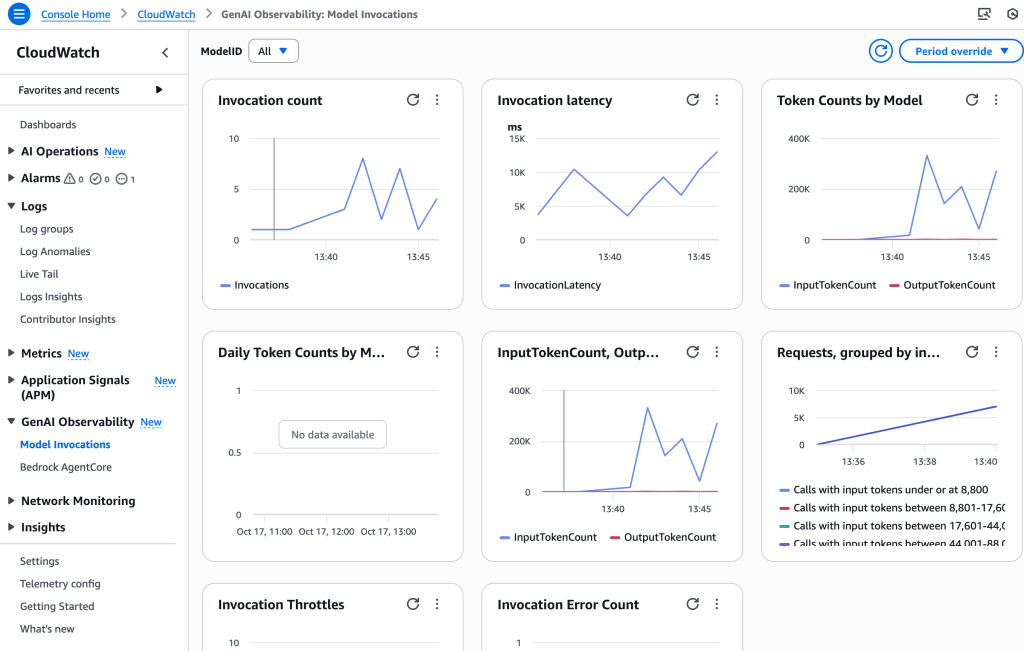

使用状況とコストを監視するには、AWS Service Quotas コンソールを使用するか、Amazon Bedrock でモデル呼び出しのログ記録を有効にし、Amazon CloudWatch を使用してメトリクスを観察できます。これらのツールはトークンの使用状況を可視化し、さまざまなティア全体でのパフォーマンスの追跡に役立ちます。

新しいサービスティアは、今すぐ使用を開始できます。API コールごとにティアを選択します。以下は ChatCompletions OpenAI API を使用した例ですが、InvokeModel、InvokeModelWithResponseStream、Converse、および ConverseStream API のボディで同じ service_tier パラメータを渡すことができます (サポートされるモデルの場合)。

from openai import OpenAI

client = OpenAI(

base_url="https://bedrock-runtime.us-west-2.amazonaws.com/openai/v1",

api_key="$AWS_BEARER_TOKEN_BEDROCK" # Replace with actual API key

)

completion = client.chat.completions.create(

model= "openai.gpt-oss-20b-1:0",

messages=[

{

"role": "developer",

"content": "You are a helpful assistant."

},

{

"role": "user",

"content": "Hello!"

}

]

service_tier= "priority" # options: "priority | default | flex"

)

print(completion.choices[0].message)詳細については、「Amazon Bedrock User Guide」を参照するか、詳しい計画策定のサポートについて AWS アカウントチームまでお問い合わせください。

皆さんがこれらの新しい料金オプションを使用して AI ワークロードを最適化する方法を聞くのを楽しみにしています。皆さんの経験は、ソーシャルネットワークを通じてオンラインで共有、または AWS イベントで私と共有してください。

原文はこちらです。