亚马逊AWS官方博客

Amazon Bedrock 中推出 Anthropic Claude Opus 4.7 模型

今天,我们将在 Amazon Bedrock 中推出 Claude Opus 4.7,这是 Anthropic 最智能的 Opus 系列模型,可在编码、长期运行的代理任务以及专业工作中全面提升性能。

Claude Opus 4.7 由 Amazon Bedrock 的下一代推理引擎提供支持,为生产工作负载提供企业级基础设施。Bedrock 的新推理引擎具有全新的调度和扩展逻辑,可为请求动态分配容量,从而提高可用性,尤其是稳定状态工作负载的可用性,同时为快速扩展服务腾出空间。其提供零操作员访问权限,这意味着 Anthropic 或 AWS 运营商永远看不到客户的提示和响应,从而保持敏感数据的私密性。

Anthropic 表示,Claude Opus 4.7 模型改进了团队在生产中运行的工作流程,例如代理编码、知识工作、视觉理解、长期运行任务。Opus 4.7 可以更好地解决歧义,解决问题更彻底,并且可以更精确地遵循指令。

- 代理编码:该模型延续了 Opus 4.6 在代理编码领域的领先地位,在长时程自主性、系统工程和复杂的代码推理任务方面表现更强。根据 Anthropic 的数据,该模型在 SWE-bench Pro 上取得了 64.3% 的高性能分数,在 SWE-bench Verified 上的分数为 87.6%,在 Terminal-Bench 2.0 上的分数为 69.4%。

- 知识工作:该模型在专业知识工作方面取得了进步,在文档创建、财务分析和多步研究工作流程方面表现更强。该模型能够对不明确的请求进行推理,做出合理的假设并清晰地陈述出来,同时还能自我验证其输出,以期在第一步就提高质量。根据 Anthropic 的数据,该模型在 Finance Agent v1.1 上取得了 64.4% 的成绩。

- 长期运行任务:该模型能够在更长的时程内保持一切正常,其能够对有歧义之处进行推理并自我验证输出,因此在其完整的 100 万词元上下文窗口中表现更强。

- 视觉能力:该模型新增了对高分辨率图像的支持,并针对图表、密集文档以及注重细节的屏幕 UI 提升了准确性。

该模型是对 Opus 4.6 的升级,但可能需要更改提示并调整调用框架才能充分发挥模型的性能。要了解更多信息,请访问 Anthropic 提示指南。

运行中的 Claude Opus 4.7 模型

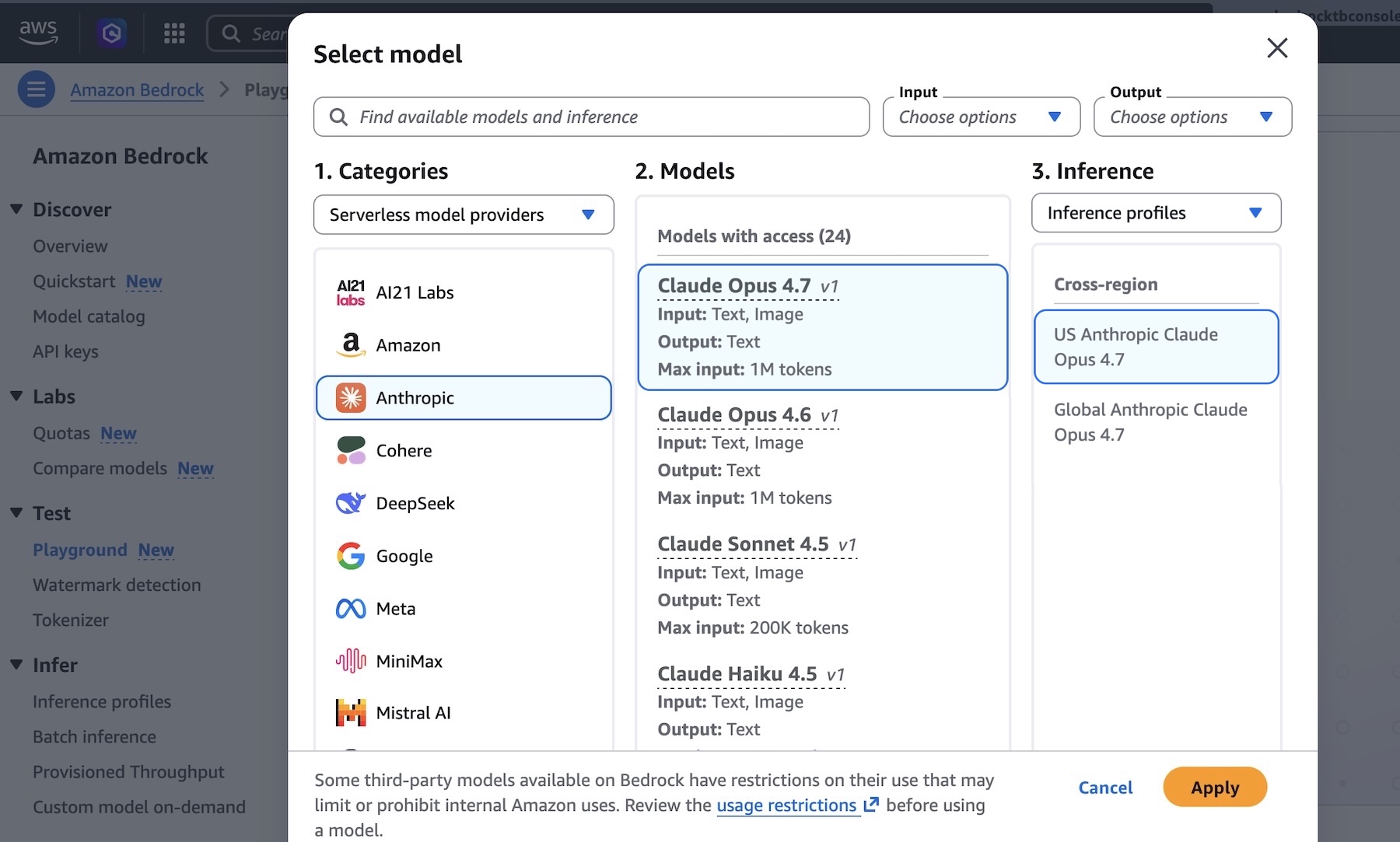

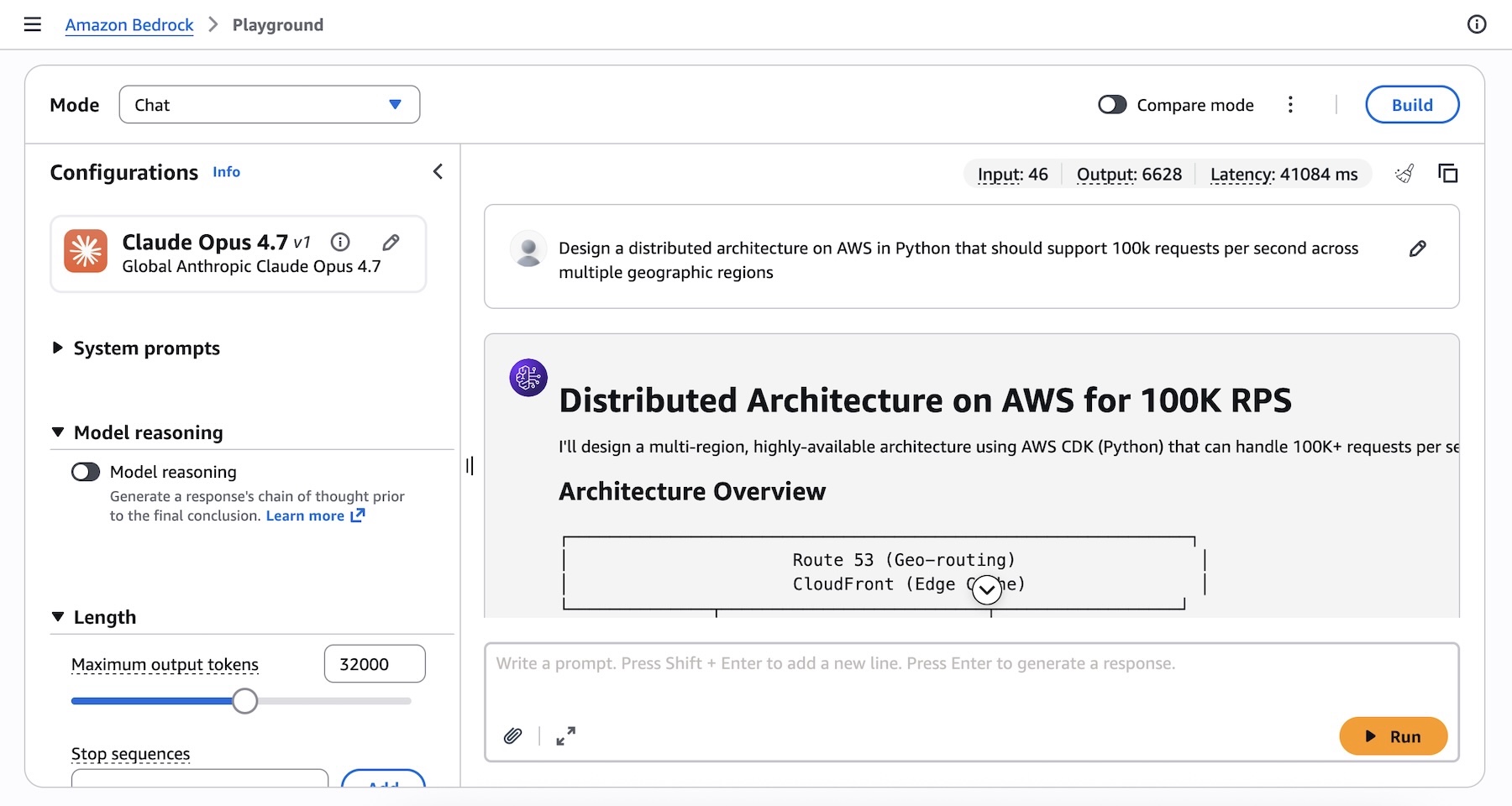

您可以在 Amazon Bedrock 控制台中开始使用 Claude Opus 4.7 模型。在“测试”菜单下选择“演练场”,在选择模型时选择 Claude Opus 4.7。现在,您可以使用模型测试复杂的编码提示。

我运行了以下有关技术架构决策的示例提示:

在 AWS 上设计一个分布式的 Python 架构,该架构需要跨多个地理区域支持每秒 10 万次请求。

您还可以使用 Anthropic Messages API,通过 Anthropic SDK 或 bedrock-mantle 端点调用 bedrock-runtime,从而以编程方式访问模型,或者继续使用 AWS 命令行界面(AWS CLI)和 AWS SDK 通过 bedrock-runtime 调用 Invoke 和 Converse API。

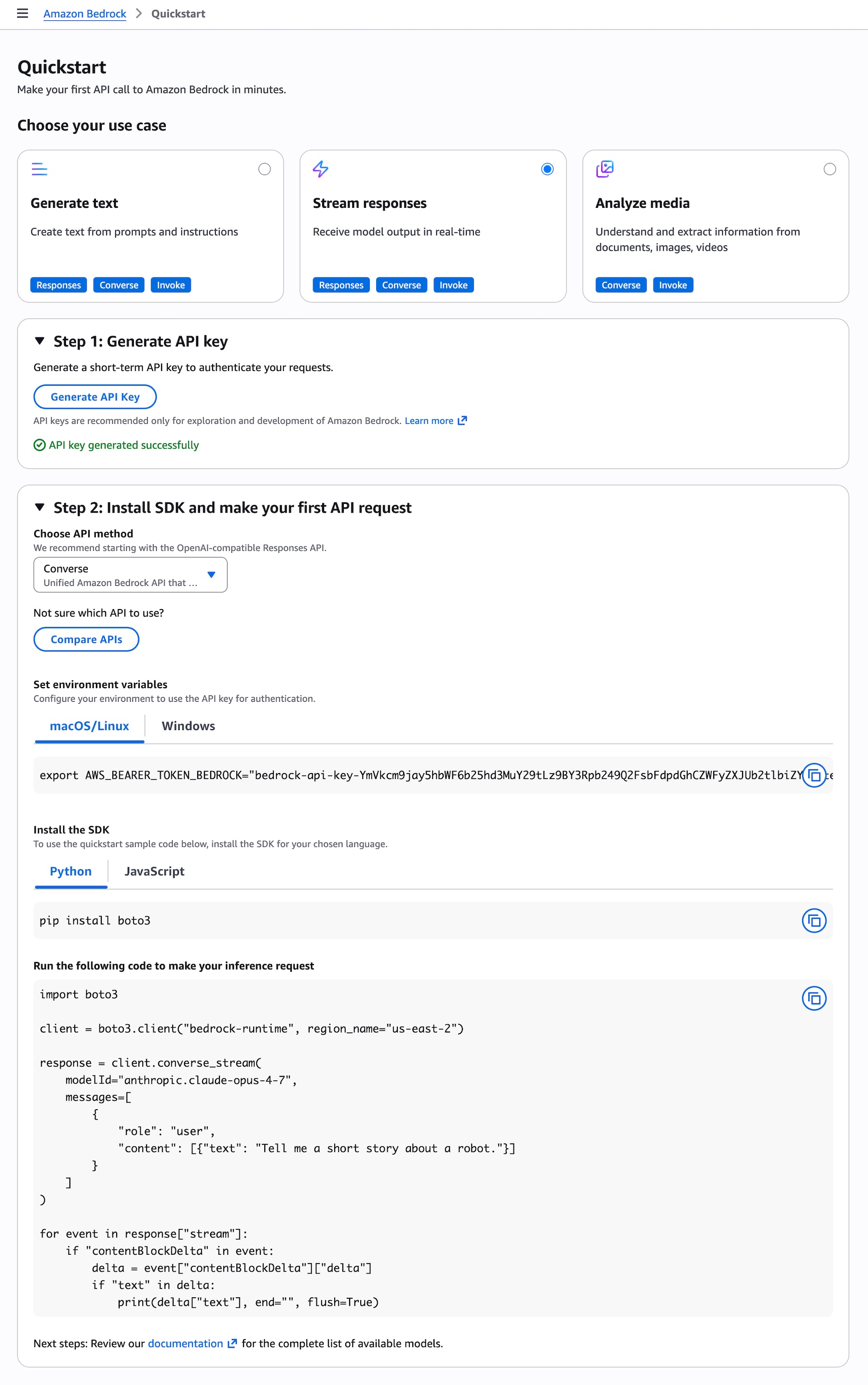

要在几分钟内开始对 Amazon Bedrock 进行首次 API 调用,请在控制台的左侧导航窗格中选择快速入门。选择使用案例后,您可以生成一个短期 API 密钥来验证您的请求,用于测试目的。

当您选择 API 方法(例如兼容 OpenAI 的 Responses API)时,您可以获取示例代码,运行您的提示并使用模型进行推理请求。

要通过 Anthropic Claude Messages API 调用模型,您可以使用 anthropic[bedrock] SDK 包获得简单便捷的体验,操作如下:

from anthropic import AnthropicBedrockMantle

# 初始化 Bedrock Mantle 客户端(自动使用 SigV4 身份验证)

mantle_client = AnthropicBedrockMantle(aws_region="us-east-1")

# 使用 Messages API 创建消息

message = mantle_client.messages.create(

model="anthropic.claude-opus-4-7",

max_tokens=10000,

messages=[

{"role": "user", "content": "在 AWS 上设计一个分布式的 Python 架构,该架构需要跨多个地理区域支持每秒 10 万次请求"}

]

)

print(message.content[0].text)您还可以运行以下命令,使用 AWS CLI 和 Invoke API 将模型直接调用到 bedrock-runtime 端点:

aws bedrock-runtime invoke-model \

--model-id anthropic.claude-opus-4-7 \

--region us-east-1 \

--body '{"messages": [{"role": "user", "content": "在 AWS 上设计一个分布式的 Python 架构,该架构需要跨多个地理区域支持每秒 10 万次请求。"}], "max_tokens": 32000}' \

--cli-binary-format raw-in-base64-out \

invoke-model-output.txt为了获得更强的智能推理能力,您可以对 Claude Opus 4.7 使用自适应思考,该功能允许 Claude 根据每个请求的复杂度,动态分配思考词元预算。

要了解更多信息,请访问 Anthropic Claude Messages API,并查看多个使用案例和各种编程语言的代码示例。

注意事项

接下来,我将分享一些重要的技术细节,我认为这些细节会对您有用。

- 选择 API:您可以从多种 Bedrock API 中进行选择,用于模型推理,也可以选择 Anthropic Messages API。Bedrock 原生的 Converse API 支持多轮对话和护栏集成。Invoke API 提供直接的模型调用和最低级别的控制。

- 扩缩和容量:Bedrock 的新推理引擎旨在快速预置并提供跨多种模型的容量。在接受请求时,我们优先保持稳定状态工作负载运行,并根据需求变化,快速增加使用量和容量。

现已推出

Anthropic 的 Claude Opus 4.7 型号现已在美国东部(弗吉尼亚州北部)、亚太地区(东京)、欧洲地区(爱尔兰)和欧洲地区(斯德哥尔摩)区域推出;请查看完整区域列表,了解未来更新。要了解更多信息,请访问 Amazon Bedrock 中的 Claude by Anthropic 页面和 Amazon Bedrock 定价页面。

立即在 Amazon Bedrock 控制台中试试 Anthropic Claude Opus 4.7 吧,然后将反馈发送至 Amazon Bedrock AWS re:Post,也可以通过您常用的 AWS Support 联系人发送。

— Channy