AWS Germany – Amazon Web Services in Deutschland

Vorstellung von Amazon Nova 2 Sonic: Unser neues Speech-to-Speech-Modell für Conversational AI

Hiermit geben wir die allgemeine Verfügbarkeit von Amazon Nova 2 Sonic bekannt, einem Speech-to-Speech Foundation Model, das natürliche Sprachkonversationen in Echtzeit in Ihre Anwendungen bringt. Das Modell bietet branchenführende Gesprächsqualität, attraktive Preise und ein erstklassiges Sprachverständnis für Entwickler, die Sprachanwendungen erstellen.

Amazon ist seit über einem Jahrzehnt führend im Bereich sprachbasierter Technologien. Anfang dieses Jahres haben wir die erste Generation von Nova Sonic eingeführt, um die grundlegende Herausforderung wirklich flüssiger Sprachinteraktionen zu lösen: die Bewahrung des akustischen Kontextes, um die Sprachantwort nicht nur an das anzupassen, was der Benutzer gesagt hat, sondern auch wie er es gesagt hat. Mit Nova 2 Sonic bauen wir auf diesem Fundament auf. Wir machen das Modell leistungsfähiger und zugänglicher, verbessern die Modellintelligenz und die Fähigkeiten von Agenten, erweitern die Sprachunterstützung und fügen eine breite Palette neuer Funktionen hinzu, um intuitivere, menschenähnliche Sprachinteraktionen zu ermöglichen.

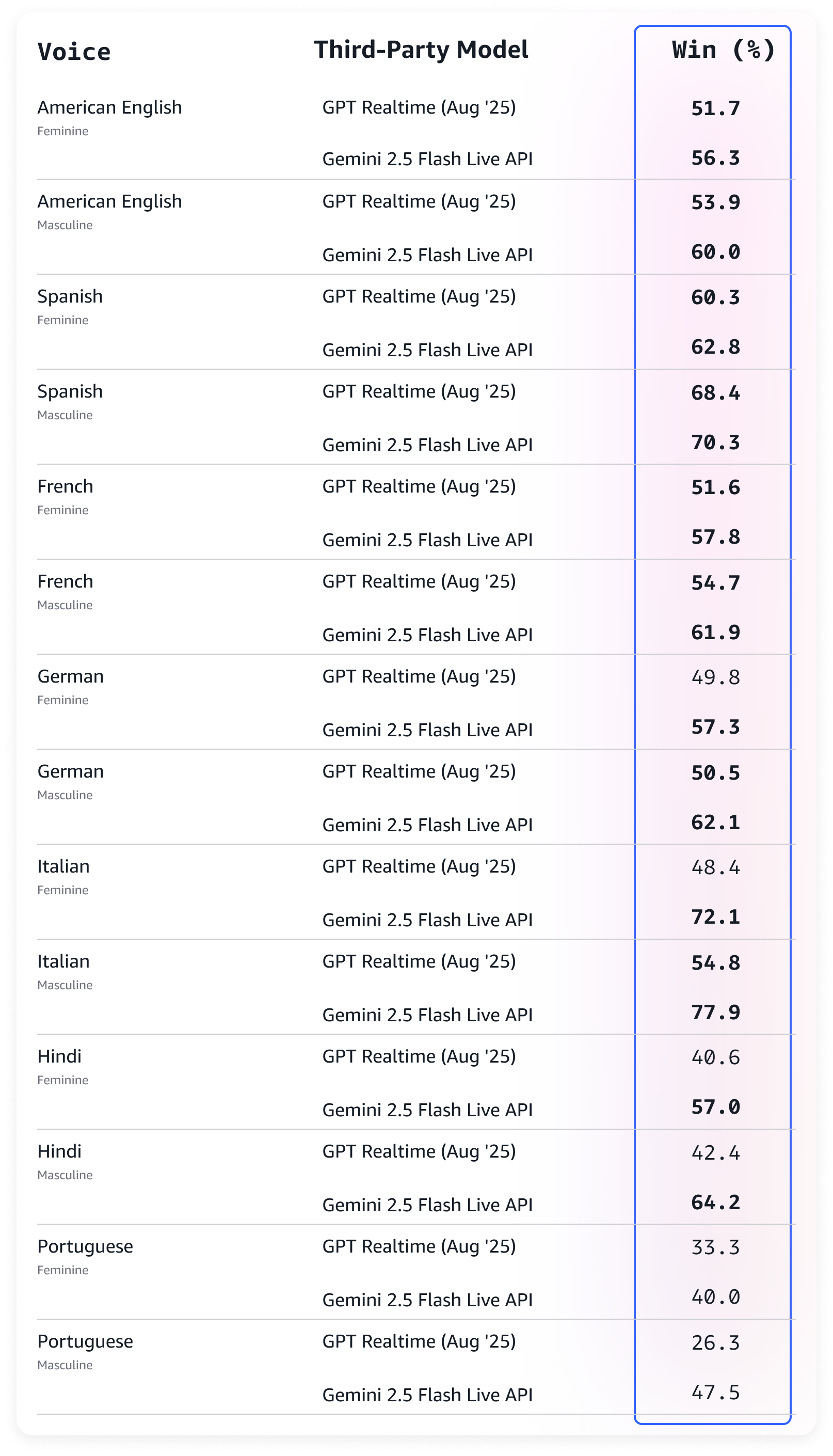

Nova 2 Sonic bietet ausdrucksstarke Stimmen – sowohl männliche als auch weibliche Stimmen in jeder der unterstützten Sprachen – mit natürlicher Ausdruckskraft, natürlichem Sprecherwechsel (Turn-Taking) und nahtlosem Umgang mit Unterbrechungen durch den Benutzer. Bewertungen der menschlichen Präferenz zeigen, dass Zuhörer die Ausgabe von Nova 2 Sonic gegenüber anderen führenden Modellen in Bezug auf das allgemeine Hörerlebnis konsequent bevorzugen.

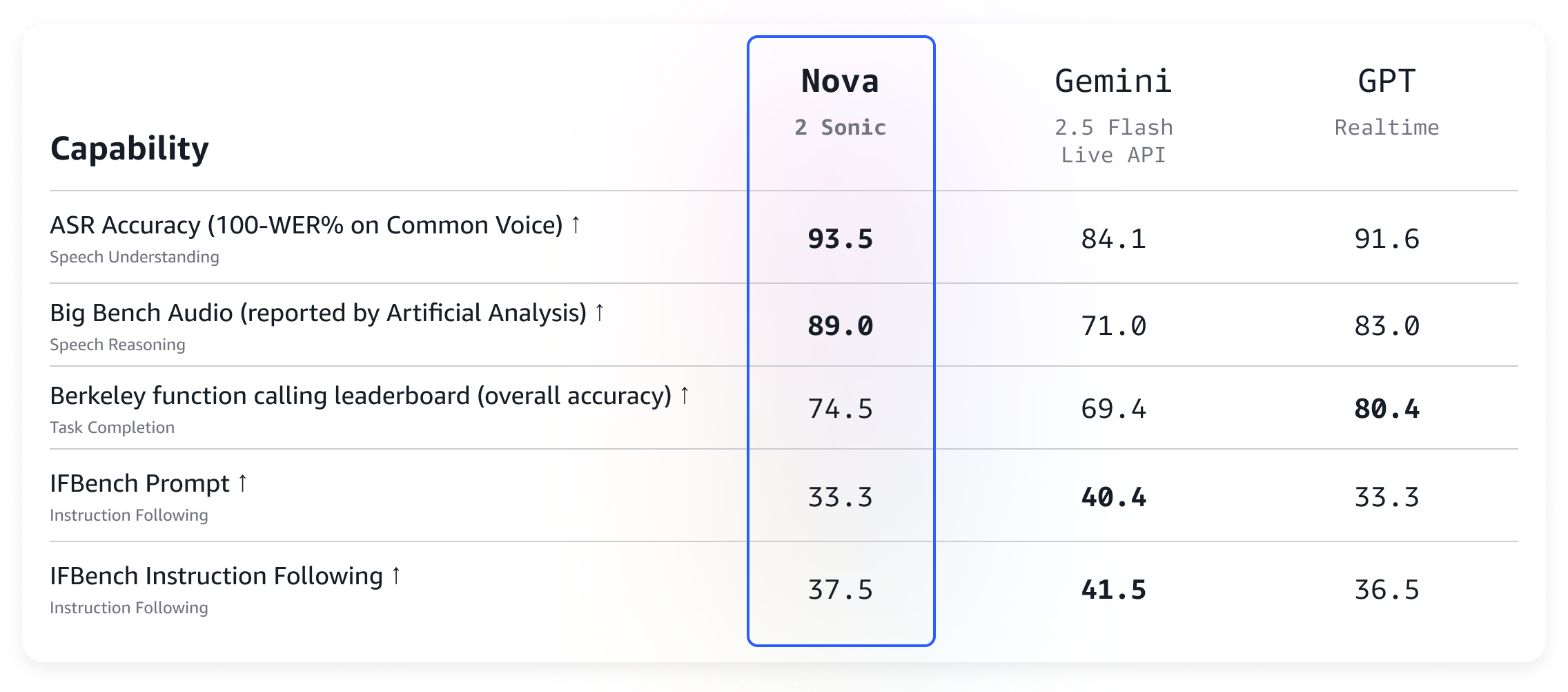

Nova 2 Sonic liefert starke Intelligenz und zuverlässigeres Agentenverhalten, gestützt durch Verbesserungen bei wichtigen Bewertungs-Benchmarks. Das Modell übertrifft andere führende Conversational AI-Modelle bei Big Bench Audio, einem Bewertungsdatensatz zur Beurteilung von logischen Fähigkeiten bei Audioeingaben. Der Score im BFCL-Benchmark unterstreicht das präzisere und konsistentere Aufrufen von Funktionen (Function Calling), während die Ergebnisse des ComplexFuncBench eine bessere Handhabung von mehrstufigen Aufgaben mit vielen Einschränkungen widerspiegeln. Wir haben Common Voice verwendet, um eine verbesserte Genauigkeit der automatischen Spracherkennung (ASR) zu demonstrieren, und Instruction-Following Evaluation (IFEval), um eine höhere Genauigkeit beim Befolgen detaillierter, strukturierter Anweisungen zu zeigen.

Verbessertes Sprachverständnis

Die zugrundeliegenden Spracherkennungsfähigkeiten wurden in Nova 2 Sonic erheblich verbessert. Das Modell verarbeitet jetzt alphanumerische Eingaben, kurze Äußerungen und 8KHz-Telefoniespracheingaben mit verbesserter Genauigkeit. Es ist zudem robuster im Umgang mit verschiedenen Akzenten und Hintergrundgeräuschen – entscheidend für reale Einsatzszenarien.

Erweiterte globale Reichweite mit polyglotten Stimmen

Eines der wichtigsten Updates in Nova 2 Sonic ist die erweiterte Sprachunterstützung. Neben den ursprünglichen Sprachen Englisch, Französisch, Italienisch, Deutsch und Spanisch unterstützt Nova 2 Sonic nun auch Portugiesisch und Hindi.

Über die Unterstützung mehrerer Sprachen hinaus führt Nova 2 Sonic polyglotte Stimmen ein – individuelle Stimmen, die innerhalb derselben Konversation zwischen Sprachen wechseln können. Die Stimme „Tiffany“ kann beispielsweise jetzt alle unterstützten Sprachen flüssig in einer einzigen Interaktion sprechen. Dies bietet fortschrittliche Fähigkeiten für Code-Switching (der linguistische Fachbegriff für das Mischen von Sprachen innerhalb von Sätzen), wodurch gemischtsprachige Sätze natürlich behandelt werden. So kann das Modell beispielsweise in der bevorzugten Sprache des Benutzers antworten, wenn dieser im gleichen Dialog von einer Sprache zur nächsten wechselt.

Für Entwickler bedeutet dies, dass Sie Anwendungen erstellen können, die ein globales Publikum bedienen, ohne separate Sprachmodelle für jede Sprache zu benötigen. Eine Kundensupport-Anwendung könnte einen Dialog verarbeiten, der auf Englisch beginnt und mitten im Gespräch ins Spanische wechselt, wobei der gleiche Gesprächsfluss und die gleichen Stimmcharakteristika beibehalten werden.

Natürlicher Sprecherwechsel (Turn-Taking)

Das Turn-Taking wurde mit einer konfigurierbaren Empfindlichkeit für die Spracherkennung (Voice Activity Detection) verbessert. Entwickler können diese je nach Anwendungsfall auf hoch, mittel oder niedrig einstellen. Eine hohe Empfindlichkeit optimiert für die schnellsten Antwortzeiten, während eine niedrige Empfindlichkeit den Benutzern mehr Zeit lässt, ihre Gedanken zu formulieren. Dies ist beispielsweise nützlich für Bildungsanwendungen oder um Conversational AI für Benutzer mit unterschiedlichen Kommunikationspräferenzen bereitzustellen.

Nahtlose cross-modale Interaktionen

Mit der Cross-Modal-Unterstützung können Benutzer innerhalb derselben Sitzung zwischen Text- und Spracheingabe wechseln. Dies ist wertvoll für Anwendungen, bei denen Benutzer einige Anfragen sprechen und andere tippen möchten – etwa eine schnelle Frage sprechen, aber eine komplexe Adresse oder technische Spezifikation tippen.

Die Implementierung behält den Kontext über die Modalitäten hinweg bei, sodass ein Benutzer ein Gespräch mit einer getippten Frage beginnen, eine gesprochene Antwort erhalten und dann mit Spracheingabe fortfahren kann, ohne den aktuellen Faden zu verlieren. Dies schafft flüssigere, flexiblere Interaktionen, die sich daran anpassen, wie Benutzer tatsächlich kommunizieren möchten.

Sie können die Cross-Modal-Funktion jetzt nutzen, um das Modell per Text aufzufordern, zu Beginn des Dialogs eine personalisierte Willkommensbegrüßung auszusprechen (um als Erster zu sprechen), oder Text-Metadaten verwenden, die Tastenfeld-Töne repräsentieren, um interaktive Sprachantwortsysteme (IVR) zu steuern. Zum Beispiel bei einem ausgehenden Anruf mit Nova 2 Sonic, um eine Reservierung im Namen des Benutzers vorzunehmen oder eine Voicemail zu hinterlassen.

Fortschrittliche Multi-Agenten-Fähigkeiten

Nova 2 Sonic führt asynchrone Tool-Aufrufe ein, die verbessern, wie sprachbasierte Conversational AI komplexe, mehrstufige Aufgaben handhabt. Wenn das Modell externe Tools oder Dienste aufrufen muss, pausiert es nicht, sondern reagiert weiterhin auf neue Benutzereingaben, während die Tools im Hintergrund laufen.

So sieht das in der Praxis aus: Ein Benutzer fragt vielleicht „Wie ist das Wetter?“ und schiebt sofort hinterher: „Was steht als Nächstes auf meiner Aufgabenliste?“ Nova 2 Sonic verarbeitet all diese Anfragen, antwortet sofort auf die Frage und liefert dann die Wetter- und Aufgabeninformationen, sobald die jeweiligen Tools ihre Ergebnisse zurückgeben.

Genau wie wir in einer Diskussion natürlich mit mehreren gleichzeitigen Themen umgehen, unterstützt diese Fähigkeit anspruchsvolle Interaktionen, die mehrere unabhängige Aufgaben verwalten können, während Engagement und Reaktionsfähigkeit erhalten bleiben.

Verbesserte Telefonie- und Plattformintegration

Da viele Conversational AI-Anwendungen über verschiedene Kommunikationskanäle hinweg funktionieren müssen, bietet Nova 2 Sonic jetzt direkte Integrationen mit führenden Telefonieanbietern wie Amazon Connect, Vonage, Twilio und Audiocodes sowie Medienplattformen wie LiveKit und Pipecat.

Diese Integrationen bewältigen die komplexen technischen Anforderungen telefonbasierter Interaktionen, wie Audio-Codec-Optimierung, Verwaltung des Sitzungslebenszyklus, bidirektionale Behandlung von Eingabe-/Ausgabeereignissen und die akustischen Herausforderungen von Telefoniesystemen. Für Entwickler bedeutet dies, dass Sie Nova 2 Sonic-gestützte Anwendungen direkt in bestehende Call-Center-Infrastrukturen implementieren oder neue telefonbasierte Dienste erstellen können, ohne die zugrundeliegende Telefoniekomplexität verwalten zu müssen.

Erste Schritte mit Nova 2 Sonic

Nova 2 Sonic ist über Amazon Bedrock unter der Modell-ID amazon.nova-2-sonic-v1:0 verfügbar. Wenn Sie Nova Sonic bereits in Ihren Anwendungen verwenden, ist das Update auf die neue Version unkompliziert – aktualisieren Sie einfach die Modell-ID in Ihrem bestehenden Code, und Ihre Anwendung profitiert sofort von den Verbesserungen, die keine zusätzlichen Konfigurationen erfordern.

Das Modell verwendet dieselbe bidirektionale Streaming-API wie das ursprüngliche Nova Sonic, sodass Ihre bestehenden Integrationsmuster und Event-Handling-Codes weiterhin funktionieren. Neue Funktionen wie cross-modale Eingabe und konfigurierbares Turn-Taking sind über zusätzliche Parameter und Ereignisse verfügbar, die Sie schrittweise übernehmen können.

Um mit den Code-Beispielen für mehrere Programmiersprachen zu beginnen, sehen Sie sich die Amazon Nova Sonic Speech-to-Speech Model Samples an.

Wissenswertes

Amazon Nova 2 Sonic ist in den AWS-Regionen US East (N. Virginia), US West (Oregon), Asia Pacific (Tokyo) und Europe (Stockholm) verfügbar. Für regionale Verfügbarkeit und die zukünftige Roadmap besuchen Sie AWS Capabilities by Region.

Nova 2 Sonic behält das branchenführende Preis-Leistungs-Verhältnis und die niedrige Latenz des ursprünglichen Nova Sonic bei. Preisinformationen finden Sie auf der Amazon Bedrock Preisseite.

Das Modell unterstützt dieselben robusten Sicherheits- und Compliance-Funktionen wie andere Amazon Bedrock-Modelle, einschließlich Verschlüsselung bei Übertragung und im Ruhezustand, VPC-Endpunkten und Integration mit AWS Identity and Access Management (IAM) für feinkörnige Zugriffskontrolle.

Nova 2 Sonic enthält integrierte Sicherheitskontrollen zur Förderung einer verantwortungsvollen KI-Nutzung, mit Funktionen zur Inhaltsmoderation, die helfen, angemessene Ausgaben über ein breites Spektrum von Anwendungen hinweg zu gewährleisten.

Um mehr über Amazon Nova 2 Sonic zu erfahren und mit der Entwicklung zu beginnen, schauen Sie sich den Nova Sonic-Abschnitt des Amazon Nova User Guide für detaillierte Implementierungsanleitungen an.

— Danilo