Amazon Web Services ブログ

AWS Elemental Inference でライブ動画をモバイルオーディエンス向けに変換

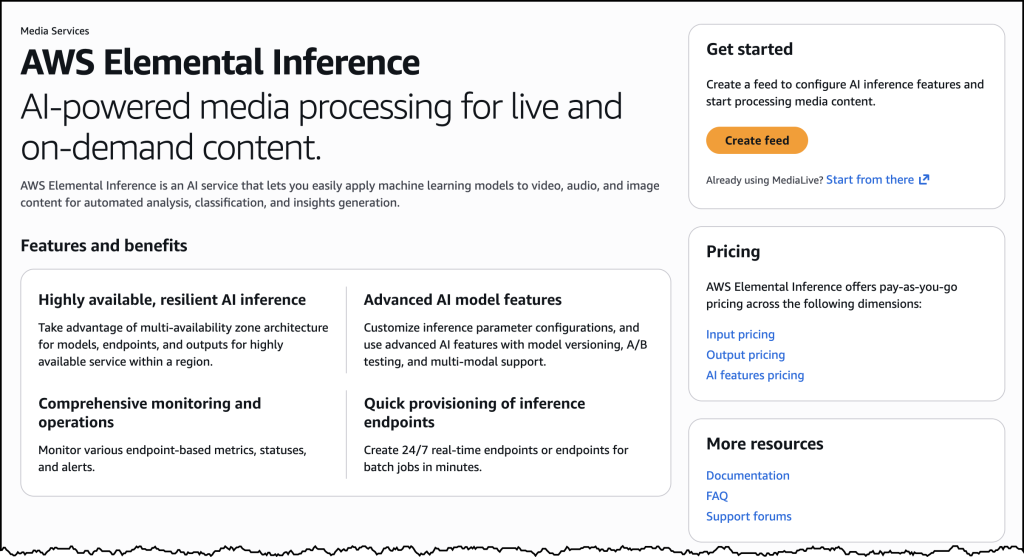

2026 年 2 月 24 日、AWS Elemental Inference が発表されました。このサービスは、オーディエンスを大規模にエンゲージするために動画のライブ配信とオンデマンド配信を自動的に変換し、最大限に高めるフルマネージド AI サービスです。リリース後は、動画コンテンツをモバイルプラットフォームとソーシャルプラットフォーム向けに最適化された縦型形式にリアルタイムで調整するために AWS Elemental Inference を使用できるようになります。

AWS Elemental Inference を使用すると、配信者やストリーマーは手作業によるポストプロダクション作業や AI の専門知識なしで TikTok、Instagram Reels、YouTube Shorts などのソーシャルプラットフォームとモバイルプラットフォームのオーディエンスにリーチできます。

今日の視聴者によるコンテンツの消費方法はほんの数年間で変化し、以前とは異なるものになっています。しかし、ほとんどの配信は従来の視聴方法向けの横型形式で制作されています。これらの配信をモバイルプラットフォーム向けの縦型形式に変換するには時間のかかる手動での編集が必要になるのが一般的であり、配信者とストリーマーが「バズる」瞬間を見逃し、視聴者をモバイルファーストな配信先に奪われる原因になっています。

試してみましょう

AWS Elemental Inference では、既存のワークフローに適合する柔軟なデプロイオプションが提供されています。スタンドアロンコンソールを使用してフィードを作成する、または AWS Elemental MediaLive コンソール経由で AWS Elemental Inference を設定することが可能です。

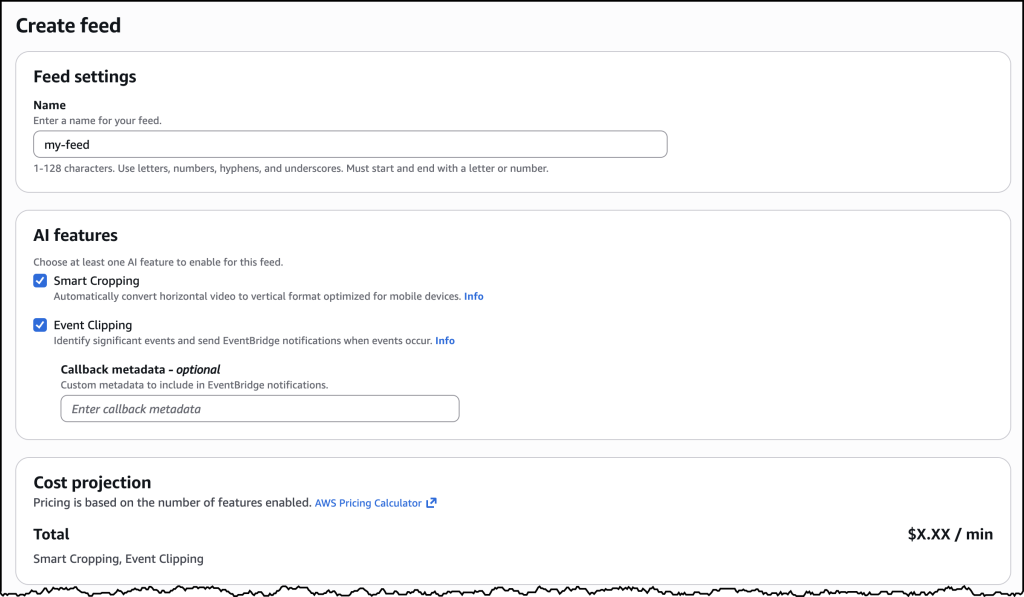

AWS Elemental Inference の使用を開始するには、AWS マネジメントコンソールに移動して、AWS Elemental Inference を選択します。ダッシュボードから [フィードを作成] を選択して、AI 駆動の動画処理のためのトップレベルリソースを確立します。フィードには機能設定が含まれています。作成は、CREATING 状態で始まり、準備が整うと AVAILABLE に移行します。

フィードが作成されたら、縦型の動画クロッピング用またはクリップ生成用に出力を設定できます。クロッピングの場合は、空のフィードから開始できます。AWS Elemental Inference は、動画の仕様に基づいてクロッピングパラメータを自動的に管理します。クリップ生成の場合は、[出力を追加] を選択し、名前 (「highlight-clips」など) を入力してから、出力タイプに [クリッピング] を選択してステータスを [有効] に設定します。

このスタンドアロンインターフェイスは、AI 駆動の動画変換を設定して管理するための効率的なエクスペリエンスを提供するため、縦型動画の作成やクリップ生成を簡単に開始できます。

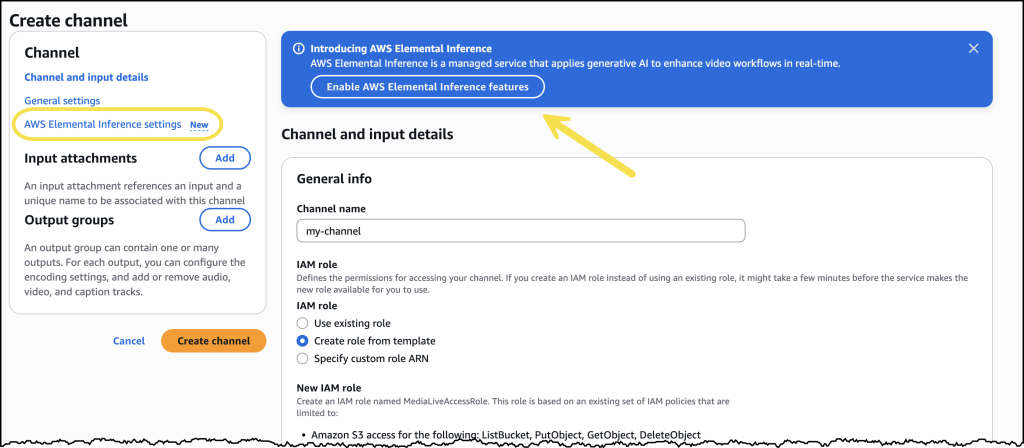

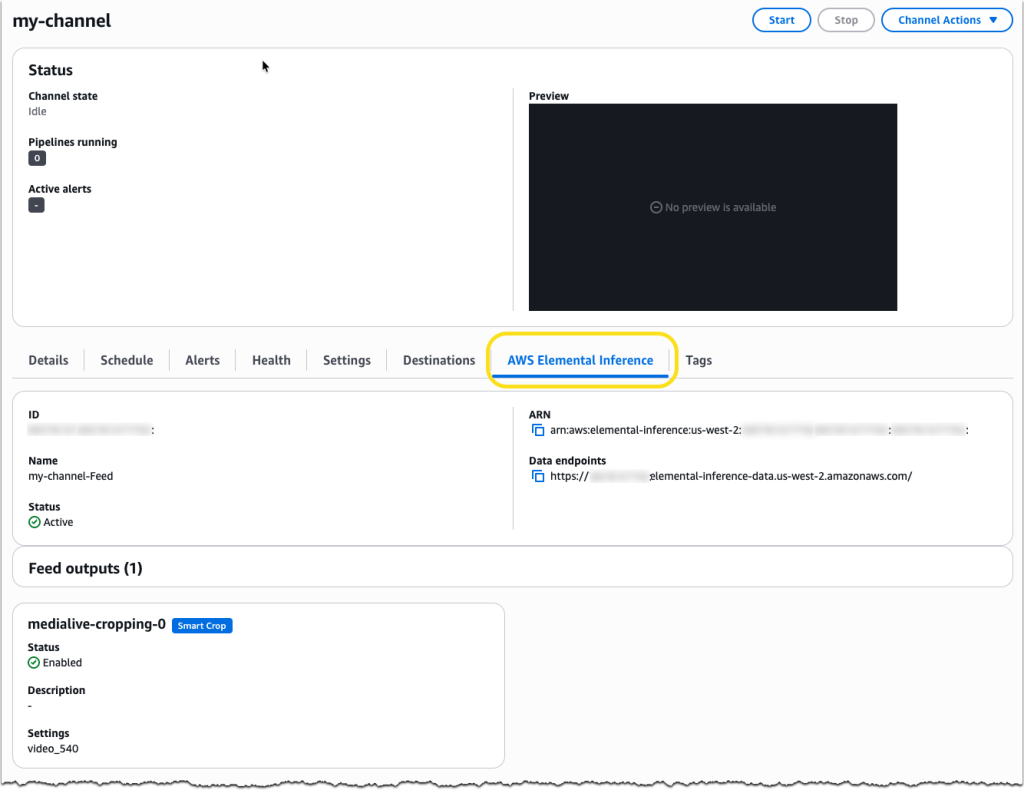

別の方法として、AWS Elemental MediaLive チャネル設定内で AWS Elemental Inference を直接有効にすることもできます。この統合されたアプローチを使用して既存のライブ動画ワークフローに AI 機能を追加でき、アーキテクチャを変更する必要はありません。チャンネル設定の一部として必要な機能を有効にすると、AWS Elemental Inference が動画エンコーディングと並行して動作します。

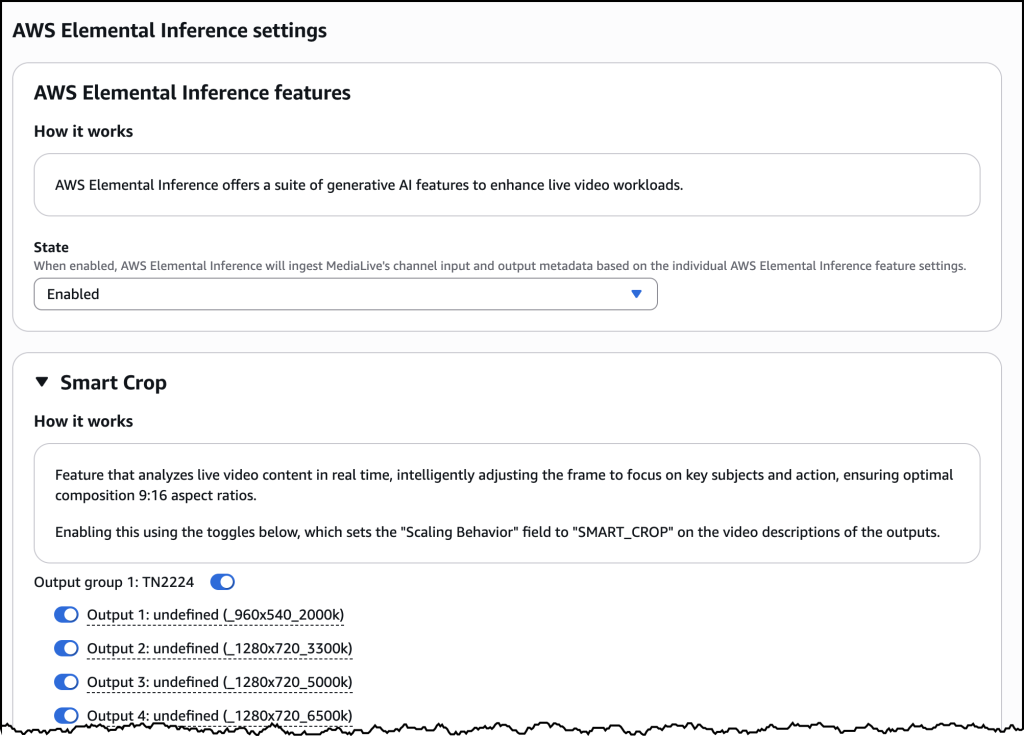

有効にした後は、[出力グループ] 内にあるさまざまな解像度仕様の出力で [スマートクロップ] を設定できます。

AWS Elemental MediaLive のチャンネル詳細ページには、専用の AWS Elemental Inference タブが追加されています。このタブは、AI 駆動の動画変換設定の一元的なビューを提供するもので、サービスの Amazon リソースネーム (ARN)、データエンドポイントに加えて、有効化されている機能 (スマートクロップなど) と、それらの現在の運用ステータスといったフィード出力の詳細が表示されます。

AWS Elemental Inference の仕組み

このサービスは、動画をリアルタイムで分析し、適切な最適化を適切なタイミングで自動的に適用するエージェンティック AI アプリケーションを使用しています。縦型動画クロッピングとクリップ生成の検出は個別に行われ、人間の介入を必要としないマルチステップ変換を実行して価値を引き出します。

AWS Elemental Inference は動画を分析して AI 機能を自動的に適用するため、ヒューマンインザループプロンプティングは必要ありません。ユーザーが高品質動画の制作に集中している間にコンテンツを自律的に最適化し、オーディエンス向けにパーソナライズされたコンテンツエクスペリエンスを創り出します。

AWS Elemental Inference はライブ動画と並行して AI 機能を適用するため、従来のポストプロセッシングアプローチで発生する数分間のレイテンシーが 6~10 秒に短縮されます。この「一度処理してあらゆる所で最適化」する手法では、同じ動画ストリーム上で複数の AI 機能が同時に実行されるため、機能ごとにコンテンツを再処理する必要がなくなります。

AWS Elemental Inference は AWS Elemental MediaLive とシームレスに統合されるので、既存の動画アーキテクチャを変更しなくても AI 機能を有効化できます。AWS Elemental Inference は、自動的に更新および最適化されるフルマネージド型の基盤モデル (FM) を使用していることから、専任の AI チームや専門知識は必要ありません。

リリース時の主要機能

AWS Elemental Inference のリリース時には、以下の主要機能をご利用いただけます。

- 縦型動画の作成 – AI 駆動のクロッピングが、横型配信をソーシャルプラットフォームとモバイルプラットフォーム向けに最適化された縦型形式 (アスペクト比 9:16) にインテリジェントに変換します。被写体を追跡し、主要アクションを常に可視化する AWS Elemental Inference は、配信品質を維持しながら、コンテンツをモバイル視聴用に自動的に再フォーマットします。

- 高度なメタデータ分析を用いたクリップ生成 – ライブコンテンツからクリップを自動的に検出および抽出して、リアルタイム配信のための特別な瞬間を際立たせます。ライブ配信の場合は、サッカーやバスケットボール試合の勝敗を決めるプレーを特定するという意味になります。このため、手作業による編集が数時間から数分に短縮されます。

今後もこの分野にご注目ください。AWS Elemental のコアサービスとのより緊密な統合や、お客様が動画コンテンツを収益化するために役立つ機能など、2026 年全体を通じてさらに多くの機能が導入される予定です。

今すぐご利用いただけます

AWS Elemental Inference は、2026 年 2 月 24 日から米国東部 (バージニア北部)、米国西部 (オレゴン)、欧州 (アイルランド)、アジアパシフィック (ムンバイ) の 4 つの AWS リージョンでご利用いただけます。AWS Elemental Inference は、AWS Elemental MediaLive コンソールから有効にする、または AWS Elemental MediaLive API を使用してワークフローに統合することができます。

従量制料金になっているため、お支払いいただくのは使用する機能と処理する動画の料金のみであり、初期費用や契約は必要ありません。つまり、ピークイベント中はスケールし、閑散期にはコストを最適化できます。

AWS Elemental Inference の詳細については、AWS Elemental Inference 製品ページをご覧ください。技術的な実装の詳細については、AWS Elemental Inference ドキュメントを参照してください。

原文はこちらです。