AWS 기술 블로그

Category: Artificial Intelligence

LG유플러스, Bedrock AgentCore를 활용한 손쉬운 클라우드 Agent 구현 사례

UCMP 소개 오늘날 대부분의 기업들은 AWS, GCP, Azure 등 다양한 클라우드 환경을 활용해 서비스를 개발하고 있습니다. 하지만 클라우드 사업자마다 계정 구조와 운영 정책이 달라 사용자 입장에서는 환경마다 서로 다른 방식으로 관리해야 하는 불편함이 있습니다. 이러한 문제를 해결하고 일관된 사용자 경험으로 클라우드를 운영할 수 있도록 LG유플러스는 자체 클라우드 관리 플랫폼 UCMP(Uplus Cloud Management Platform)를 구축해 멀티 […]

Amazon SageMaker HyperPod의 오토스케일링 알아보기

이 글은 Artificial Intelligence 블로그에 게시된 글 (Introducing auto scaling on Amazon SageMaker HyperPod)을 한국어로 번역 및 편집하였습니다. 2025년 8월에 Amazon SageMaker HyperPod가 Karpenter를 통한 관리형 노드 오토스케일링 지원하기 시작했습니다. 이를 통해 추론 및 학습 요구 사항에 맞춰 SageMaker HyperPod 클러스터를 효율적으로 확장할 수 있습니다. 실시간 추론 워크로드는 예측 불가능한 트래픽 패턴에 대응하고 서비스 수준 계약(SLA)을 유지하기 […]

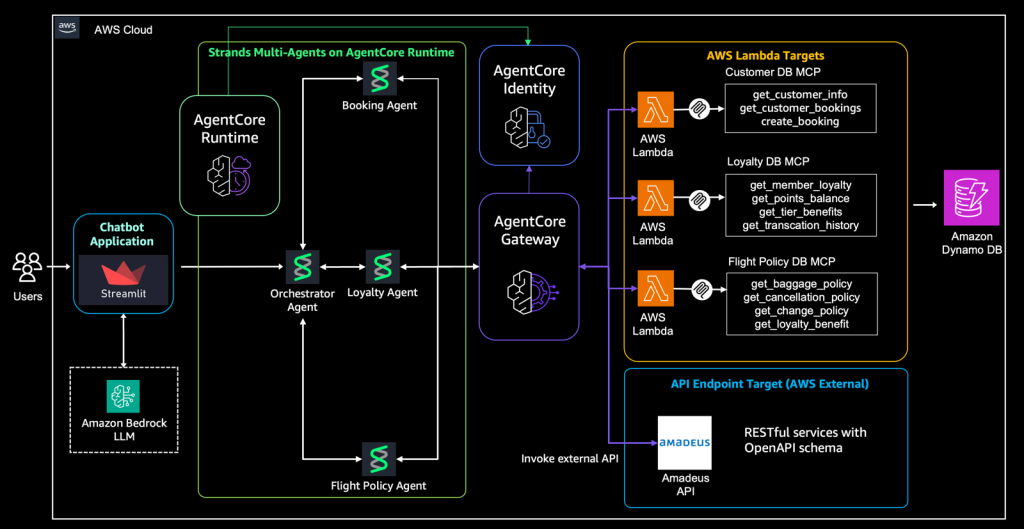

Amazon Bedrock AgentCore를 활용한 멀티에이전트 운영과 접근제어

AI 에이전트를 처음 구축할 때 가장 단순한 접근 방식은 하나의 에이전트가 외부 서비스(API, MCP)를 직접 호출하도록 구성하는 것 입니다. 이러한 구조는 초기 PoC 단계에서는 구현이 간단하고, 빠르게 아이디어를 검증하는 데 효과적입니다. 그러나 에이전트 기반 시스템을 엔터프라이즈 환경으로 확장하기 시작하면, 이러한 접근 방식은 곧 한계에 부딪히게 됩니다. 에이전트의 수가 증가하고 외부 API, MCP 내부 서비스가 지속적으로 […]

Agentic AI로 구현하는 대화형 대기오염·기후변화 예측 애플리케이션 구축

들어가며 복잡한 대시보드, 정말 활용되고 있을까? 많은 기업과 연구기관이 데이터 기반 의사결정을 위해 정교한 대시보드를 구축합니다. 하지만 실제 현장에서는 이러한 대시보드가 제대로 활용되지 못하는 경우가 많습니다. 수십 개의 파라미터를 조정해야 하는 복잡한 UI, 전문 용어로 가득한 입력 필드, 그리고 “만약 이렇게 하면 어떻게 될까?”라는 간단한 질문에도 많은 시간이 소요되는 구조 때문입니다. 특히 시뮬레이션 기반 대시보드의 […]

AWS Transform for SQL Server: SQL Server를 Aurora PostgreSQL로 .NET 코드와 함께 현대화

윈도우 기반의 환경에서 .NET 코드와 SQL Server는 업무용 애플리케이션으로 널리 사용되는 패턴입니다. 클라우드 환경이 인프라의 변화를 가져온 이후, 상업용 소프트웨어에 대한 오픈 소스의 대체가 용이해짐에 따라 윈도우 기반에서 리눅스 기반으로 변경하거나 데이터베이스 역시 PostgreSQL과 같은 오픈소스 데이터베이스로의 전환을 원하는 것은 라이선스 비용 절감의 측면에서 더 이상 미룰 수 없는 작업이기도 합니다. 하지만, 데이터베이스를 담당하는 부서와 […]

Nota AI가 제안하는 AWS Inferentia에서 다양한 LLM 모델 양자화 최적화기법 사용하기

Nota AI는 인공지능(AI, Artificial Intelligence) 모델의 경량화 및 최적화 기술을 전문적으로 연구·개발하는 기업입니다. 인공지능 모델을 분석해 특정 하드웨어의 호환성을 지원하고 하드웨어의 특성에 맞게 모델을 변경하여 추론 성능 및 메모리 효율성을 극대화하는 자사 플랫폼인 NetsPresso를 기반으로 모바일, 자동차, 로보틱스, 스마트시티 등 자원이 제한된 다양한 산업군에 고성능 AI 솔루션을 제공합니다. 이번 포스팅에서는, AWS Inferentia와Trainium에 호환되는 LLM 모델에 […]

교촌에프앤비의 AWS Transform을 이용한 국내 최초의 VMware 마이그레이션 사례

Agentic AI 기반 자동화로 컨설팅 파트너 없이 성공한 교촌에프앤비 사례 회사소개 교촌에프앤비는 1991년 창립 이래 대한민국 치킨 프랜차이즈 업계를 선도해온 기업입니다. ‘교촌치킨’이라는 대표 브랜드를 통해 전국 1,000여 개 매장을 운영하며, 최근에는 해외 시장 진출에도 적극적으로 나서고 있습니다. 교촌에프앤비는 디지털 혁신을 통한 고객 경험 향상과 운영 효율성 제고를 위해 클라우드 전환을 추진해왔습니다. 배경 및 과제 교촌에프앤비는 […]

Agentic AI 부터 Physical AI 까지: Bedrock, MCP, AWS IoT로 구축하는 자율 산업 안전 로봇

1. 서론: Physical AI – 디지털 지능과 물리적 행동의 융합 1.1 배경 최근에는 LLM과 멀티모달 모델이 발전하면서 단순 자동화를 넘어 스스로 계획하고 판단하고 실세계에 직접 작용하는 Agentic AI와 디지털 세계를 넘어 물리적 세계와 상호작용하는 Physical AI의 필요성이 높아지고 있습니다. 지금까지 우리가 경험한 AI 시스템은 대부분 디지털 환경 내에서만 작동했습니다. 챗봇과 대화하고, 이미지를 생성하고, 문서를 요약하는 […]

마이다스인의 플랫폼 혁신 여정, Part2: Kiro를 활용한 IDP 구축

마이다스인은 2,100여 고객사에 AI 기반 채용 플랫폼을 제공하는 대한민국 대표 HR 테크 기업입니다. 이전 블로그 포스트를 통해 AI 관련된 기능 추가와 더불어 복잡해지는 서비스 구조와 더불어 매년 수십만 명이 동시 접속하는 대규모 채용 시즌마다 증가하는 트래픽을 효과적으로 처리하기 위해 기존 Amazon ECS 기반의 인프라를 Amazon EKS 기반으로 플랫폼 전환 여정을 소개했습니다. 이번 블로그 포스트에서는 플랫폼 […]

AWS re:Invent 2025 요약: 자동차 및 제조업 하이라이트

본 블로그는 Emily O’Kelly와 Andreas Bogner, Ali Zagros, Chandana Keswarkar가 작성한 블로그를 번역, 편집하였습니다. Amazon Web Services re:Invent 2025가 12월 5일 라스베이거스에서 성공적으로 마무리되었으며, 63,000명 이상의 현장 참석자와 200만 명 이상의 라이브스트림 시청자가 함께했습니다. 5일간의 학습과 네트워킹 기간 동안 전 세계 비즈니스 리더들은 클라우드와 AI 기술을 활용하여 경쟁 우위를 확보하고 고객 경험을 향상시키는 방법을 탐구했습니다. […]