Amazon Web Services ブログ

EngineLab AI: AWSで実現するスタジオとクリエイター向け本番制作AI環境

本記事は 2026 年 4 月 19 日 に公開された「EngineLab AI: Production-ready AI for studios and creators on AWS」を翻訳したものです。

AI ツールは制作ワークフローの効率化を約束する一方で、スタジオは難しいジレンマを抱えています。AIツールを利用するためにはセキュリティ、知的財産 (IP) 保護、制作の安定性に関する現実的な懸念を伴うためです。本記事では、そんな制作現場でのトレードオフを解消するソリューションをご紹介します。

ComfyUI のような AI ツールを活用すると、モデル、処理ツール、クリエイティブな操作をつなぎ合わせ、本番レベルのワークフローを視覚的に設計・構築できます。ComfyUI は AI コンテンツ生成向けのオープンソースなノードベースのインターフェースです。しかし、制作ワークフローの加速や効率化を謳う新興技術にありがちなように、リスクも生じます。急速に進化する AI の世界では、標準化、パイプライン統合、アプリケーションの安定性といった課題が生まれます。セキュリティ面の課題はさらに複雑です。使用するモデルの出所を把握して法的要件に対応しつつ、AI ワークフローを流れる IP を厳格なセキュリティ基準に従って保護する必要があります。モデルやアーティファクトを適切に審査・承認しなければ、未承認の、場合によっては悪意あるツールやコードが作業環境に持ち込まれるリスクがあります。

これまでクリエイターは、AI を本番環境に導入するにあたり、こうしたメリットとリスクのバランスを取ることを余儀なくされてきました。

AWS のメディア・エンターテインメント専門パートナーである EngineLab は、EngineLab AI というマネージドデプロイメントプラットフォームを提供開始しました。AWS インフラ上に構築され、ComfyUI などの AI アプリを安定した、セキュアな本番対応ツールセットとしてパッケージ化しています。メディア・エンターテインメント業界に向けに設計されており、ワークフローの特性を理解したうえで、ワークフローを構築する上級ユーザーから定型プロセスを活用したい一般ユーザーまで、チームのすべてのアーティストが強力な AI 機能を使えるようになります。

「スタジオは AI を本番環境で使いたいと言っています。しかし、現状の不安定さやリスクは受け入れられない。私たちは、その障壁を取り除くプラットフォームを構築しています。業界が求めるセキュリティとコントロールを備えた形で、AI ツールをスタジオのワークフローに組み込んでいきます。」 – Sam Reid、EngineLab 共同創業者兼 CEO

本記事では、EngineLab AI でこれらの課題を解決する方法を紹介します。具体的には、完全なデータ主権を確保するために顧客の AWS アカウントへ直接デプロイすること、最適な可用性とコストを実現するために AWS が提供するグローバル GPU リソースを活用すること、そしてワークフローに必要なクリエイティブな柔軟性を損なわずに IP を保護するセキュリティ制御を統合することです。

安定したスケーラブルな AI ワークフローの実現

スタジオにとって、高性能 GPU ハードウェアの調達はますます困難で高コストになっています。部品不足、価格上昇、オンプレミスインフラの維持管理負担により、AI ワークロードが必要とする GPU 容量の確保・維持は難しくなる一方です。ハードウェアを調達できたとしても、多様なプロジェクトやチームにまたがって安定的で効率的に割り当てるという課題が残ります。

ComfyUI の Web ベースアーキテクチャは、従来のリモートデスクトップソリューションに対して大きな優位性を持ちます。一般的なクラウドワークステーションは Virtual Desktop Infrastructure セッションを使い、キーボード、マウス、Wacom タブレットなどの操作を含むデスクトップ画面をリモートからローカルクライアントへストリーミングします。一方 ComfyUI はローカルの Web ブラウザ上で動作し、処理負荷の高い計算はサーバー側で実行されます。ユーザーインターフェースがレイテンシの影響を受けないため、重要なアーキテクチャ上の利点が生まれます。コンピューティングリソースをレイテンシを気にせずリモートでプロビジョニングできるのです。

EngineLab AI はこの柔軟性を活かし、AWS グローバルインフラを動的に活用します。利用可能な Amazon Elastic Compute Cloud (Amazon EC2) キャパシティ (オンデマンドの GPU インスタンスを提供する AWS のスケーラブルな仮想サーバーサービス) を持つ AWS リージョン (地理的に独立した AWS データセンターのクラスター) を活用します。これにより EngineLab AI は、Blackwell、Ada Lovelace、Ampere など多様な NVIDIA GPU アーキテクチャを搭載した GPU 搭載 Amazon EC2 インスタンスタイプのグローバルプールにアクセスできます。vCPU 数やメモリ構成も幅広く、複数リージョンにまたがって可用性を高めることで、固定のローカルハードウェアをめぐる競合を減らせます。Amazon EC2 インスタンスを活用することで、AI ワークフローの固定コストを削減し、必要なときに必要なだけ GPU リソースをオンデマンドで利用できます。

また、スタジオはタスクに応じてコンピューティングリソースを柔軟に選べます。クラウドインフラが各ジョブに適切なリソースを動的に割り当てられる環境では、すべてのアーティストがデスクの下に高性能グラフィックカードを搭載した機器を置く必要はありません。GPU リソースを複数ユーザーで分割することでコストをさらに削減でき、オンプレミスハードウェアの固定費や運用負担なしに、スケールした GPU コンピューティングへの安定したアクセスを実現します。

EngineLab AI: スタジオとクリエイター向けマネージドプラットフォーム

EngineLab は AWS グローバルインフラを基盤に、メディア・エンターテインメント向けに一から設計されたマネージドプラットフォームを開発しました。AI ツールを本番環境に導入する際にスタジオが直面する固有の課題に対応しています。

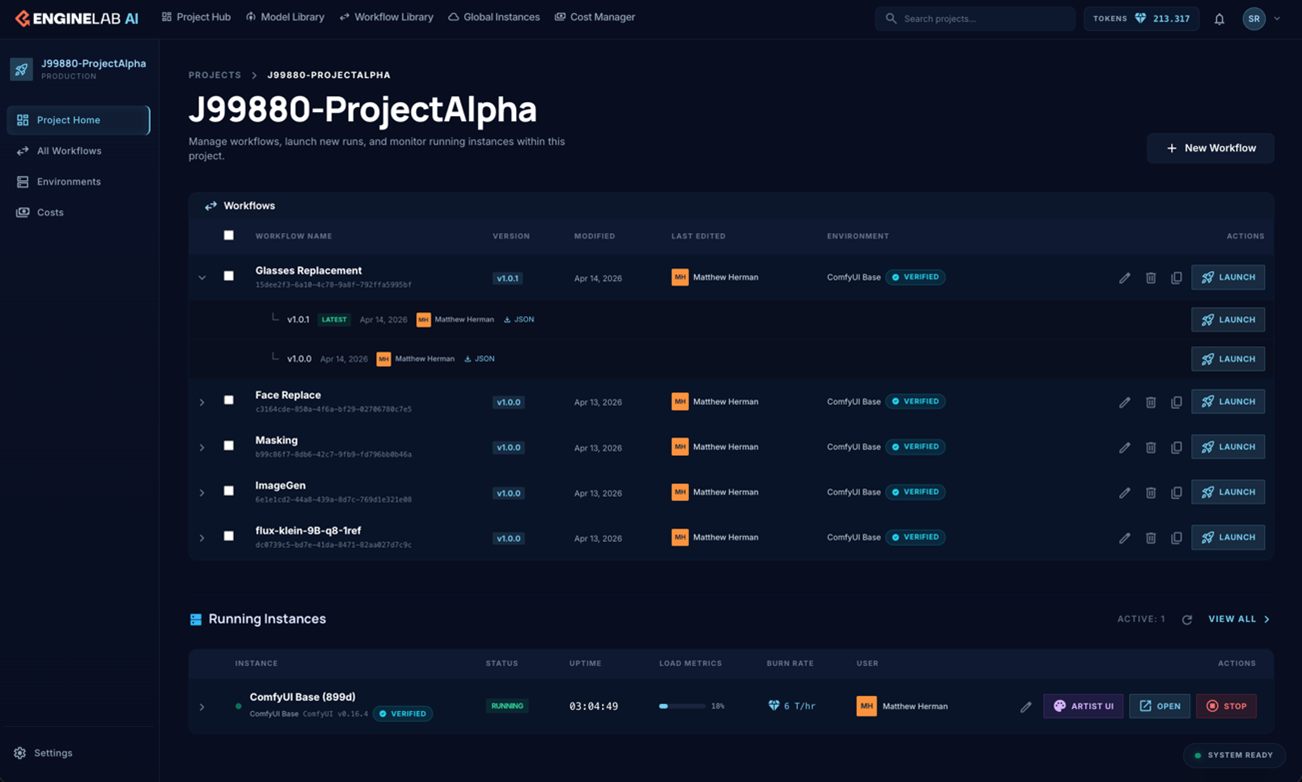

図 1 に示すプロジェクト管理インターフェースでは、ワークフローの状況を一元的に把握できます。管理者はここからアクティブなワークフローの追跡、リソース使用状況の監視、アーティストのアクセス管理を行えます。

図 1: EngineLab AI のプロジェクト管理インターフェース。管理者によるワークフローの追跡、リソースの監視、アーティストのアクセス管理の様子を示しています。

複雑な操作なしに即座にセッションを開始

アーティストが AI ツールを使うためにクラウドインフラを理解する必要はありません。EngineLab AI では、アプリを選択して起動するだけで AI アプリが使えます。適切なコンピューティングのプロビジョニング、環境の読み込み、安定したセッションの提供まで、すべてが自動で処理されます。セットアップも、トラブルシューティングも、待ち時間も不要です。スタジオはプロジェクト単位で作業を管理し、アーティストは必要なアプリをその中で起動するだけです。締め切りを抱えた現場では、セッションが起動しなかったり途中で止まったりすることは許されません。一貫性と信頼性のある操作性が重要です。

Artist UI: すべてのアーティストが使える高度なワークフロー

どのスタジオにも、複雑なノードグラフを使って高度なワークフローを構築する ComfyUI の上級ユーザーがいます。しかし規模が大きくなると、多くのアーティストは技術的な専門知識を習得することなく、そのワークフローの恩恵を受けたいと考えます。Artist UI はその橋渡しをします。入力、プロンプト、出力といった基本的なエンドポイントだけを公開することで、アーティストは画像をアップロードし、やりたいことを記述するだけで結果を得られます。ノードグラフを操作しなくても、裏側では高度なワークフローが動いています。

これはスタジオにとって重要な IP 保護の課題も解決します。カスタムワークフローは実質的な競争優位性を持ちますが、ワークフローとユーザーの間に何も介在しなければ、フリーランサーが次の仕事先に持ち出すことを防ぐ手段がありません。Artist UI が境界として機能することで、内部の実装を公開せずにスタジオ全体がその機能を活用できます。

データ主権: 安心のセキュリティ

本ソリューションは顧客自身の AWS アカウントおよび環境にのみデプロイされ、包括的なコントロールとデータ主権を提供します。顧客データはトレーニングに使用されません。スタジオが制作したものはスタジオのものであり、その利用方法に曖昧さはありません。多くのプラットフォームがデータの取り扱いについて意図的に曖昧な表現を使う中、EngineLab AI は意図的に明確な姿勢を取っています。また、コミュニティが開発した AI ワークフローを実行する際に生じるセキュリティリスク、たとえば未承認または悪意あるコードインジェクションから保護するよう設計されたコントロールも含まれています。厳格なデータ要件を持つ大手クライアントと仕事をするスタジオにとって、本番環境では不可欠な要件です。

モデルトレーニング: セキュアな環境と完全なコントロール

プラットフォームにはトレーニングアプリが含まれており、スタジオは独自のコンテンツを使ってファインチューニング済みの基盤モデルや、特定のパラメーターのみを変更することでスタイルのカスタマイズをより高速かつ低コストで実現する Low-Rank Adaptation (LoRA) をトレーニングできます。トレーニングはプラットフォーム環境内で実行されるため、トレーニングデータがプライベートアカウントの外に出ることはありません。トレーニング後、カスタムモデルは ComfyUI ワークフローから直接利用でき、モデルとその作成に使用したデータの両方をスタジオが完全に管理します。独自データが他所でのモデルトレーニングや競合他社の利益に使われるリスクを負わずに、カスタム AI モデルの力を活用したいスタジオの重要なニーズに応えます。

完全なコントロール: アクセス管理とプロベナンス

管理者は最小権限モデルによってプラットフォームをきめ細かく制御できます。ユーザーとリソースには各タスクの実行に必要な権限のみが付与され、上級ユーザーと管理者はモデルのアップロードと承認が可能な一方、一般ユーザーのアクセスは制限されます。ベンダー固有の承認もサポートしており、特定プロジェクトでは承認済みモデルのみを使用できます。これは厳格なコンプライアンス要件を持つクライアントと仕事をするスタジオにとって重要な要件です。包括的な監査証跡によりプロジェクトごとのモデル使用状況を追跡してクライアントへの報告やコンプライアンス検証に活用でき、プロベナンス追跡によってモデルの出所や組織全体での使用状況を正確に把握できます。

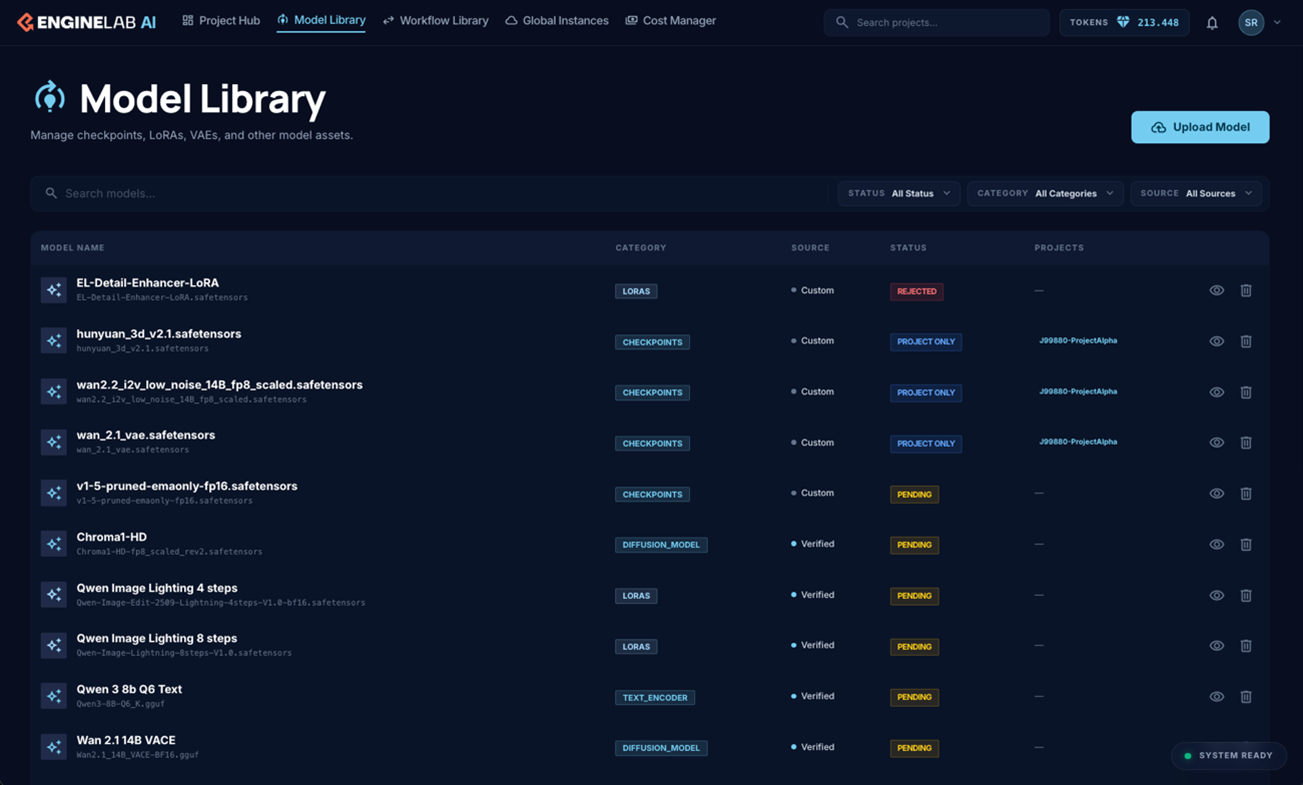

図 2 の AI Model Library インターフェースでは、モデルと LoRA の分類、承認、管理を一元的に行えます。

図 2: EngineLab AI の AI Model Library 管理ペインのスクリーンショット。

パイプライン統合: スタジオワークフロー全体へのコンピューティング提供

EngineLab は、深いパイプライン専門知識とハイエンドなクリエイティブワークフローの豊富な経験を持つチームをプラットフォームに結集しています。アーティストの時間が最も重要であるという認識のもと、チームは ComfyUI に関連する GPU および CPU コンピューティングを既存のレンダーファームワークフローへ直接統合する取り組みを進めています。これには、ワークフローの需要に応じてコンピューティングリソースを自動でスケールするフルマネージドのレンダーファームサービスである AWS Deadline Cloud を活用します。この統合により、ComfyUI のフロントエンドは軽量なマシンで動作しながら、重い GPU タスクをレンダーファームにオフロードでき、インターフェースと処理能力を切り離せます。EngineLab がツールを本番環境へ統合する方法を深く理解しているからこそ実現できる自然な発展であり、複雑な部分はプラットフォームが担うためスタジオが対処する必要はありません。

「プラットフォームの開発段階から EngineLab と協力してきました。社内にはすでに強力な ComfyUI の専門知識がありますが、クライアント業務に必要なコントロールとガバナンスを備えた、マネージドでセキュアな環境でスタジオ全体にスケールできることは、まさに私たちが求めていたものです。」 – Sean Costelloe、Selected Works マネージングディレクター

まとめ

EngineLab AI は ComfyUI を実験的なツールから本番対応プラットフォームへと変え、AI ツール導入時にスタジオが直面する重要な課題を解決します。スタジオの AWS アカウントへ直接デプロイすることで包括的なデータ主権とセキュリティを確保しながら、AWS が提供するグローバル GPU リソースを活用して最適な可用性と価格を実現します。スタジオは従来のアプローチのリスクやコストを負うことなく、本番対応の AI 機能を手に入れられます。クライアント業務に必要なコントロールを備えた安定したセキュアな AI 生成環境を、使い慣れたワークフローに統合して利用できます。

AWS インフラの詳細

EngineLab AI は、コンピューティング負荷の高いクリエイティブワークロード向けに実績ある AWS サービスを基盤としています。

- Amazon EC2 – AI およびレンダリングワークロード向け GPU インスタンスを備えたスケーラブルな仮想サーバー

- AWS Deadline Cloud – コンピューティングリソースのスケーリングに対応したマネージドレンダースケジューリングサービス

次のステップ

クリエイティブワークフローへのクラウドインフラ活用について詳しくは、AWS アカウントチームにお問い合わせいただくか、AWS for Media & Entertainment をご覧ください。

スタジオで AWS 上のセキュアでスケーラブルな AI ワークフローを活用する方法については、EngineLab AI をご覧ください。

参考リンク

AWS Media Services

AWS Media & Entertainment Blog (日本語)

AWS Media & Entertainment Blog (英語)

AWS のメディアチームの問い合わせ先: awsmedia@amazon.co.jp

※ 毎月のメルマガをはじめました。最新のニュースやイベント情報を発信していきます。購読希望は上記宛先にご連絡ください。

翻訳は Visual Compute SSA 森が担当しました。原文はこちらをご覧ください。