亚马逊AWS官方博客

Category: Industries

借助 AWS Elemental Inference 转变移动受众的直播体验

今天,我们宣布推出 AWS Elemental Inference。这是一项完全托管的 AI 服务,能够自动转换并最大程度地利用直播及点播视频广播,从而大规模吸引受众。在发布阶段,您可以借助 AWS Elemental Inference 实时将视频内容转换为适配移动和社交平台的竖版格式。

从代码到分子系列:一场由 AI 驱动的 EGFR 抑制剂发现之旅 — 深度融合 AWS Bedrock与 Claude Code/Claude Agent Skills,生命健康行业的科学活动探微

展示利用Amazon Bedrock及Claude Agent Skills(集成ChEMBL、RDKit、Datamol、DiffDock等工具),实现AI驱动的EGFR抑制剂发现全流程:从ChEMBL检索高活性化合物(IC50<50nM)、RDKit构效关系分析、Datamol生成优化类似物、DiffDock虚拟筛选准备,到PubMed/COSMIC挖掘耐药机制(如T790M、C797S)。完成生成可视化图表与综合报告,凸显AI加速药物研发潜力,同时理性指出数据质量、湿实验验证等局限性。

道通与亚马逊云科技联合推动充电运营全面进入智能化时代

本文介绍了道通科技(Autel)与亚马逊云科技(AWS)的深度合作实践。双方基于AWS云原生架构、Amazon Bedrock生成式AI能力及Strands Agents SDK,在道通CSMS平台上构建了业界首批落地的AI智能员工矩阵(AI Intelligence Employees)。

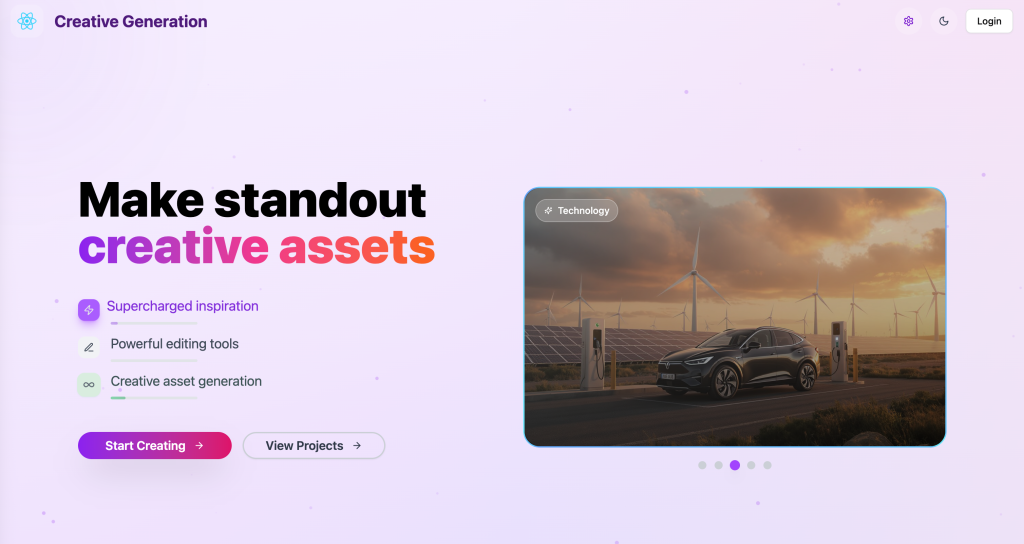

AI智能体赋能广告行业:创意素材生成解决方案实践

AI智能体正在重塑广告营销行业的创意制作流程,从传统的数周制作周期缩短到几分钟完成素材生成。通过智能体架构,我们可以将复杂的AI工具整合成易用的对话式界面,让更多企业能够快速采纳这些前沿技术。

从0到1:联想基于Strands Agent SDK的资源智能巡检Agent创新

联想公有云运维团队基于Strands Agent SDK构建了智能资源巡检系统,集成Amazon Bedrock、Aurora serverless,Opensearch等服务,通过Workflow模式实现多Agent协作,解决了传统人工巡检耗时费力、覆盖不全的问题,提升了运维效率和准确性。

推出适用于实时广告技术工作负载的 AWS RTB Fabric

今天,我们宣布推出 AWS RTB Fabric,这是一项专为实时竞价(RTB)广告工作负载而构建的完全托 […]

Amazon Bedrock助力飞书深诺电商广告分类

本文详细介绍了飞书深诺使用Amazon Bedrock的解决方案,进行电商广告分类的实践案例

利用AWS Bedrock构建智能报告生成Agent

本方案旨在借助 LLM 与 Agent构建智能ESG报告生成决方案,通过生成式AI技术帮助企业高效应对ESG报告编制的挑战。该方案采用Map-Reduce范式处理长文本生成限制,实施闭环质量控制流程确保报告质量,并利用向量数据库统一管理多来源参考资料。系统通过四个主要阶段运作:初始化与参数配置、数据输入与上下文构建、智能并行处理、以及报告整合输出,实现了高质量、符合多元国际标准的ESG报告自动化生成。

构建AI驱动的智能定价解决方案:新能源充电运营的数字化转型实践

随着全球电动汽车市场的快速发展,充电基础设施运营商面临着日益复杂的定价挑战。传统的静态定价模式已无法适应多变的 […]

亚马逊云科技 AD Insight Hub,全链路解决方案解决辅助驾驶开发过程中的数据挑战

智能驾驶加速演进,数据成为核心驱动力 当前,全球汽车行业正经历从“电动化” 向 “智能化” 的深度转型,辅助驾 […]