Amazon Web Services ブログ

週刊AWS – 2025/10/6週

新しいコンピュート最適化 EC2 C8i および C8i-flex インスタンスが一般提供開始、Amazon EKS が Kubernetes バージョン 1.34 をサポート、AWS Service Quotas の自動クォータ管理が GA、Amazon Q Developer に価格・コスト見積もり機能追加、新しい汎用 EC2 M8a インスタンス提供開始、Amazon DynamoDB が IPv6 をサポート、Amazon Quick Suite のエージェント型 AI ワークスペース提供開始等

2025 年 9 月の AWS Black Belt オンラインセミナー資料及び動画公開のご案内

2025 年 9 月に公開された AWS Black Belt オンラインセミナーの資料及び動画についてご案内させて頂きます。

動画はオンデマンドでご視聴いただけます。

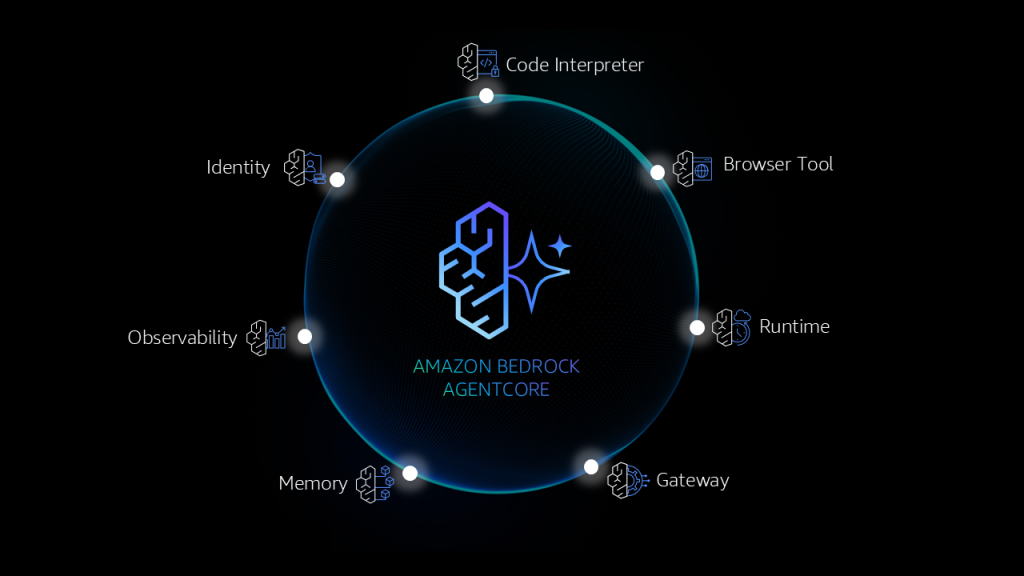

Amazon Bedrock AgentCore、東京を含むAWSリージョンで一般提供開始:AIエージェントを現実の世界へ

本記事は米国時間 10 月 13 日に公開された AWS エージェンティック AI 担当バイスプレジデント ス […]

週刊生成AI with AWS – 2025/10/6週

週刊生成AI with AWS, 充実の2025年10月6日週号 – 情報戦略テクノロジー社のAIエージェント秘書「パイオにゃん」で情報探索業務83%改善、第一三共社のAIエージェント統合型創薬基盤構築開始などの国内事例を紹介。Amazon Quick Suite への進化、Claude Sonnet 4.5 の登場、HealthData x Agent の発表など注目のブログ記事も多数。サービスアップデートでは Amazon Q Developer のコスト見積もり機能、Amazon Quick Suite のエージェンティックAI搭載ワークスペース、Service Quotas の自動管理機能の3件を紹介。

【開催報告】Amazon SageMaker Roadshow -Japan

シニア GTM アナリティクススペシャリストソリューションアーキテクトの大薗です。 2025 年 7 月 15 […]

コーエーテクモゲームス:AWSと歩むゲームサーバー開発研修の設計と実装

ゲーム業界は今、かつてない変革期を迎えています。モバイルゲームの普及、クロスプラットフォーム化、そしてメタバー […]

AWS IoT Greengrass nucleus lite – リソース制約のあるデバイスでエッジコンピューティングに革命を起こす

AWS IoT Greengrass は2020 年 12 月に V2 をリリースし、 nucleus として知られる Java エッジランタイムを導入しました。 2024 年 12 月のリリース 2.14.0 では、 C 言語で書かれた追加のエッジランタイムオプションである nucleus lite を追加しました。 AWS IoT Greengrass nucleus lite は、リソース制約のあるデバイスを対象とした軽量なオープンソースのエッジランタイムです。スマートホームハブ、スマートエネルギーメーター、スマートビークル、エッジ AI、ロボティクスなどの大量生産アプリケーション向けに、低コストのシングルボードコンピュータで AWS IoT Greengrass の機能を拡張できます。

このブログでは、2つのエッジランタイムオプションの利点を説明し、ユースケースに最適なオプションを選択するための指針を提供します。

ビジネスインテリジェンスの再解釈 : Amazon QuickSight から Amazon Quick Suite への進化

本記事では、Amazon QuickSight が Amazon Quick Suite へと進化することをお知らせします。これは、組織の全メンバーが包括的なビジネスインサイトを容易に活用できるようになるための大きな前進です。この進化により、Quick Research、Quick Flows、Quick Automate、Quick Index など、複数の AI 搭載機能が導入されます。これらの機能は、エンタープライズレベルのセキュリティとガバナンスを維持しながら、Quick chat を通じて利用できます。

新しい汎用 Amazon EC2 M8a インスタンスが利用可能になりました

10 月 8 日は、汎用 M インスタンスファミリーに最近追加された Amazon Elastic Compu […]

新しいコンピューティング最適化 Amazon EC2 C8i および C8i-flex インスタンスのご紹介

Amazon Elastic Compute Cloud (Amazon EC2) メモリ最適化 R8i およ […]