- IA generativa

- Amazon Bedrock

- Guardrails

Amazon Bedrock Guardrails

Implemente proteções personalizadas de acordo com os requisitos das aplicações e das políticas de IA responsáveis

Desenvolvimento de aplicações de IA responsável com o Guardrails

O Amazon Bedrock Guardrails disponibiliza medidas de proteção configuráveis para auxiliar no desenvolvimento seguro de aplicações de IA generativa em grande escala. Com uma abordagem consistente e padrão usada em uma ampla variedade de modelos de base (FMs), incluindo FMs compatíveis com o Amazon Bedrock, modelos ajustados e modelos hospedados fora do Amazon Bedrock, o Guardrails oferece proteções de segurança líderes do setor:

- Utiliza raciocínio automatizado para minimizar alucinações de IA, identificando respostas corretas do modelo com até 99% de precisão: a primeira e única medida de proteção de IA generativa a fazer isso.

- Proteções de conteúdo de texto e imagem líderes do setor, ajudando os clientes a bloquear até 88% do conteúdo multimodal prejudicial

Remitly transforma o suporte ao cliente com velocidade e confiança usando Amazon Bedrock

KONE potencializa o serviço de campo de IA responsável com o Amazon Bedrock

Nível consistente de segurança em todas as aplicações e modelos de IA generativa

O Guardrails é o único recurso de IA responsável de um grande provedor de nuvem que ajuda você a criar e personalizar proteções de segurança, privacidade e veracidade para seus aplicativos generativos de IA. Ele avalia as entradas do usuário e as respostas do modelo com base em políticas específicas para cada caso de uso, fornecendo uma camada adicional de proteções além do que está disponível nativamente. As salvaguardas do Guardrails podem ser aplicadas a modelos hospedados no Amazon Bedrock ou a quaisquer modelos de terceiros (como OpenAI e Google Gemini) por meio da API ApplyGuardrail. Você também pode usar o Guardrails com uma estrutura de agentes, como o Strands Agents, incluindo agentes implantados usando o Amazon Bedrock AgentCore. Ela ajuda a filtrar alucinações e melhorar a precisão factual por meio de verificações contextuais em relação ao conteúdo RAG e verificações de raciocínio automatizado para fornecer respostas comprovadamente confiáveis. Consulte o guia passo a passo para implementar o Amazon Bedrock Guardrails e obter mais informações.

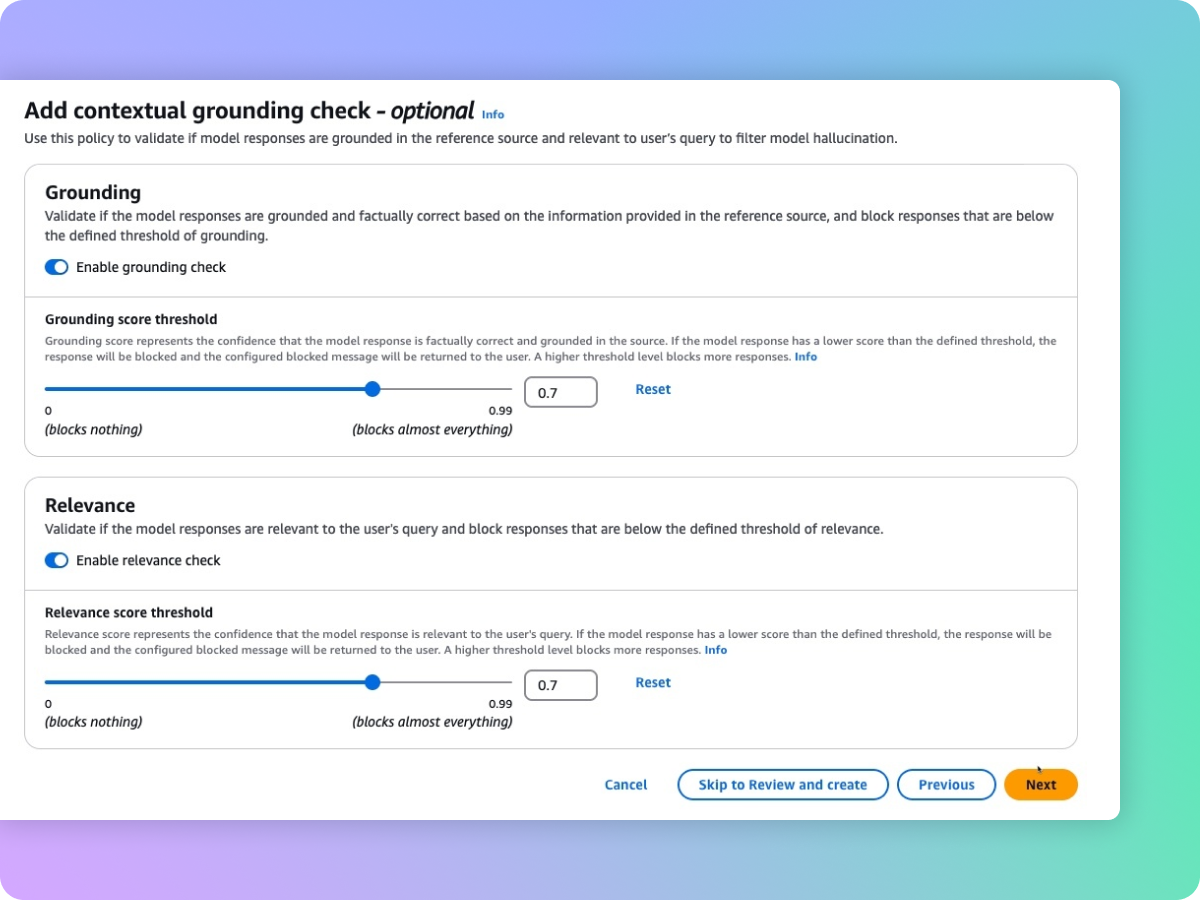

Detecte alucinações nas respostas do modelo usando verificações de fundamento contextual

É necessário que os clientes implantem aplicações de IA generativa precisas e confiáveis para preservar e aumentar a confiança dos usuários. No entanto, os modelos de base (FMs) podem gerar informações incorretas devido a alucinações, desvio das informações originais, confusão por conta de diversos dados ou invenção de novas informações. O Guardrails fornece suporte a verificações de fundamentação contextual para ajudar a detectar e filtrar alucinações, caso as respostas não estejam baseadas nas informações originais (por exemplo, informações factualmente imprecisas ou novas) e sejam irrelevantes para a consulta ou para a instrução do usuário. As verificações de fundamentação contextual podem ajudar a detectar alucinações em aplicações de RAG, resumos e conversação, em que as informações de origem podem ser usadas como referência para validar a resposta do modelo.

As verificações de raciocínio automatizadas identificam respostas corretas do modelo com até 99% de precisão para minimizar alucinações

As verificações com raciocínio automatizado no Amazon Bedrock Guardrails são a primeira e única proteção de IA generativa que ajuda a evitar erros factuais decorrentes de alucinações ao usar um raciocínio logicamente preciso e verificável, que explica a razão pela qual as respostas estão corretas. O raciocínio automatizado ajuda a mitigar as alucinações ao usar técnicas matemáticas confiáveis para validar, corrigir e explicar logicamente as informações geradas, garantindo que os resultados estejam alinhados com fatos conhecidos e não sejam baseados em dados fabricados ou inconsistentes. Os desenvolvedores podem criar uma política de raciocínio automatizado ao fazer o upload de um documento existente que defina o espaço de soluções adequado, como uma diretriz de RH ou um manual operacional. Em seguida, o Amazon Bedrock cria uma política de raciocínio automatizado e orienta os usuários durante os testes e o aprimoramento da política. Para validar o conteúdo gerado de acordo com uma política de raciocínio automatizado, os usuários precisam habilitar a política no Guardrails e configurá-lo com uma lista de políticas de raciocínio automatizado. Esse processo de verificação algorítmica baseado em lógica garante que as informações geradas por um modelo estejam alinhadas com fatos conhecidos e não sejam baseadas em dados fabricados ou inconsistentes. Essas verificações fornecem respostas comprovadamente verdadeiras de modelos de IA generativa, possibilitando que os fornecedores de software aumentem a confiabilidade das aplicações para casos de uso em setores de RH, finanças, jurídico, conformidade, entre outros. Confira os tutoriais em vídeo para saber mais.

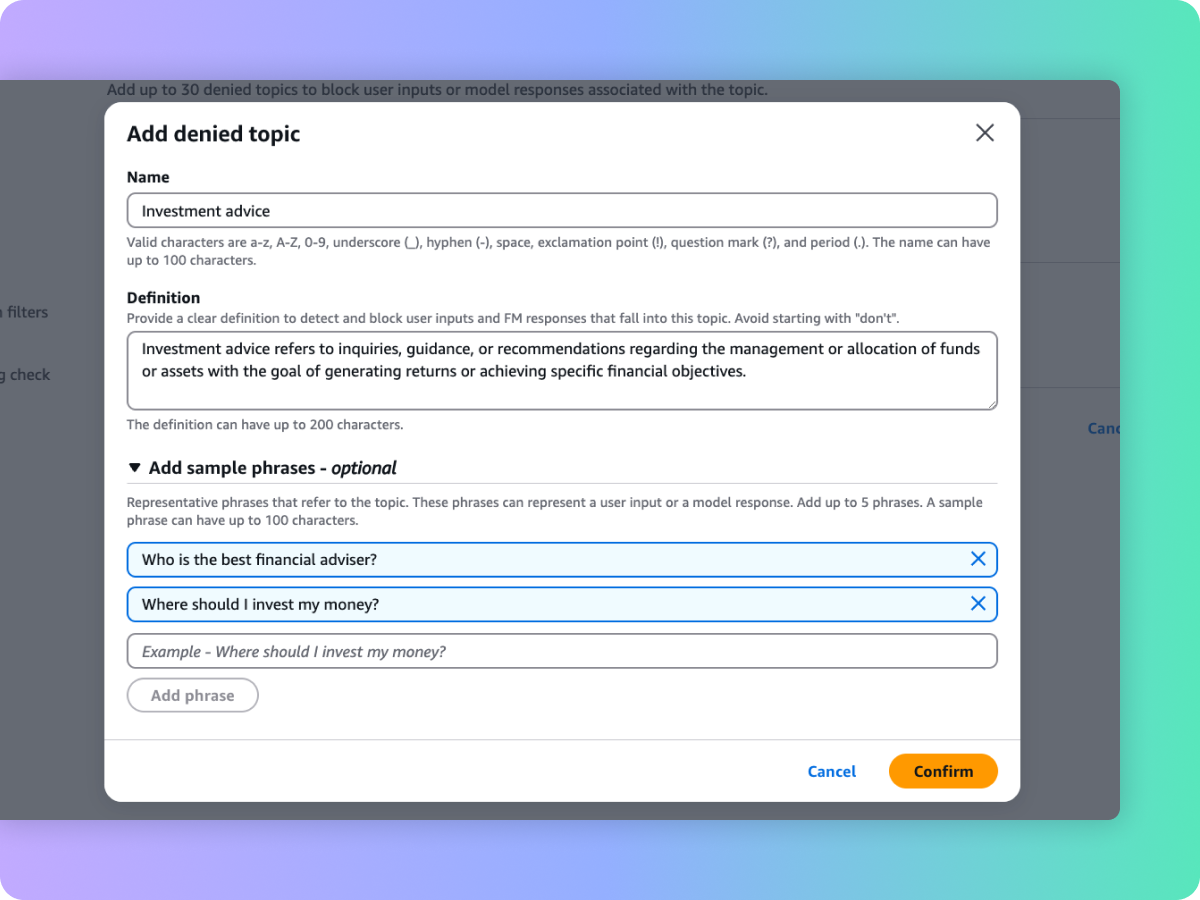

Bloqueio de tópicos indesejáveis em aplicações de IA generativa

Os líderes organizacionais reconhecem a necessidade de gerenciar as interações nas aplicações de IA generativa para proporcionar uma experiência de usuário relevante e segura. Eles desejam personalizar as interações de forma mais aprofundada, garantindo que permaneçam concentradas em tópicos relevantes para os negócios e em conformidade com as políticas da empresa. Com uma breve descrição em linguagem natural, o Guardrails ajuda a definir um conjunto de tópicos a serem evitados no âmbito da sua aplicação. O Guardrails ajuda a detectar e bloquear entradas de usuários e respostas de FM que pertencem aos tópicos restritos. Por exemplo, um assistente de banco pode ser projetado para evitar tópicos relacionados à consultoria de investimentos.

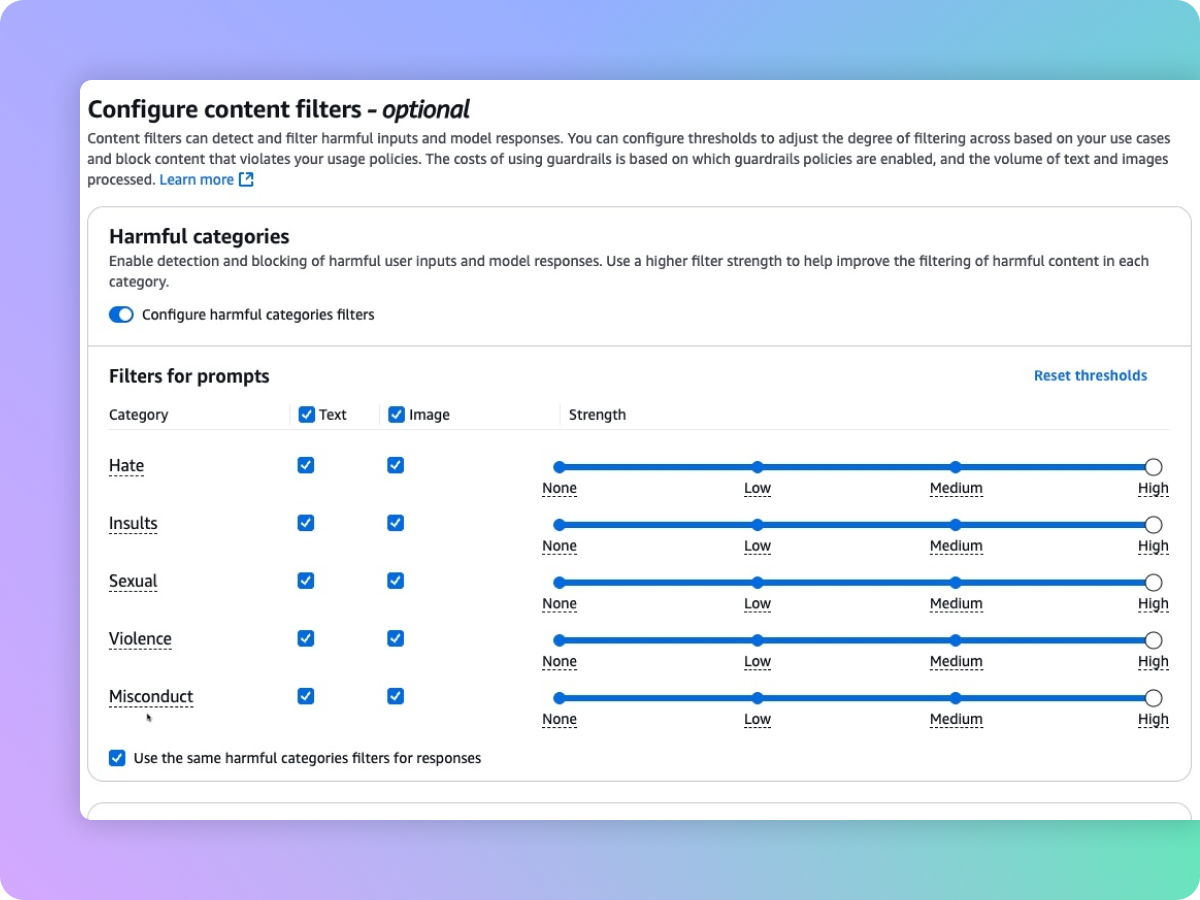

Filtre conteúdo nocivo multimodal com base em políticas de IA responsáveis

O Guardrails fornece filtros de conteúdo com limites configuráveis para conteúdo tóxico de texto e imagem. A proteção ajuda a filtrar conteúdo multimodal prejudicial contendo tópicos como discurso de ódio, insultos, sexo, violência e má conduta (incluindo atividades criminosas) e ajuda a proteger contra ataques de prompt (injeção de prompt e jailbreak). Os filtros de conteúdo avaliam automaticamente a entrada do usuário e as respostas do modelo para detectar e ajudar a evitar textos e/ou imagens indesejáveis e potencialmente prejudiciais. Por exemplo, um site de comércio eletrônico pode criar um assistente on-line para evitar o uso de linguagem imprópria, como discurso de ódio ou insultos.

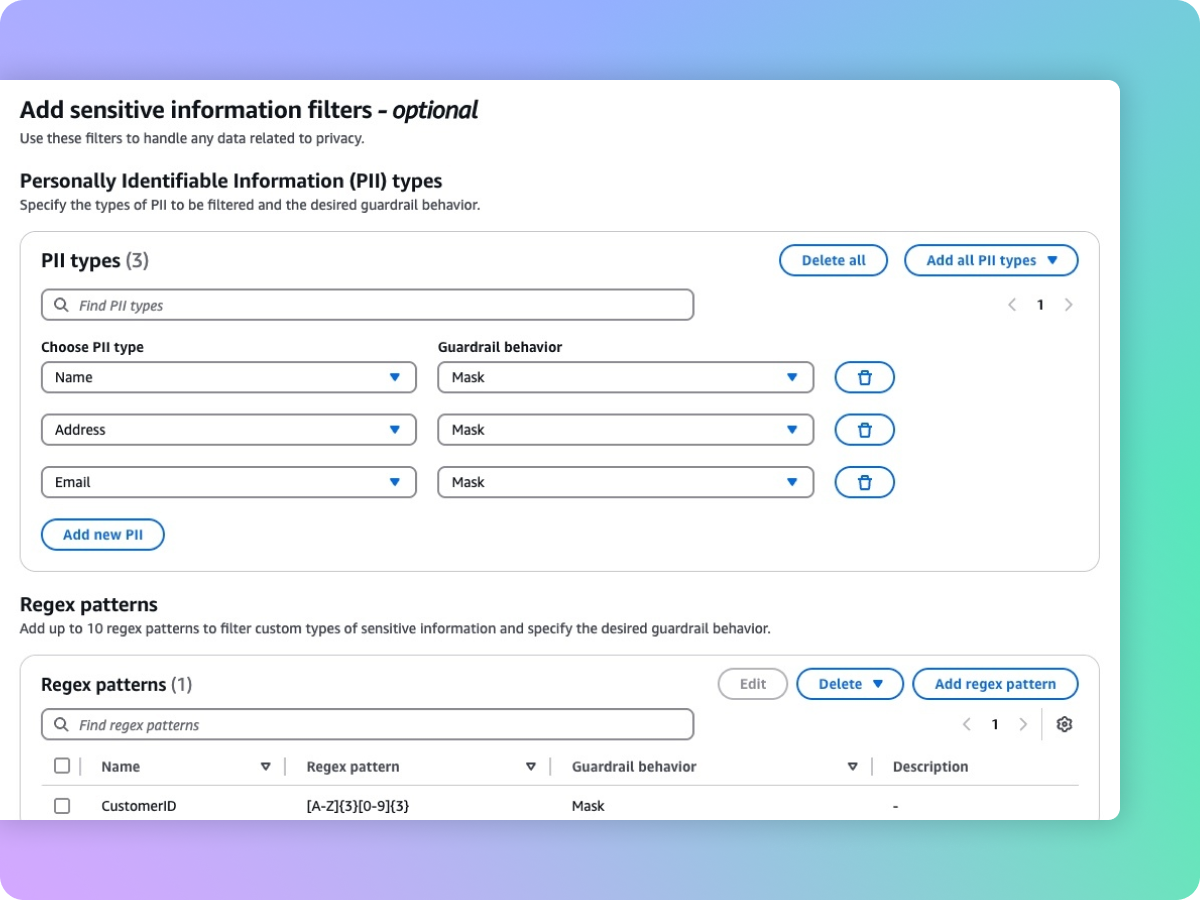

Ocultação de informações confidenciais, como PII, para proteger a privacidade

O Guardrails ajuda a detectar conteúdo confidencial, como informações de identificação pessoal (PII), em entradas de usuários e respostas de FMs. É possível selecionar a partir de uma lista de PII definidas previamente ou definir um tipo personalizado de informações confidenciais usando expressões regulares (RegEx). Com base no caso de uso, você pode rejeitar seletivamente as entradas que contêm informações confidenciais ou ocultá-las nas respostas dos FMs. Por exemplo, você pode editar as informações pessoais dos usuários enquanto gera resumos das transcrições de conversas com clientes e atendentes em uma central de atendimento.

Próximas etapas

Você encontrou o que estava procurando hoje?

Informe-nos para que possamos melhorar a qualidade do conteúdo em nossas páginas