AWS 기술 블로그

Category: Distributed Training

분산 트레이닝 관점에서의 AWS 인터커넥트 기술 소개 – 분산 트레이닝을 위해 알아야 할 GPU 간 고속 통신 기술

대규모 분산 훈련에서 GPU 간 통신 성능은 전체 훈련 효율을 좌우하는 핵심 요소입니다. 수백 대의 GPU가 그래디언트(gradient, 모델이 실수를 고치는 방향 지시서)를 주고받아야 하는 환경에서, 데이터가 GPU 메모리에서 네트워크를 거쳐 원격 노드의 GPU 메모리에 도달하기까지의 경로를 얼마나 효율적으로 설계하느냐가 곧 성능의 차이로 이어집니다. 이번 블로그는 이 시리즈의 마지막 편으로, AWS 인스턴스에서 활용되는 GPU 간 고속 […]

분산 트레이닝 관점에서의 AWS 인터커넥트 기술 소개 – AWS 환경에서 NCCL을 이용한 GPU 간 통신

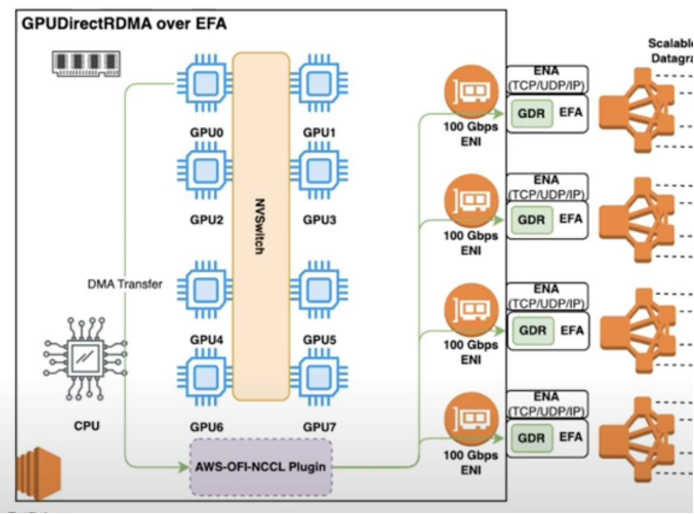

지난 블로그에서는 ENI(Elastic Network Interface)의 구조와 역할, 그리고 p5.48xlarge와 p6-b300 인스턴스에서 EFA(Elastic Fabric Adapter)를 실제로 어떻게 구성하는지 살펴보았습니다. 이번 블로그에서는 이렇게 구성된 EFA 네트워크 위에서 실제 GPU 간 통신이 어떻게 이루어지는지, 그 핵심에 있는 NCCL(NVIDIA Collective Communications Library) 통신에 대해 소개하고자 합니다. EFA가 고속도로를 깔아주는 인프라라면, NCCL은 그 위에서 수백 대의 GPU가 효율적으로 데이터를 주고받을 […]

분산 트레이닝 관점에서의 AWS 인터커넥트 기술 소개 – AWS의 인터커넥트 기반 기술, ENI 소개

지난 블로그에서는 AWS가 인피니밴드 대신 EFA를 선택한 이유와 두 기술의 철학적 차이에 대해 살펴보았습니다. 이번 블로그에서는 한 단계 더 들어가, EFA가 EC2 인스턴스에 연결되는 기반 구조인 ENI(Elastic Network Interface)에 대해 소개하고자 합니다. EFA의 성능을 제대로 활용하려면 ENI가 무엇인지, 그리고 네트워크 카드와 ENI가 어떤 관계를 가지는지를 이해하는 것이 선행되어야 합니다. 특히 p5.48xlarge, p6-b300.48xlarge과 같은 고성능 GPU […]

분산 트레이닝 관점에서의 AWS 인터커넥트 기술 소개 – AWS는 왜 인터커넥트 기술로 EFA를 사용하는가?

2025년 하반기부터 AWS에서 GPU 기반 분산 트레이닝 환경을 구축하는 고객이 급증하고 있습니다. 그럼에도 불구하고 많은 고객분들이 기존에 온프레미스 환경에서 사용되는 대표적인 인터커넥트 기술인 인피니밴드(Infiniband)와 AWS의 인터커넥트 기술의 차이점에 대해 명확히 이해하지 못하는 상황을 지켜보면서 이 블로그를 작성하게 되었습니다. 이번 블로그 시리즈에서는 AWS 클라우드 환경에서 분산 트레이닝 환경을 구축하고 운영하는데 필수적인 AWS의 인터커넥트 기술에 대해 소개하고자 […]

카카오스타일의 Amazon SageMaker 분산 훈련을 활용한 카테고리 자동 분류 시스템 모델 구축 사례

회사/팀 소개 카카오스타일은 모든 사람이 나만의 특별한 스타일을 가지고 있고, 내가 좋아하는 무언가를 발견했을 때의 즐거움이 일상을 더욱 나답게 만든다고 믿습니다. 사용자의 패션 뿐 아니라 일상에서의 모든 스타일을 위해 뷰티, 라이프 카테고리까지 확장하여 사용자의 즐거운 발견을 돕고 있습니다. 카카오스타일의 Vision & NLP(Natural Language Processing) 팀은 패션, 뷰티, 라이프 분야에서 컴퓨터 비전과 자연어 처리 기술을 활용하여 […]

Amazon SageMaker 모델 병렬 라이브러리를 이용한 신규 성능 향상 방법

이 글은 AWS ML Blog의 New performance improvements in Amazon SageMaker model parallel library by Arjun Balasubramanian, Can Karakus, Fei Wu, Rahul Huilgol, Suhit Kodgule, and Zhaoqi Zhu의 한국어 번역 및 편집본입니다. 파운데이션(Foundation ) 모델은 대량의 데이터로 학습된 대규모 딥 러닝 모델을 말합니다. 이 모델들은 파인 튜닝(fine-tuned)을 추가로 진행하여, 다양한 다운스트림 (downstream) 작업을 수행하고 여러 […]