Amazon Web Services ブログ

Amazon Redshift のユーザー管理を AWS IAM Identity Center に移行して認証を最新化する

Amazon Redshift のローカルユーザー管理を AWS IAM Identity Center に移行する方法を紹介します。RedshiftIDCMigration ユーティリティを使用して、ユーザー、グループ、ロールを IAM Identity Center に移行し、一元化された認証と SSO 機能を実現できます。

Kiro 価格設定の重要なお知らせ

Kiro の価格設定に関する重要なお知らせです。リクエスト計測に関するバグを修正し、多くのユーザーが経験していた予期せぬ使用量の急増問題を解決しました。この問題を受け、8 月の制限をリセットし、8 月に発生した料金はすべて返金することを決定しました。返金は 8 月 25 日から順次実施されます。また、現在認識している計測の不一致についても対応中です。ユーザーの皆様には、価格設定だけでなく、実際の作業に信頼できるツールを提供することを最優先に取り組んでいます。ご理解とサポートに感謝いたします。

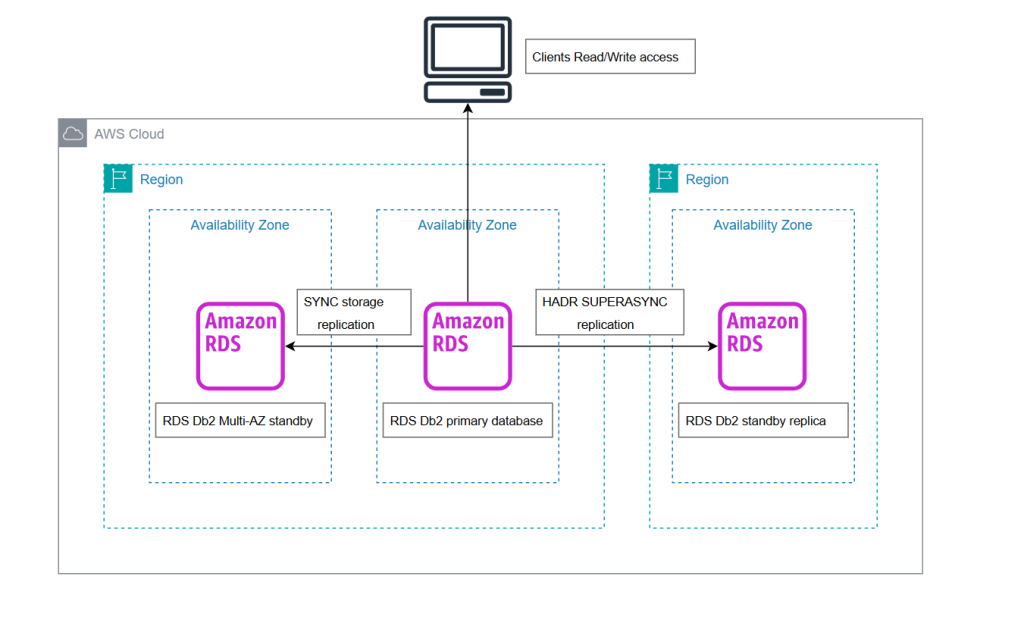

クロスリージョンのスタンバイレプリカによるAmazon RDS for Db2の高可用性と高速な災対切り替えの実現

この投稿では、RDS for Db2 インスタンスのスタンバイレプリカを構成する方法をご紹介します。

また、スタンバイレプリカのセットアップ、モニタリング、管理に関するベストプラクティスについても説明します。

この機能を使用することで、RDS for Db2 インスタンスを設定して、別のリージョンにスタンバイレプリカを保持することができます。

アイデミー様のSaaS on AWS事例:素材業界の研究開発部門向け材料開発のためのデータ蓄積プラットフォーム「Lab Bank 」 をAWS上でマルチテナント化。マネージドサービスを活用し少人数且つ短期間でセキュアな環境を構築。

本ブログは株式会社アイデミー様と Amazon Web Services Japan 合同会社が共同で執筆いた […]

株式会社ウィンシステム様の AWS 生成 AI 事例:Cline with Amazon Bedrock の活用により開発生産性が 10 倍向上

本ブログは株式会社ウィンシステム様と Amazon Web Services Japan 合同会社が共同で執筆 […]

AWS Jam で機械学習キャリアを変革しましょう

理論的な機械学習(ML)知識に加えて、雇用主が積極的に求めている実践的なスキルを身につける準備はできていますか ? ML エンジニア、DevOps 専門家、開発者のいずれであっても、身につけた知識を本番対応のソリューションに変えるには、ハンズオン体験が必要です。

ここで AWS Jam の出番です。集中的なクラスルームトレーニングとゲーム化されたハンズオンチャレンジを組み合わせることで、AWS Jam は ML ソリューションを大規模に実装するために必要となる実践的な経験を提供します。本番と同様のツールを使用し、実世界のシナリオに取り組み、実際のビジネス環境で ML ソリューションをデプロイする能力に自信をつけます。

このブログでは、構造化された学習と実践的な応用のユニークな組み合わせを通じて、AWS Jam があなたの ML エンジニアリング能力をどのように変革できるかを紹介します。2 つの柔軟な学習パスを発見し、取り組む 8 つの実世界のチャレンジを理解し、Jam 体験が ML エンジニアリングでのキャリア成長をどのように加速できるかを学びます。

[開催報告] 金融若手エンジニア向け AWS JumpStart Zero For FSI を開催しました

2025年8月22日に、金融業界の若手エンジニア80名以上が参加した「AWS JumpStart Zero For FSI」イベントが開催されました。このイベントでは、クラウドの基礎知識やアーキテクチャ設計のワークショップ、金融業界向けのクラウドユースケースの紹介などが行われ、参加者の高い関心と学習意欲が感じられました。多くの参加者が今後のAWS JumpStart本編への参加を予定しており、金融業界向けのAWSユーザーコミュニティの立ち上げも検討されています。

週刊AWS – 2025/8/18週

AWS Batch で新しいインスタンスタイプ選択オプションをサポート、Amazon Bedrock が Anthropic Claude Sonnet 4 と OpenAI GPT-OSS モデルのバッチ推論をサポート開始、Amazon S3 が保存されたデータセットのコンテンツを検証する新しい方法を導入、Amazon Aurora MySQL 3.10 を長期サポート (LTS) リリースとして発表、Amazon QuickSight が計算フィールドの制限を拡張、Amazon EC2 I7i インスタンスが追加の AWS リージョンで利用可能 など

Amazon Aurora DSQL のセキュリティ対策:アクセス制御のベストプラクティス

本記事は、2025 年 8 月 15 日に公開された Securing Amazon Aurora DSQL: […]

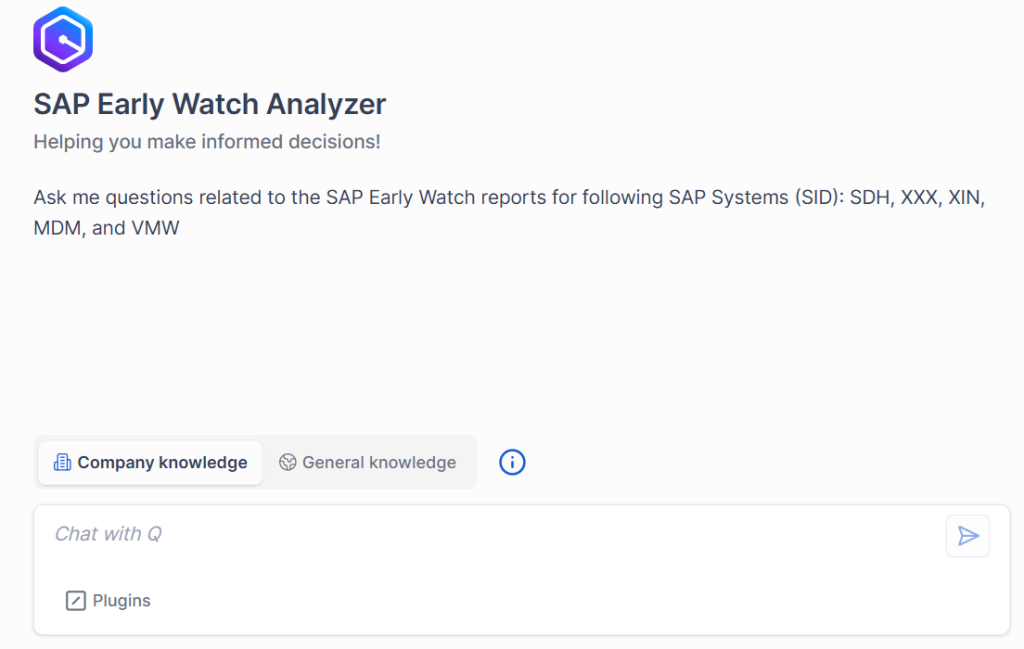

Amazon Q Business と Amazon Bedrock によるSAP データ価値の最大化 – パート 1

企業は生成 AI (Gen AI) の検討段階を超え、ビジネス価値を生み出すために積極的に活用するようになっています。

SAP システムを利用している方で、どこから始めればよいのか、アイデアを探している方も多いのではないでしょうか。

このブログでは、SAP データに関する一般的なビジネスユースケースと、AWS の GenAI サービスを使用した様々なアプローチについて説明します。