Amazon Web Services ブログ

Category: Analytics

AWS Glue 5.0 の Apache Spark におけるオープンテーブルフォーマット機能の活用

この記事では、AWS Glue 5.0 における Apache Iceberg、Delta Lake、Apache Hudi のオープンテーブルフォーマットライブラリの主要なアップデートについて解説します。ブランチとタグによるライフサイクル管理、変更ログビュー、ストレージパーティション結合などの新機能を紹介します。

AWS Glue Data Catalog のテーブル統計自動収集機能の紹介 – Amazon Redshift と Amazon Athena のクエリパフォーマンス向上

AWS Glue Data Catalog で、新しいテーブルの統計情報を自動的に生成できるようになりました。この機能により、Amazon Redshift Spectrum と Amazon Athena のコストベースオプティマイザー (CBO) がクエリを最適化し、パフォーマンス向上とコスト削減を実現します。

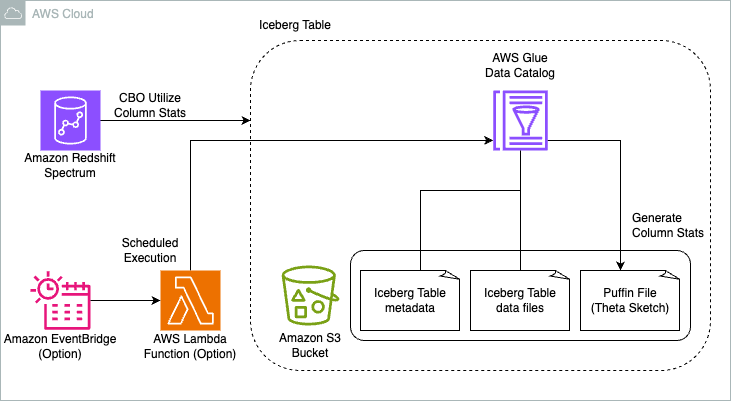

AWS Glue Data Catalog で Apache Iceberg 統計情報を収集してクエリパフォーマンスを高速化する

AWS Glue Data Catalog で Apache Iceberg テーブルのカラムレベル統計情報を生成し、Redshift Spectrum と Amazon Athena のクエリパフォーマンスを最大 83% 向上させる方法を紹介します。

AWS Glue Data Catalog での Apache Iceberg マテリアライズドビューのご紹介

AWS は AWS Glue Data Catalog の Apache Iceberg テーブル向けの新しいマテリアライズドビュー機能を発表しました。この機能により、データパイプラインを簡素化し、事前計算結果を保存してクエリパフォーマンスを向上させることができます。Amazon Athena、Amazon EMR、AWS Glue の Spark エンジンがこの新機能をサポートしています。

サーバーレス MLflow で Amazon SageMaker AI を使用して AI 開発を加速

2024 年 6 月に MLflow を搭載した Amazon SageMaker AI を発表して以来、弊社 […]

Amazon FSx for NetApp ONTAP が Amazon S3 と統合され、シームレスなデータアクセスが可能になりました

2025 年 12 月 2 日、Amazon Simple Storage Service (Amazon S […]

Amazon Redshift で Apache Iceberg データをクエリするためのベストプラクティス

Amazon Redshift で Apache Iceberg データをクエリする際のベストプラクティスを紹介します。テーブル設計、パーティション化、列選択、統計生成、メンテナンス戦略、マテリアライズドビュー、レイトバインディングビューの活用方法について詳しく説明します。

Amazon Bedrock で TwelveLabs Marengo を使用した動画理解の実現

TwelveLabs Marengo 埋め込みモデルが Amazon Bedrock で利用可能になりました。このモデルはマルチベクトルアーキテクチャにより、動画の視覚、音声、テキスト要素を個別に捉え、従来の単一ベクトルアプローチでは失われていたニュアンスを保持します。Amazon OpenSearch Serverless と組み合わせることで、テキスト、画像、音声を使用したクロスモーダルセマンティック検索が可能になり、インテリジェントな動画コンテンツ発見を実現します。

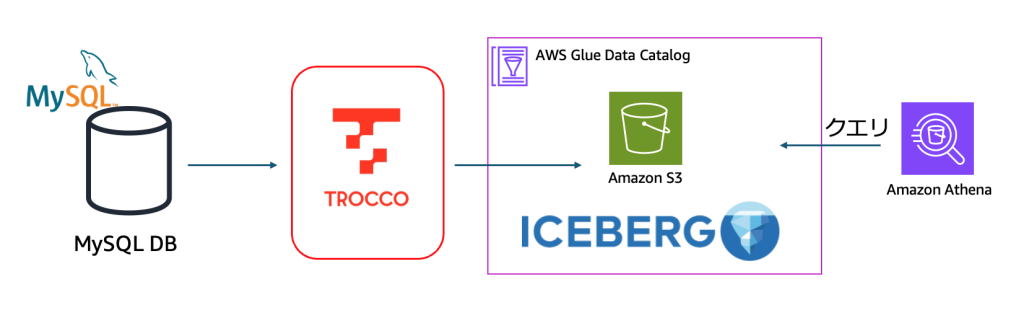

TROCCO の CDC 機能をつかった RDB と Apache Iceberg on AWS の連携

データベースの変更をリアルタイムに分析基盤へ反映したいというニーズに高まりを感じています。実際に多くのお客様から相談をいただいております。またデータベースの差分をもとに連携することが望まれる場面も多くあります。そういう場合の選択肢の一つが CDC(Change Data Capture)と呼ばれる MySQL の binlogなどの変更履歴をもとにデータを連携する手法になります。しかし、CDC での実装は、データ取得・キャッシュレイヤー・コンシューマーの実装とコンポーネントが多くなる場合も多く技術的なハードルが高く、ソースデータベースのスキーマの変更をターゲットの分析基盤に滞りなく連携する必要があるなど運用負荷も大きいワークロードになります。

CDC のターゲットの選択肢の1つとして、Iceberg を利用することで多様なエンジンから利用することができ、ソーススキーマの変更にも柔軟に対応ができるコスト効率の良い、DB のデータをソースにしたデータレイクハウスを構築することができます。

本記事では、AWS パートナーである primeNumber 社が提供するデータ統合プラットフォーム「TROCCO」の CDC 機能を使って、MySQL から AWS 上の Apache Iceberg テーブルへのリアルタイムレプリケーションを実現する方法をご紹介します。実際に検証した内容をもとに、セットアップから運用まで詳しく解説していきます。

Amazon S3 ストレージレンズにパフォーマンスメトリクスの追加、数十億のプレフィックスのサポート、S3 Tables へのエクスポートが追加されました

2025 年 12 月 2 日、ストレージのパフォーマンスと使用パターンをより深く理解できる Amazon S […]