Amazon Web Services ブログ

Category: Amazon EC2

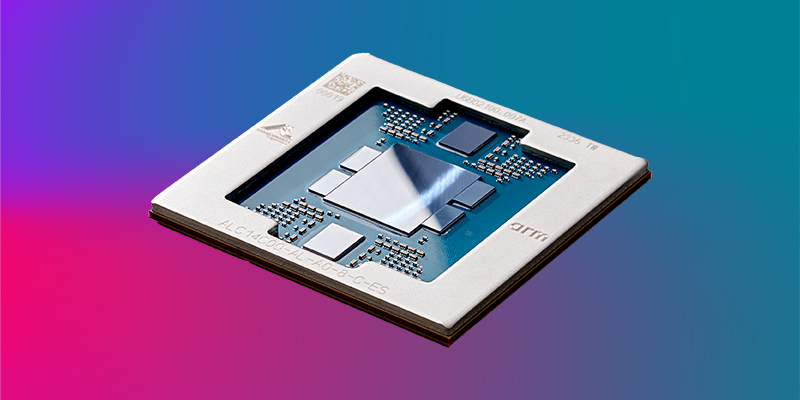

最大 600 Gbps のネットワーク帯域幅を提供する AWS Graviton4 搭載の新しい Amazon EC2 C8gn インスタンス

6 月 30 日、AWS Graviton4 プロセッサと最新の第 6 世代 AWS Nitro Card を […]

第一三共株式会社:創薬研究クラウドプラットフォームにおけるモダナイゼーションの取り組み

このブログは、第一三共株式会社 研究統括部 研究イノベーション企画部およびモダリティ第一研究所と、アマゾン ウ […]

AWS Weekly Roundup: 新しい AWS ヒーロー、Amazon Q Developer、EC2 GPU の値下げなど (2025 年 6 月 9 日)

AWS ヒーロープログラムは、知識を共有したいという熱意によってコミュニティ内に真の影響をもたらしている、活気 […]

Amazon EC2 NVIDIA GPU 高速インスタンスの料金を最大 45% 引き下げることを発表

さまざまな業界のお客様が AWS の生成 AI の力を活用して、従業員の生産性を高め、優れたカスタマーエクスペ […]

Petrobras が Amazon EC2 スポットインスタンスを使用して HPC アプリケーションのコストとキャパシティを最適化

これまで、Petrobras は主にオンプレミスソリューションを使用して HPC アプリケーションを実行していました。従来の HPC の制限を克服するため、フルミネンセ連邦大学(UFF)の Cloud+HPC ラボと共同で、オンプレミスとクラウドリソースを組み合わせたハイブリッドシステムを開発する研究プロジェクトを立ち上げました。AWS ParallelCluster と Amazon EC2 スポットインスタンスを活用することで、Petrobras は事実上無制限のコンピューティングパワーを獲得し、複雑なシミュレーションの効率性を向上させ、可用性と最も重要な生産性を高めることができました。

本日は、これを可能にするために彼らが作成したフレームワーク Sim@Cloud について説明します。Petrobras はこれを使用して、パフォーマンスを最大限に維持しながら、43% から 90% のコスト削減を達成しました。Sim@Cloud は待ち時間を最小限に抑え、適切なインスタンスを選択し、インスタンスの稼働を管理します。

ロケットミッション解析の迅速化をAWS上で検証 : 解析の20倍高速化によるDXに向けた技術実証を実施

本ブログは、宇宙航空研究開発機構 (JAXA) へのインタービューを元に、 Amazon Web Servic […]

寄稿:製鉄業のデジタル革新 – JFE 条鋼株式会社が挑む AWS による基盤刷新への道

JFE 条鋼株式会社は AWS 移行を通じて製鉄業のデジタル革新に挑戦しています。システム基盤の近代化とデータ活用基盤の整備により、リアルタイムでのデータ分析や業務プロセスの効率化を実現しました。この取り組みは、同社の持続可能な成長への重要な一歩となっております。

BlueXP Workload Factory Migration Advisor を使用して、VMware から Amazon EC2 および Amazon FSx for NetApp ONTAP への移行を迅速化

あらゆる規模の企業が、VMware ワークロードを Amazon Elastic Compute Cloud(Amazon EC2) へ効率的に移行するための方法を積極的に模索しています。この移行は、潜在的なライセンス制約を回避するだけでなく、インフラストラクチャをモダナイズし、コスト効率、柔軟性、信頼性、セキュリティといった AWS サービスのメリットを活用する機会でもあります。しかしながら、こうした移行には、複雑な計画サイクル、パフォーマンス最適化の取り組み、そして移行プロセスにおける見落としによるコストのかかるリスクなど、大きな課題が伴うことがよくあります。NetApp の BlueXP Workload Factory Migration Advisor は Amazon FSx for NetApp ONTAP ストレージを使用して VMware ワークロードを Amazon EC2 インスタンスに移行するための自動計画と最適化を提供することで、組織がこれらの課題を克服するのに役立ちます。本稿では、BlueXP Workload Factory Migration Advisor を使用して、VMware デプロイメントから AWS へのシームレスな移行を計画および実行する方法を説明します。

AWS CodeBuild の新しい Docker サーバー機能で CI/CD パイプラインを高速化

5 月 15 日より、AWS CodeBuild の Docker サーバー機能を使用して、CodeBuild […]

AI イノベーションを加速する NVIDIA Blackwell GPU を搭載した新しい Amazon EC2 P6-B200 インスタンス

5 月 15 日、NVIDIA B200 を搭載した Amazon Elastic Compute Cloud […]