Amazon Web Services ブログ

Category: Analytics

AWS Cost and Usage Reports データを使用したセキュリティリスクの特定

AWS の請求書からわかるのは、支出パターンだけではありません。セキュリティ上の問題を特定することもできます。 […]

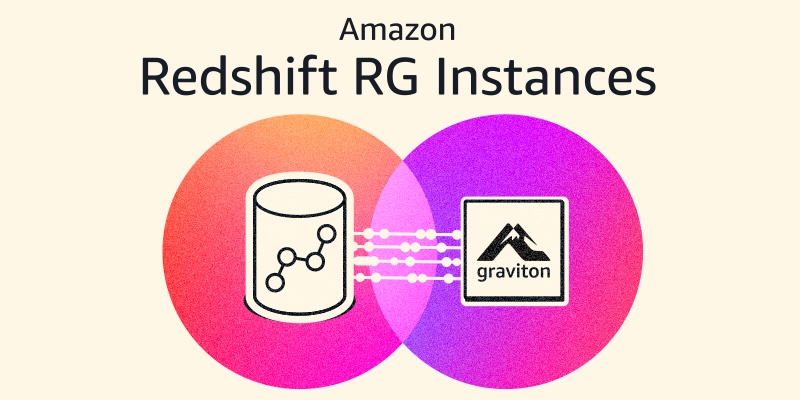

データレイククエリエンジンが統合された AWS Graviton ベースの RG インスタンスが Amazon Redshift に導入されました

2013 年以来、Amazon Redshift はオンプレミスの数分の 1 のコストでクラウドデータウェアハ […]

Amazon Aurora スナップショットから Amazon Aurora DSQL へのデータ移行

Amazon Aurora DSQL はサーバーレスの分散 SQL データベースで、データ移行には COPY コマンドや dataloader スクリプトが利用できますが、テーブル単位の処理しかできず、データ変換の手段もありません。本記事では AWS Glue を使い、Aurora PostgreSQL のスナップショットから Aurora DSQL へ、データ型変換や主キーの UUID 化を含めて移行する手順を紹介します。

実践企業に学ぶ生成 AI 導入の勘所 〜眠るデータを企業価値に変える〜 – AWS Local Executive Roadshow 名古屋編(#3/8)開催レポート

こんにちは。Amazon Web Services Japan のソリューションアーキテクト、田中 里絵 です […]

寄稿:株式会社 JPX 総研による「Amazon Quick Sight を活用した JPX 保有データ(J-LAKE)活用推進の取り組み」のご紹介

JPX総研が構築したデータレイク「J-LAKE」と Amazon QuickSight を活用し、社内データ活用文化を醸成した取り組みを紹介。経営層向けダッシュボード構築から全社ハンズオン、社内ダッシュボードコンペ開催まで、データの民主化を実現した実践事例を解説します。

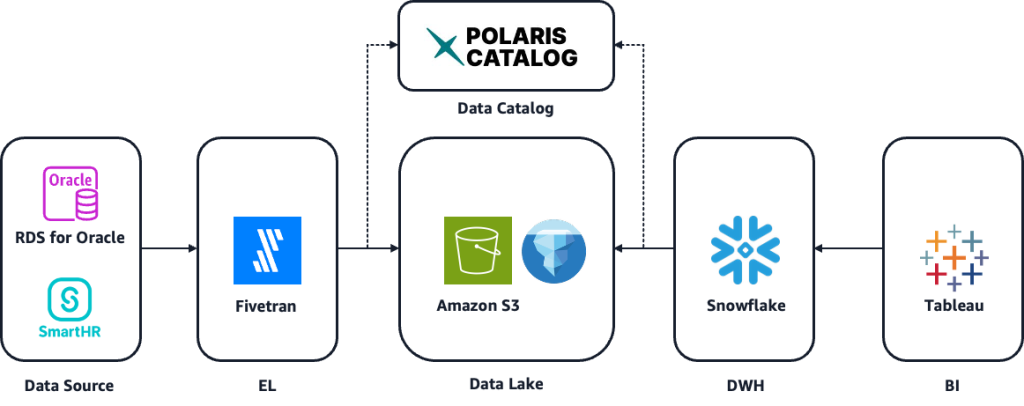

Fivetran の CDC 機能で実現するラーメン山岡家の Iceberg on AWS データパイプライン

ラーメンチェーン「山岡家」を展開する株式会社丸千代山岡家が、Fivetran の CDC(Change Data Capture)機能を活用して Amazon RDS for Oracle から Amazon S3 上の Apache Iceberg テーブルへのデータ同期を実現した事例をご紹介します。アーキテクチャの検討プロセスや Fivetran 採用の理由、約 5 分のデータ反映、月あたりの運用工数を 6 日から 0.5 日に削減、PoC から本番稼働まで約 1 ヶ月という短期導入といった導入効果を解説します。

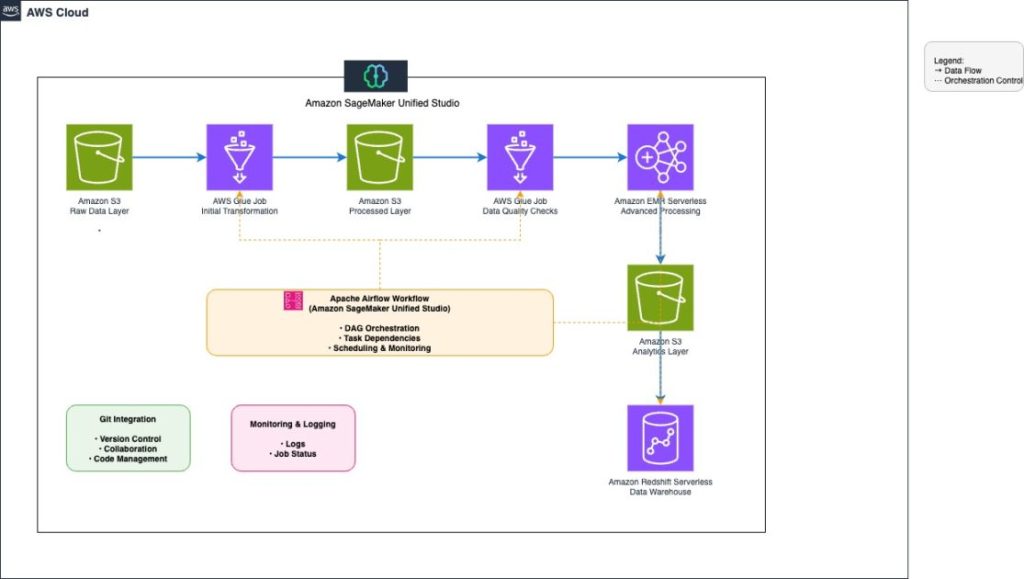

Amazon SageMaker ワークフローによるスケーラブルなエンドツーエンド ETL パイプラインのオーケストレーション

本記事では、Amazon SageMaker Unified Studio ワークフローでコードベースのエンドツーエンド ETL パイプラインを構築・管理する方法を紹介します。AWS Glue、Amazon EMR Serverless、Amazon Redshift Serverless、Amazon MWAA を組み合わせ、EC の顧客行動分析を例に、データ取り込みから変換、品質チェック、データウェアハウスへのロード、日次スケジュール実行まで、単一の統合 UI で構築する手順を解説します。

Amazon SageMaker Catalog でのビジネス用語集分類ルールの必須化

Amazon SageMaker Catalog で、資産レベルでの用語集タームの分類 (タグ付け) に対するメタデータ適用ルールがサポートされました。本記事では、金融サービスのユースケースを例に、プロジェクトから公開するすべての資産に特定のビジネス用語タームを必須化するルールの作成手順を紹介します。

Amazon SageMaker のメタデータ必須化ルールによるガバナンスの強化

Amazon SageMaker Catalog が新たにサポートするメタデータ強制ルールを使うと、データ公開やサブスクリプションのワークフローに必要なメタデータ項目を定義・強制できます。本記事では、特定のドメインにメタデータ強制ルールを設定し、カタログでの資産公開時と資産サブスクリプション時に強制適用する 2 つのワークフローを紹介します。

Amazon DataZone によるデータガバナンスのスケール: Covestro の事例

本記事では、Covestro が中央集権型のデータレイクから Amazon DataZone と AWS Serverless Data Lake Framework (SDLF) を使ったデータメッシュアーキテクチャへ移行した事例を紹介します。標準化されたブループリントと自動化されたガバナンスにより、1,000 を超えるデータパイプラインを運用しながら市場投入までの時間を 70% 短縮し、部門横断のデータ共有と品質管理を実現した経緯を解説します。