Amazon Web Services ブログ

Category: Artificial Intelligence

回復力のあるサプライチェーンの構築: Amazon Bedrock を活用した小売・消費財向けマルチエージェント AI アーキテクチャー

午前2時。携帯電話に緊急のアラートが届きます: 主要港湾の閉鎖、47件の入荷便への影響、そして72時間後に迫ったプロモーション開始。急いでノートパソコンを開き、在庫ダッシュボード、物流プラットフォーム、サプライヤーポータルといった十数個の異なるシステムを確認します。これらは今起きている状況の一部しか伝えておらず、必要な答えは得られません。市場シェアを競合他社に奪われる前に、どのように出荷を再ルーティングし、在庫を再配分し、プロモーションでコミットした出荷量を維持できるのでしょうか?

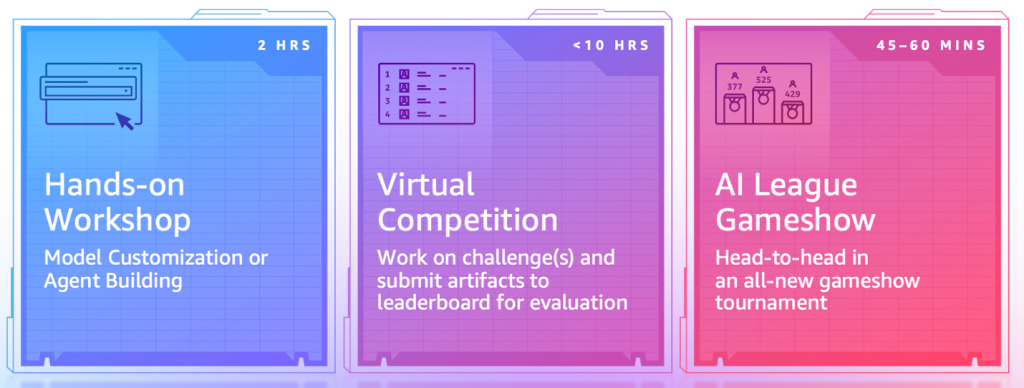

AWS AI League: モデルカスタマイゼーションとエージェント対決

AWS AI League は、エージェンティック AI とモデルカスタマイゼーションの分野でイノベーションを促進する、エキサイティングなコンペティションを通じて、企業が高度な AI 能力を構築する際の課題を克服できるよう支援する革新的なプログラムを提供しています。この記事では、AWS AI League プログラムを使用して AI コンペティションを開催する方法について説明します。 このプログラムにより、参加者はモデルカスタマイゼーションやエージェント構築の概念を体験し、それらを実際のビジネス課題解決に応用し、ゲーム形式の魅力的なフォーマットで革新的なソリューションを披露することができます。新たに導入されたエージェンティック AI とモデルカスタマイゼーションのチャレンジでは、企業が AWS クレジットを利用して社内トーナメントを主催したり、開発者が AWS イベントで競い合うことが可能です。

株式会社サンブリッジ様のAWS生成AI事例「採用担当向け育成 AI コーチの構築により育成業務の一部を自動化し、年間 360 時間の工数削減と育成の質の高度化を実現」のご紹介

本ブログは株式会社サンブリッジ様と Amazon Web Services Japan が共同で執筆いたしまし […]

Kiro CLI と Amazon MSK MCP Server を使用した自然言語による Amazon MSK の簡易管理

この記事では、Kiro CLI と Amazon MSK MCP Server を使用して、自然言語コマンドで Apache Kafka クラスターを管理する方法を紹介します。トピック管理、クラスターの健全性監視、設定の最適化など、複雑な Kafka 操作を対話形式で簡単に実行できるようになります。

AWS re:Invent 2025:ヘルスケア・ライフサイエンスにおける変革の瞬間

このブログは、 “AWS re:Invent 2025: A transformative moment fo […]

人に依存しないCRMによりEC事業者のLTV最大化を実現 Amazon Bedrock AgentCoreを活用したAIオートパイロット型CRM開発事例

株式会社ダイレクトマーケティングエージェンシー(以下、DMA)は、2006年の創業以来、ECビジネス支援エー […]

2D から 3D へ: Amazon SageMaker AI を使用したスケーラブルなヒューマンメッシュリカバリパイプラインの構築

コンピュータグラフィックスとアニメーションの絶えず進歩する分野において、動画データから現実的な 3D ヒューマンアニメーションを自動生成する技術がデジタルコンテンツの作成方法を変革する可能性があります。この記事では、AWS 上に構築されたスケーラブルなヒューマンメッシュリカバリパイプラインについて、スコアガイド付き HMR (ScoreHMR) モデルと Amazon SageMaker AI を活用した実装を説明します。

Amazon Bedrock は、新しい Mistral Large 3 モデルと Ministral 3 モデルを含む 18 のフルマネージドオープンウェイトモデルを追加します

2025 年 12 月 2 日、Google、Moonshot AI、MiniMax AI、Mistral A […]

NATO のマルチドメインオペレーションへの進展: ハイパースケールクラウドによる同盟の変革

本ブログは 2025 年 2月 21 日に公開された AWS Public Sector ブログ「NATO’s […]

PartyRock の保護:AWS WAF を利用した Amazon Bedrock エンドポイントを保護する方法

AWS WAF を利用して分散型サービス拒否攻撃 (DDoS) や Wallet 拒否攻撃 (DoW) のような潜在的な脅威から PartyRock を保護した方法を探求します。この投稿で、オンラインアプリケーションに生成 AI 機能をインテグレーションしている開発者は、同様の脅威からそのアプリケーションを保護する具体的な AWS WAF の基本テクニックについて学ぶことができます。